在生成式 AI 领域,扩散模型(如 Stable Diffusion、FLUX)长期面临一个结构性瓶颈:它们自身缺乏深层的语义理解能力,必须依赖外部“教师”模型(如 CLIP、DINOv2)来提供指导。这种“借来的智慧”不仅增加了训练复杂度,更在模型规模扩大时遭遇性能天花板。

德国 AI 初创公司 Black Forest Labs(FLUX 模型的缔造者)宣布了一项突破性进展:Self-Flow。这是一种全新的自监督流匹配框架,它让模型能够同时学习“看”(语义表示)和“画”(内容生成),彻底摆脱对外部编码器的依赖。

- 官方介绍:https://bfl.ai/research/self-flow

- GitHub:https://github.com/black-forest-labs/Self-Flow

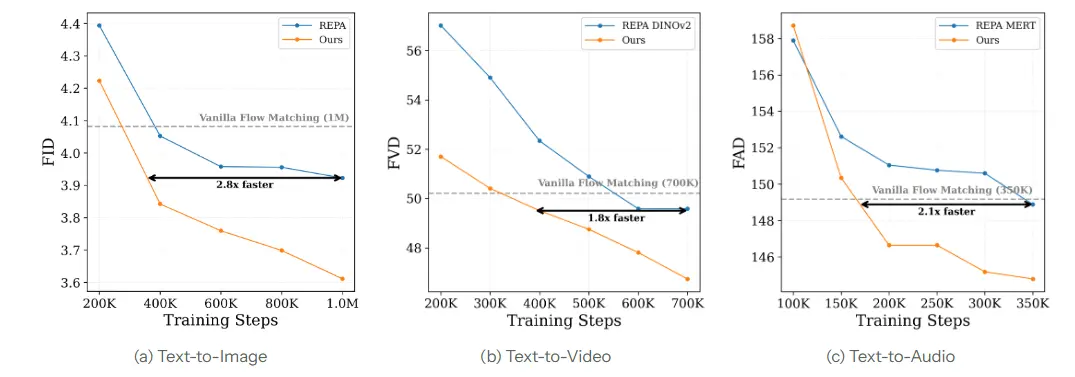

实验数据显示,Self-Flow 将多模态模型的训练效率提升了 2.8 倍,收敛速度比现有最先进方法快近 50 倍,并在图像、视频、音频及机器人控制任务中全面超越竞品。

核心突破:打破“语义鸿沟”,实现自蒸馏

1. 传统痛点:借来的眼睛看不远

传统的生成模型训练本质上是一个“去噪”过程:模型看着噪声图,试图还原成清晰图像。它只关心“像不像”,不关心“是什么”。为了弥补这一缺陷,业界通常引入冻结的外部编码器(教师模型)来对齐特征。

- 缺陷:外部教师模型目标错位、无法泛化到新模态(如音频、机器人),且一旦教师模型达到极限,学生模型也无法再进步。

2. Self-Flow 方案:自己教自己

Black Forest Labs 提出了一种巧妙的**“信息不对称”机制,利用双时间步调度(Dual Timestep Scheduling)**实现自蒸馏:

- 双重视角:

- 学生(Student):接收严重损坏(高噪声)的数据版本。

- 教师(Teacher):实际上是学生模型自身的**指数移动平均(EMA)**版本,接收相对清晰(低噪声)的同一数据。

- 自蒸馏任务:学生不仅要生成最终图像,还要预测“更清晰的自己”看到了什么。

- 效果:这种机制迫使模型在学习生成的同时,内部自发构建出深刻的语义理解能力。模型既是画家,也是评论家。

性能飞跃:更快、更强、更通用

Self-Flow 不仅在理论上优雅,在实际表现上更是碾压级的:

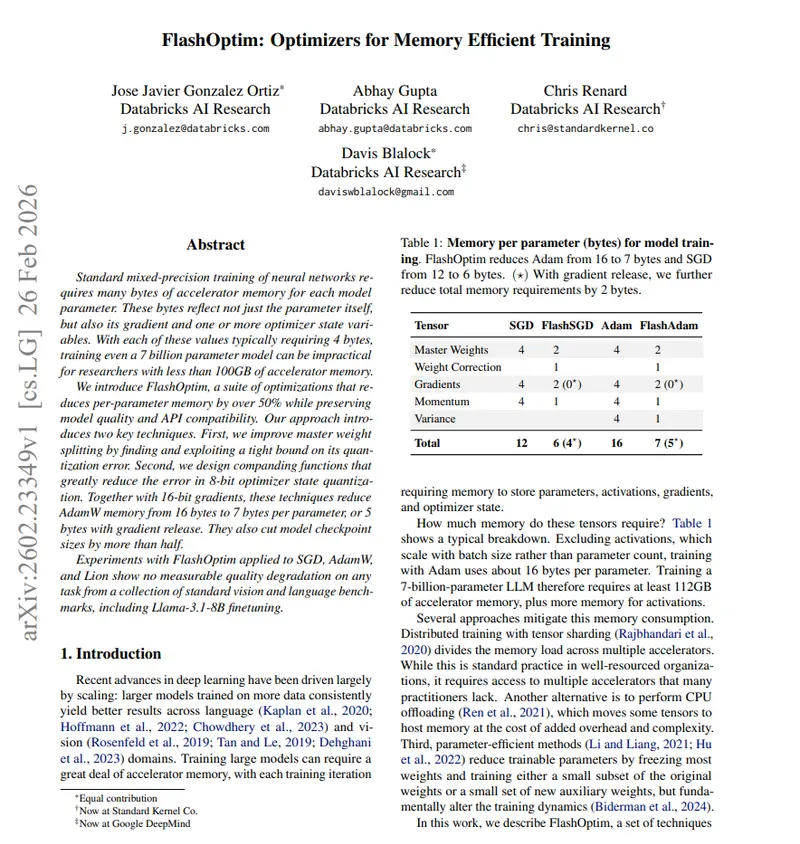

| 指标 | 传统普通训练 | REPA (前代 SOTA) | Self-Flow (新) | 提升幅度 |

|---|---|---|---|---|

| 达到基线所需步数 | 700 万步 | 40 万步 | 14.3 万步 | 比传统快 ~49 倍 |

| 相对收敛速度 | 1x | 17.5x | ~49x | 比 REPA 快 2.8 倍 |

| 图像 FID (越低越好) | - | 3.92 | 3.61 | 画质更优 |

| 视频 FID | - | 49.59 | 47.81 | 动态更稳 |

| 音频得分 | - | 148.87 | 145.65 | 音质更真 |

三大关键领域进步:

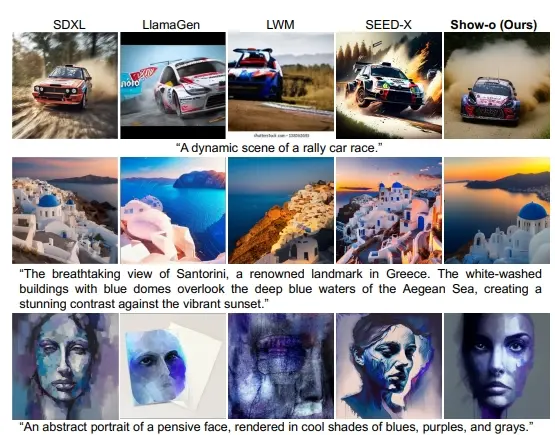

- 文本渲染革命:彻底解决了 AI 绘图中的“乱码”顽疾。Self-Flow 能精准渲染复杂的标志、标签和多行文本,字迹清晰可读。

- 时间一致性增强:在视频生成中,有效消除了肢体消失、物体突变等“幻觉”伪影,画面流畅自然。

- 音视频原生同步:由于不再依赖仅懂图像的编码器,模型能原生理解声音与画面的关联,实现单提示词生成音画同步内容。

从生成到规划:迈向“世界模型”

Self-Flow 的意义远超内容生成。其强大的内部语义表示能力,使其成为构建**世界模型(World Models)**的理想基石,尤其在机器人领域:

- 机器人任务成功率飙升:在 RT-1 数据集上微调后,Self-Flow 模型在 SIMPLER 模拟器中执行复杂多步任务(如“打开抽屉并放入物品”)的成功率显著高于传统模型。

- 物理逻辑理解:传统模型常因不理解物理因果而失败,而 Self-Flow 凭借内建的语义理解,能更好地进行视觉推理和动作规划。

🛠️ 工程与企业价值:降本增效的战略利器

对于开发者和企业决策者,Self-Flow 带来了立竿见影的红利:

- 成本骤降:训练步数减少 50 倍,意味着算力成本和时间成本的大幅压缩。中小企业也能负担得起高质量多模态模型的训练。

- 架构简化:移除外部编码器(如 DINOv2),技术栈更轻量,无需管理庞大的第三方依赖,减少技术债务。

- 无限扩展性:打破了外部教师模型的性能天花板。随着算力和数据增加,模型性能可线性提升,无收益递减之忧。

- 垂直领域定制:高效的微调能力使得针对医疗影像、工业检测等小众领域训练专用模型变得经济可行。

开源与未来

Black Forest Labs 已在 GitHub 发布了研究论文、官方推理代码及基于 ImageNet 的预训练模型权重。

- 当前状态:研究预览版(Research Preview)。

- 未来展望:鉴于 Black Forest Labs 在 FLUX 系列上的开源记录,Self-Flow 技术预计将在不久的将来整合进其商业 API 及下一代开放权重模型中。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...