在 AI 模型参数规模迈向万亿级的今天,“显存焦虑”已成为制约创新的最大瓶颈。训练一个 70 亿参数的语言模型,仅参数和优化器状态就需要 112GB 显存,这让拥有 24GB 消费级显卡的绝大多数开发者望而却步。

- 论文地址:https://arxiv.org/abs/2602.23349

近日,Databricks AI Research 推出了 FlashOptim,一项突破性的内存优化技术。它不走分布式堆叠或 CPU 卸载的旧路,而是通过智能量化算法,在不牺牲任何训练速度和模型精度的前提下,将主流优化器的显存占用直接砍掉 50% 以上。这意味着,曾经需要昂贵集群才能运行的任务,现在可能在单张或少量显卡上即可轻松启动。

核心突破:重新定义显存效率

FlashOptim 并非简单的“压缩”,而是一套针对优化器状态存储的重构方案。它支持三种最主流的优化器,实现了惊人的压缩比:

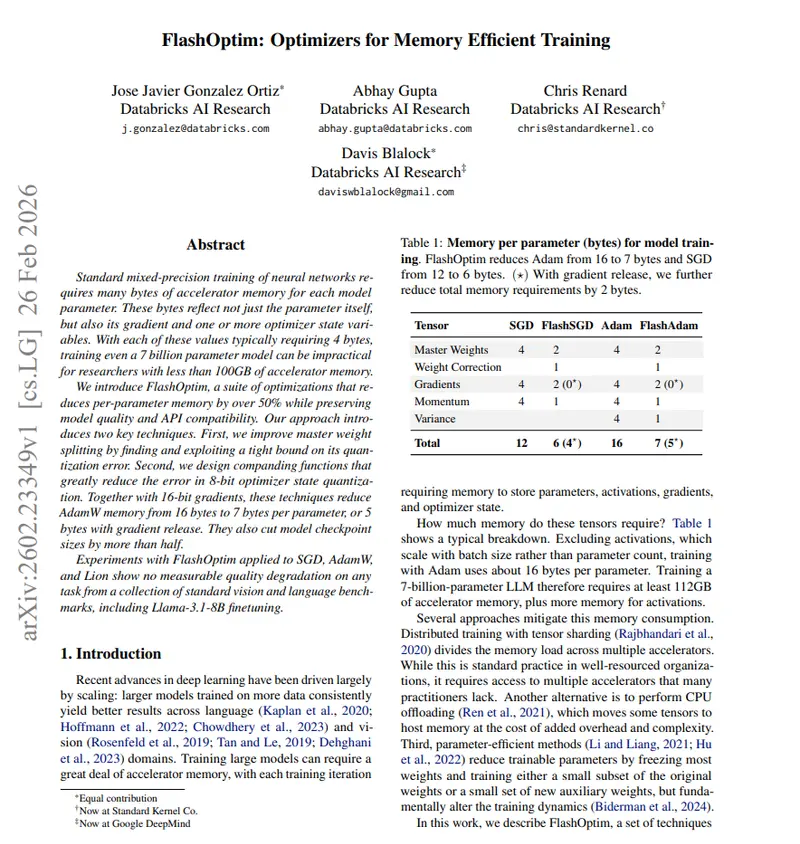

| 优化器 | 原始占用 (每参数) | FlashOptim 占用 | 节省幅度 | 实战效果 (7B 模型) |

|---|---|---|---|---|

| SGD (带动量) | 12 Bytes | 6 Bytes (最低 4B) | ~50-66% | - |

| AdamW | 16 Bytes | 7 Bytes (最低 5B) | ~56-69% | 112GB → 35-49GB |

| Lion | 16 Bytes | ~8 Bytes | ~50% | - |

注:配合梯度释放技术,显存占用可进一步降低。

三大核心优势

- 省得多:直接将 AdamW 的每参数占用从 16 字节压至 7 字节,比现有方案更激进。

- 零损失:在 ImageNet 分类、GPT-2 预训练、Llama-3.1 微调等任务中,训练曲线与最终精度与原版完全重合,无任何质量妥协。

- 速度快:通过 Triton 编写的融合内核,将压缩/解压/更新操作打包,执行时间与原版持平(约 12ms),无额外开销。

技术揭秘:如何做到“既要马儿跑,又要马儿少吃草”?

FlashOptim 的成功源于两大创新性的量化策略:

第一招:智能权重分割 (Smart Weight Splitting)

——用 24 位存储实现 32 位精度

传统量化直接截断精度,导致误差累积。FlashOptim 将参数拆分为两部分:

- 主体部分 (16-bit):存储参数的主要数值。

- 误差部分 (8-bit):专门存储被舍去的残差。

- 关键创新:误差部分不是均匀存储,而是基于参数的最小精度单位 (ULP) 进行动态映射。就像量身高时,已知对方约 1.7 米,就只精细刻画 1.5-1.9 米的区间。这使得 24 位存储空间能达到 99.92% 的 32 位还原度。

第二招:压缩扩展函数 (Compress-Expand Functions)

——让 8 位存储更“懂”数据分布

优化器的动量 (Momentum) 和方差 (Variance) 分布极不均匀(大部分集中在中间,极端值少)。

- 非线性变换:FlashOptim 在量化前先对数据进行“变形”。

- 动量:使用 S 形函数将两端极值向中间压缩。

- 方差:先开平方根,拉平大数值。

- 效果:变形后的数据分布更均匀,此时再用 8 位整数量化,每个刻度都能物尽其用。读取时再逆变换回去,实现无损还原。若直接使用线性量化,训练往往会发散。

第三招:融合内核 (Fused Kernels)

为了避免频繁的显存读写拖慢速度,FlashOptim 使用 Triton 编写了融合内核,将 解压状态 → 重建参数 → 计算更新 → 压缩新状态 → 分割存储 这一整套流程打包成一个 GPU Kernel。数据在显存中只需转一圈,极大提升了吞吐量。

实测表现:硬核数据说话

Databricks 团队在多个基准测试中验证了 FlashOptim 的卓越性能:

- 🖼️ 图像分类 (ImageNet + ResNet-50)

- 结果:FlashSGD/FlashAdamW 的验证准确率与原版差距小于 0.15%(属随机波动),损失曲线完全重叠。

- 📝 语言模型预训练 (GPT-2, 1.24B)

- 结果:在 100 亿 Token 训练后,验证损失一致;在 8 个常识推理基准上,平均分差距不超过 1%。

- 🦙 大模型微调 (Llama-3.1-8B)

- 场景:数学指令微调 (GSM8k)。

- 精度:FlashAdamW 得分 74.98% vs 原版 75.09%,几乎无异。

- 显存:峰值占用从 175GB 降至 113GB,节省 36%(若结合其他技术可更多)。

- ⚡ 速度测试

- 优化器步骤耗时:原版 12.0ms vs FlashOptim 12.5ms,基本持平。

兼容性与部署

FlashOptim 设计为即插即用的升级方案:

- 代码零修改:只需替换优化器初始化代码(如

torch.optim.AdamW改为flashoptim.FlashAdamW),无需改动训练循环。 - 叠加效应:可与 FSDP (分布式训练)、Activation Checkpointing (激活重计算)、CPU Offload 等技术叠加使用,实现显存节省的“乘法效应”。

- 检查点压缩:不仅节省训练显存,还将模型检查点文件从 84GB 压缩至 35GB,大幅降低存储成本。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...