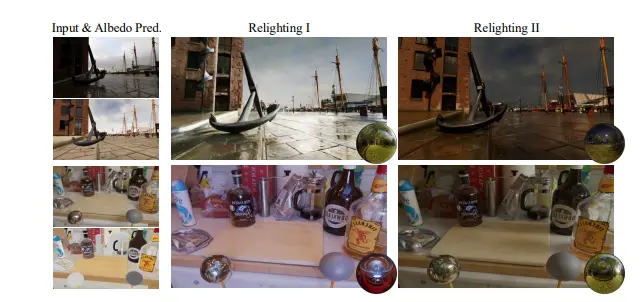

英伟达、多伦多大学和Vector 研究所的研究人员发布视频重光照(relighting)技术UniRelight,通过对单张图像或视频进行光照条件的修改,实现场景在不同光照下的视觉效果呈现。

例如,将一张白天拍摄的照片转换为夜晚的光照效果,或者改变视频中物体的光照方向和强度,从而创造出全新的视觉体验。

主要功能

- 视频重光照:能够对输入的视频在保持场景内容不变的情况下,修改其光照条件,生成在不同光照环境下的新视频。

- 联合估计与合成:在单一处理过程中,同时估计场景的反照率(albedo,即物体表面的反射特性)并合成重光照后的输出,实现对场景内在属性和光照的联合建模。

- 复杂材质与光照效果处理:能够处理复杂的材质属性,如透明度、反射、阴影等,生成逼真的光照效果,即使在复杂的光照条件下也能保持输出的高质量。

主要特点

- 数据驱动的泛化能力:通过在合成的多光照数据和大量自动标注的真实世界视频上进行训练,模型能够泛化到各种不同的场景和光照条件,展现出强大的适应性。

- 单次处理的高效性:与传统的两阶段处理方法(先逆向渲染估计场景属性,再正向渲染合成重光照图像)相比,UniRelight在一次处理中完成反照率估计和重光照合成,避免了中间步骤的误差累积,提高了效率和输出质量。

- 灵活的监督学习:能够利用多种数据源进行训练,包括高质量的合成数据、多光照数据以及自动标注的真实世界数据,这种混合训练策略使得模型在处理复杂光照效果时表现更佳,同时显著提升了对未见领域的泛化能力。

工作原理

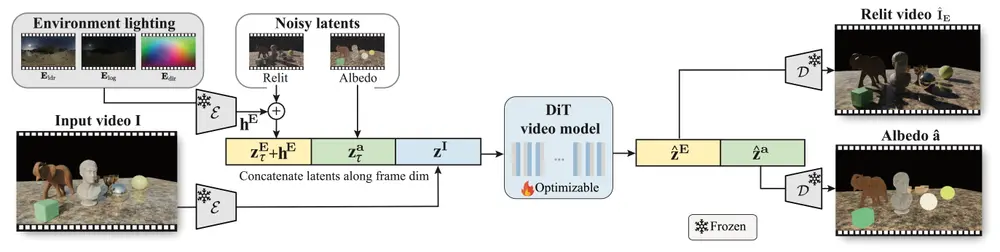

UniRelight基于视频扩散模型(Video Diffusion Models, VDMs),通过以下步骤实现其功能:

- 输入编码:使用预训练的变分自编码器(VAE)将输入视频、目标光照条件以及反照率分别编码到一个低维的潜在空间中,得到对应的潜在张量。

- 联合潜在表示:将编码后的输入视频、反照率和重光照视频的潜在表示在时间维度上进行拼接,形成一个联合的潜在序列。同时,引入类型嵌入(type embeddings)来区分不同的模态(输入视频、反照率、重光照视频),并通过条件掩码(condition mask)来指示哪些帧作为条件输入,哪些作为去噪目标。

- 光照编码:对于环境光照,采用三种互补的表示方式(LDR全景图、归一化的对数强度图和方向编码)来处理HDR光照信息,这些表示通过VAE编码器得到的潜在特征与重光照视频的潜在表示在通道维度上进行拼接。

- 去噪与生成:利用基于Transformer的去噪函数(DiT模型)对联合潜在序列进行去噪处理,通过迭代应用去噪函数,最终从潜在空间中重建出重光照后的视频和反照率。

测试结果

- 定量评估:在合成数据集SyntheticScenes和MIT多光照数据集上,UniRelight在PSNR、SSIM和LPIPS等标准图像质量评估指标上均优于现有的多种重光照方法,如DiLightNet、NeuralGaffer和DiffusionRenderer等,显示出更高的视觉保真度和时间一致性。

- 用户研究:通过用户研究评估了UniRelight的感知质量,参与者被要求比较不同方法生成的重光照结果与真实重光照图像的相似度。结果显示,UniRelight的结果在大多数情况下被用户认为更接近真实图像,尤其是在处理复杂材质和光照效果方面,如透明物体、玻璃、复杂阴影等,表现出了显著的优势。

- 消融研究:通过对比实验验证了联合建模和真实世界自动标注数据对模型性能的提升作用。结果表明,联合建模能够提高模型的泛化能力和重光照质量,而真实世界数据的引入则进一步增强了模型对自然图像的适应性。

应用场景

- 创意内容生成:为影视制作、广告设计等领域提供强大的创意工具,允许艺术家和设计师轻松地改变场景的光照条件,创造出各种独特的视觉效果,从而激发更多的创意灵感。

- 虚拟制作:在虚拟现实(VR)和增强现实(AR)应用中,UniRelight可以实时调整虚拟场景的光照,使其与真实环境的光照相匹配,增强用户的沉浸感和交互体验。

- 视觉效果增强:在游戏开发和视频后期制作中,用于优化场景的光照效果,提升视觉质量,使游戏和视频更具吸引力和真实感。

- 数据增强:在计算机视觉和机器学习领域,UniRelight可以作为数据增强工具,通过生成不同光照条件下的图像和视频数据,帮助训练更鲁棒的视觉模型,提高模型对光照变化的适应能力,从而在自动驾驶、机器人视觉等实际应用中表现出更好的性能。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...