萨里大学与 NetMind.AI 的研究人员联合提出了一种名为 Normalized Attention Guidance(NAG) 的新技术,解决扩散模型中“负引导”(negative guidance)的难题——即在图像或视频生成过程中,如何有效抑制不希望出现的内容特征。

- 项目主页:https://chendaryen.github.io/NAG.github.io

- GitHub:https://github.com/ChenDarYen/Normalized-Attention-Guidance

- ComfyUI-NAG:https://github.com/ChenDarYen/ComfyUI-NAG

这项研究为当前主流的扩散模型控制方法带来了新思路,尤其在少步采样(few-step sampling)场景下表现优异,显著优于传统分类器自由引导(CFG)方式。

什么是负引导?为何重要?

在扩散模型中,“负引导”是指通过提示词明确告诉模型哪些内容不应该出现在最终输出中。例如:“不要眼镜”、“不要模糊”、“不要老虎”等。

然而,在实际应用中,尤其是在少步采样(如4步以内)时,传统的无分类器引导(CFG)往往失效,导致生成结果不稳定、出现伪影,甚至偏离预期。

这主要是因为 CFG 假设正向和负向条件之间的差异是平滑且一致的,而在少步采样阶段,这种假设不再成立。

NAG 是什么?它解决了什么问题?

NAG(Normalized Attention Guidance) 是一种高效、无需训练的负引导机制,直接在注意力空间中操作。其核心思想是:

- 对正向和负向提示的注意力特征进行外推;

- 利用 L1 归一化限制特征偏差;

- 通过 α 混合进一步细化,避免超出数据流形(manifold)的漂移。

这样可以实现稳定、可控的负引导,即使在高引导强度下也能保持生成质量。

NAG 的三大优势

✅ 高效性:几乎不增加计算开销

不同于 CFG 会将每一步的计算量翻倍,NAG 只在跨注意力层或 MM-DiT 模块上引入少量额外计算。

实测数据显示,NAG 在多个主流模型上的推理时间增量远低于 CFG:

| 模型家族 | CFG 增加时间 | NAG 增加时间 |

|---|---|---|

| Wan2.1 | +10.7 秒 | +1.3 秒 |

| SANA | +35 毫秒 | +5 毫秒 |

| SDXL | +25 毫秒 | +17 毫秒 |

| SD3.5-Large | +219 毫秒 | +109 毫秒 |

| Flux | +488 毫秒 | +426 毫秒 |

✅ 通用性:适用于多模态、多架构

NAG 不依赖特定模型架构,可广泛应用于:

- 图像生成(如 SDXL、SD3.5)

- 视频生成(如 SANA、Flux)

- 多模态模型(MM-DiT)

同时支持不同采样机制(少步 / 多步),是一个真正意义上的“插件式”解决方案。

✅ 稳定性:L1归一化+α混合确保一致性

通过逐点 L1 归一化和特征混合策略,NAG 能够有效约束特征方向和幅度,防止因过度引导造成的失真,提升整体稳定性。

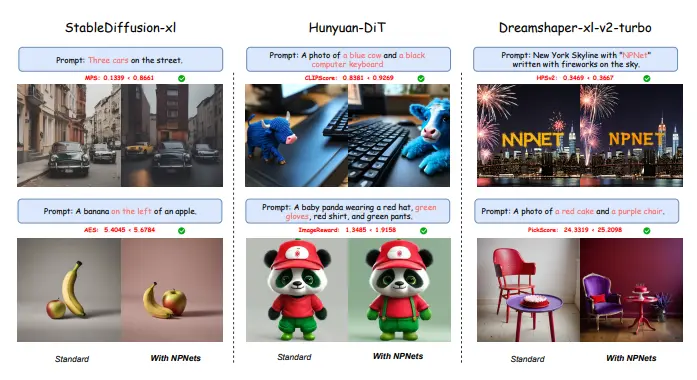

测试结果:显著提升文本对齐与视觉质量

在多种模型和采样条件下,NAG 表现出色:

以 Flux-Schnell(仅4步采样)为例:

| 指标 | 基线(无NAG) | 使用NAG |

|---|---|---|

| CLIP分数(文本对齐) | 31.4 | 32.0 |

| FID(图像质量) | 25.47 | 24.46 |

| PFID(感知相似度) | 38.26 | 34.95 |

| ImageReward(人类偏好) | 1.029 | 1.099 |

用户调研也显示,使用 NAG 生成的图像和视频在文本匹配度、视觉吸引力和运动连贯性方面均获得更高评分。

应用场景

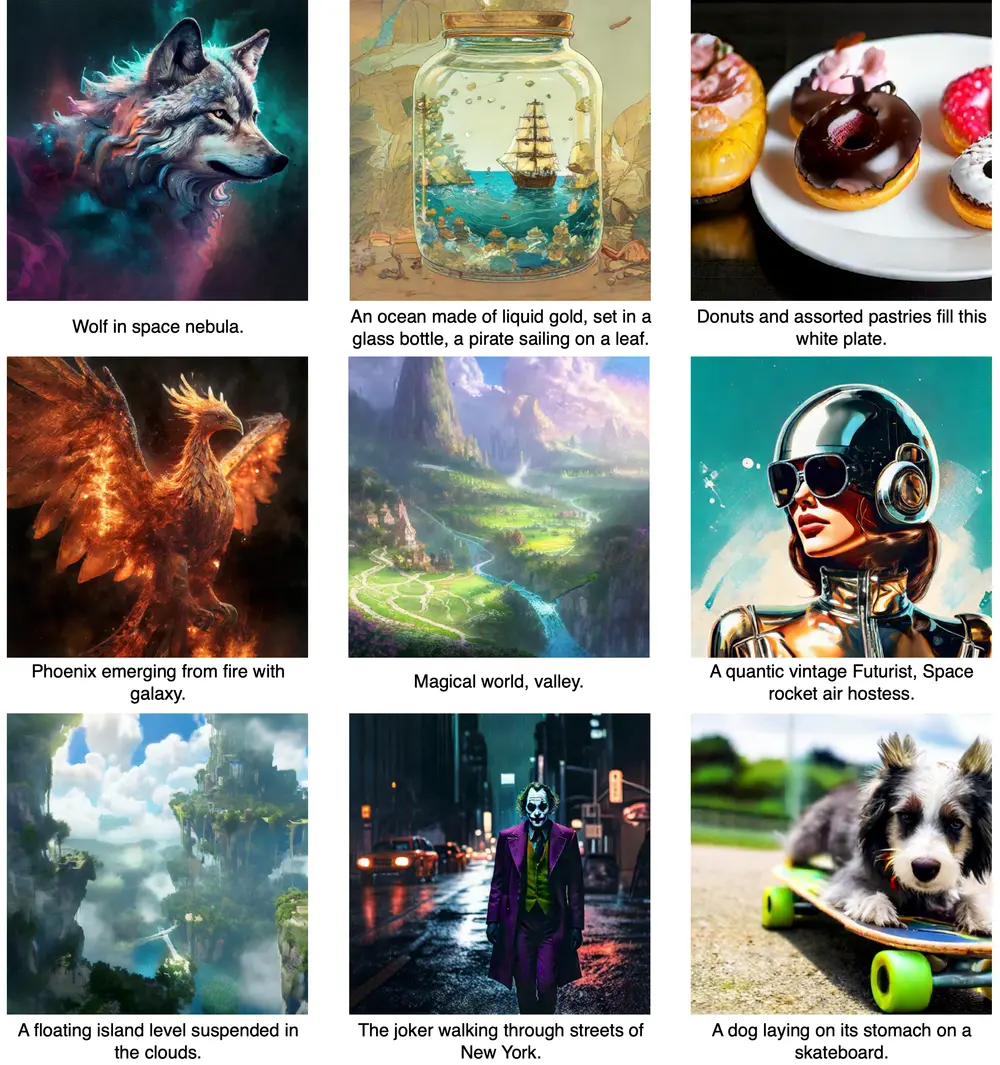

🖼️ 图像生成

- 精确去除特定元素(如“模糊”、“低分辨率”、“错误对象”)

- 控制风格与语义内容(如“不要写实风”、“不要卡通”)

🎥 视频生成

- 抑制不必要视觉元素(如“不要静态画面”)

- 增强动态表现力和语义一致性

🎨 创意设计

- 设计师可通过负提示精准控制生成结果,提高创作效率和自由度

🔐 内容安全与质量控制

- 自动过滤低质、违规或不适当内容,保障生成内容合规性

相关文章