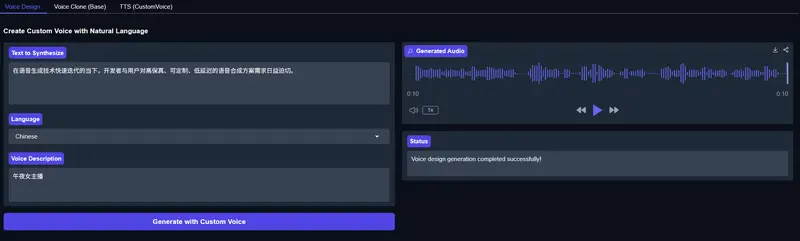

在语音生成技术快速迭代的当下,开发者与用户对高保真、可定制、低延迟的语音合成方案需求日益迫切。阿里Qwen项目组推出的 Qwen3-TTS 开源全家桶,凭借音色克隆、音色创造、拟人化语音生成与自然语言指令控制四大核心能力,构建起一套覆盖多场景需求的语音生成工具链。依托自研的 Qwen3-TTS-Tokenizer-12Hz 多码本语音编码器与 Dual-Track 双轨建模架构,Qwen3-TTS 实现了高效压缩、低延迟流式生成与跨语种高质量语音输出,为全球化应用提供了强大技术支撑。

- 项目主页:https://qwen.ai/blog?id=qwen3tts-0115

- GitHub:https://github.com/QwenLM/Qwen3-TTS

- Hugging Face:https://huggingface.co/collections/Qwen/qwen3-tts

- 魔塔:https://modelscope.cn/collections/Qwen/Qwen3-TTS

- Hugging Face Demo:https://huggingface.co/spaces/Qwen/Qwen3-TTS

- 魔塔DEMO:https://modelscope.cn/studios/Qwen/Qwen3-TTS

目前,Qwen3-TTS 全系列模型已在 GitHub 开源,同时支持通过 Qwen API 快速体验,模型包含 1.7B 与 0.6B 两种尺寸,兼顾极致性能与轻量化部署需求。

模型矩阵:双尺寸覆盖多元需求

Qwen3-TTS 提供 1.7B 和 0.6B 两类模型,分别针对“极致性能”与“均衡效率”设计,全面支持 10 种主流语言(中、英、日、韩、德、法、俄、葡萄牙、西班牙、意大利语)及多种方言音色,满足不同场景的开发需求。

1. 1.7B 模型:高性能旗舰之选

| 模型名称 | 核心功能 | 语种支持 | 流式生成 | 指令控制 |

|---|---|---|---|---|

| Qwen3-TTS-12Hz-1.7B-VoiceDesign | 基于文本描述定制全新音色 | 10种主流语言 | ✅ | ✅ |

| Qwen3-TTS-12Hz-1.7B-CustomVoice | 目标音色风格控制;内置9款精品音色 | 10种主流语言 | ✅ | ✅ |

| Qwen3-TTS-12Hz-1.7B-Base | 3秒快速音色克隆;支持微调迁移 | 10种主流语言 | ✅ | - |

2. 0.6B 模型:轻量化高效之选

| 模型名称 | 核心功能 | 语种支持 | 流式生成 | 指令控制 |

|---|---|---|---|---|

| Qwen3-TTS-12Hz-0.6B-CustomVoice | 内置9款精品音色,支持风格调整 | 10种主流语言 | ✅ | ✅ |

| Qwen3-TTS-12Hz-0.6B-Base | 3秒快速音色克隆;支持微调迁移 | 10种主流语言 | ✅ | - |

核心技术特性:四大亮点打造行业领先体验

Qwen3-TTS 的技术优势源于自研编码器、创新架构与智能控制能力的深度融合,具体体现在四个核心维度:

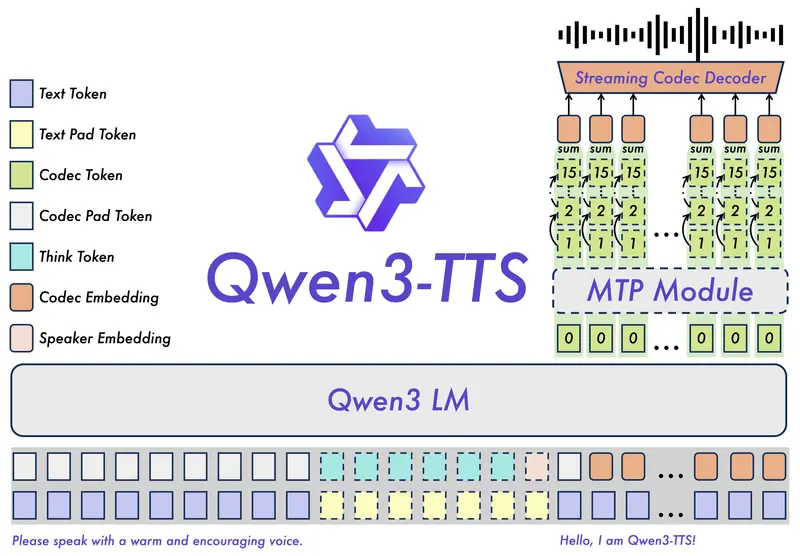

1. 超强语音表征:无损保留声学细节

基于 Qwen3-TTS-Tokenizer-12Hz 多码本语音编码器,实现对语音信号的高效压缩与高维语义建模,完整保留副语言信息(如语气、停顿、情感)与声学环境特征。搭配轻量级非 DiT 架构,在降低计算开销的同时,实现高保真语音还原,大幅提升生成语音的自然度与真实感。

2. 端到端架构:规避级联误差,提升通用性

采用离散多码本 LM 架构,实现语音全信息端到端建模,彻底摒弃传统“LM+DiT”方案的级联链路,从根源上消除信息瓶颈与误差累积问题。这一设计不仅提升了模型的通用性,还显著优化了生成效率与效果上限。

3. 极致低延迟:单字符触发首包输出

创新的 Dual-Track 混合流式生成架构,让单模型同时兼容流式与非流式生成模式。最快可在输入单个字符后即刻输出音频首包,端到端合成延迟低至 97ms,完全满足实时语音交互(如智能客服、虚拟助手)的严苛延迟要求。

4. 智能语义控制:所想即所听的拟人化表达

支持自然语言指令驱动的多维语音控制,用户可通过文本描述灵活调控音色、情感、韵律等声学属性。同时,模型具备深度上下文理解能力,能根据输入文本的语义自适应调整语气、节奏与情感表达,实现“内容决定风格”的拟人化语音生成效果。

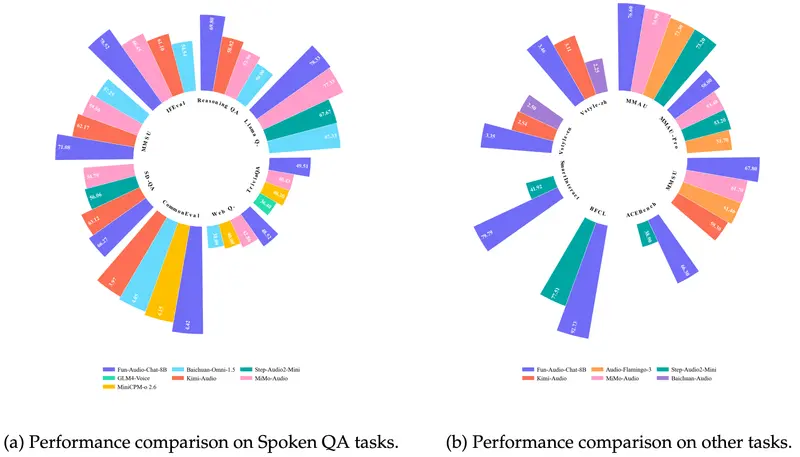

性能实测:多项指标达到 SOTA 水平

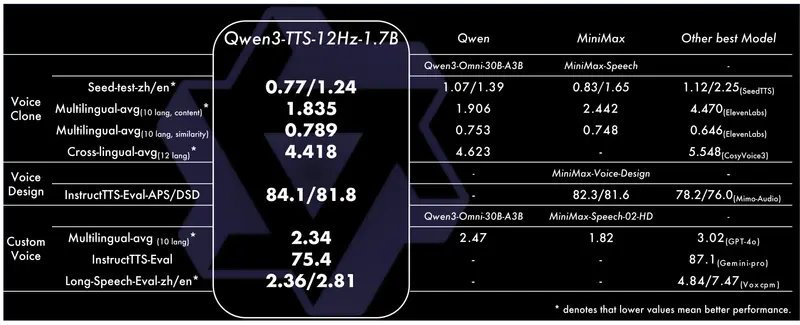

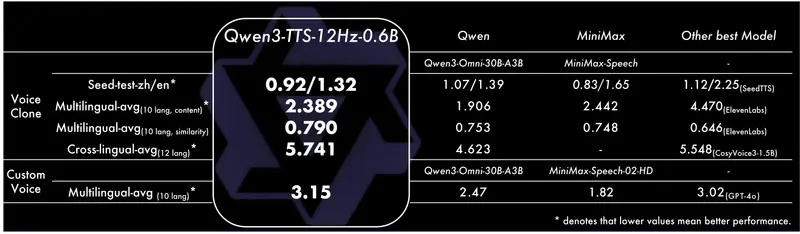

Qwen3-TTS 在音色创造、控制、克隆三大核心任务中,均展现出超越同类开源模型的性能,部分指标甚至优于闭源方案:

1. 音色创造任务

Qwen3-TTS-VoiceDesign 在 InstructTTS-Eval 基准测试中,指令遵循能力与生成表现力全面超越 MiniMax-Voice-Design 闭源模型,大幅领先其他开源竞品,可精准还原文本描述的音色特征与人设属性。

2. 音色控制任务

Qwen3-TTS-Instruct 具备强大的单人多语言泛化能力,平均词错率低至 2.34%;在保持目标音色不变的前提下,风格控制能力评分达 75.4%;同时支持10分钟长语音生成,中英词错率分别仅为 2.36% 和 2.81%,长文本生成稳定性表现优异。

3. 音色克隆任务

Qwen3-TTS-VoiceClone 在 Seed-tts-eval 测试中,中英文克隆语音的稳定性超越 MiniMax 和 SeedTTS;在 TTS multilingual test set 上,10个语种的平均词错率为 1.835%,说话人相似度达 0.789,超越 MiniMax 和 ElevenLabs;跨语种音色克隆能力同样位居 SOTA,优于 CosyVoice3。

4. Tokenizer 性能:近乎无损的语音重构

在 LibriSpeech test-clean 数据集的语音重构评估中,Qwen-TTS-Tokenizer 关键指标达到行业领先水平:

- 感知语音质量评估(PESQ):宽带 3.21、窄带 3.68,大幅领先同类 Tokenizer;

- 短时客观可懂度(STOI):0.96;

- 语音自然度(UTMOS):4.16;

- 说话人相似度:0.95,实现近乎无损的说话人信息保留。

典型应用场景:解锁语音生成多元玩法

Qwen3-TTS 的功能特性,适配多样化的语音生成需求,典型应用场景包括:

1. 音色创造:文本描述定制专属声音

通过输入声学属性、人设背景等自然语言描述,即可生成定制化音色。例如输入“温暖治愈的女性声线,语速偏慢,带轻微的江南口音”,模型可精准生成符合描述的语音,满足内容创作、虚拟主播等场景的个性化需求。

2. 音色复用:多轮对话的稳定音色输出

支持将创造的音色持久化存储,在多轮次、多角色的长篇章对话生成中,保持音色的一致性与稳定性,适用于有声书录制、剧本配音等场景。

3. 音色控制:固定音色的风格灵活调整

基于内置的9款精品音色(如苏瑶、福伯、晓东等),通过指令调整语音的情感(如开心、严肃、悲伤)、语速、韵律,实现同一音色的多样化表达。

4. 快速克隆:3秒复刻目标声音

仅需3秒目标人物的语音片段,即可快速克隆音色,支持微调迁移至其他模型,适用于个性化语音助手、客服话术定制等场景。

相关文章