在目前大语言模型方面最强的要数ChatGPT、Claude和Gemini,这些都是闭源模型,而且在国内使用也不太方便,而强大的llama3发布后,日常一些工作其实使用开源大模型就足够,这些大模型可以在本地运行,不仅可以聊天还可以编程,让你在本地打造一个完全专属的 GPT,不过每个开源模型都单独安装的话,会非常麻烦,目前已经多个开发者打造了 AI 程序帮你在本地运行大模型,一起来看看吧!

Ollama

Ollama 是一个开源的框架,专门设计用于简化在本地机器上部署和管理大语言模型,Ollama 提供了简单的命令行界面(CLI),用户可以通过一条命令快速启动和运行大型模型,支持多种预构建的模型,用户可以从官方模型库中选择并下载所需的模型,Ollama 支持多种操作系统,包括 macOS、Windows 和 Linux,并且提供了 Docker 镜像,以方便在不同环境中部署。

官网地址:https://ollama.com

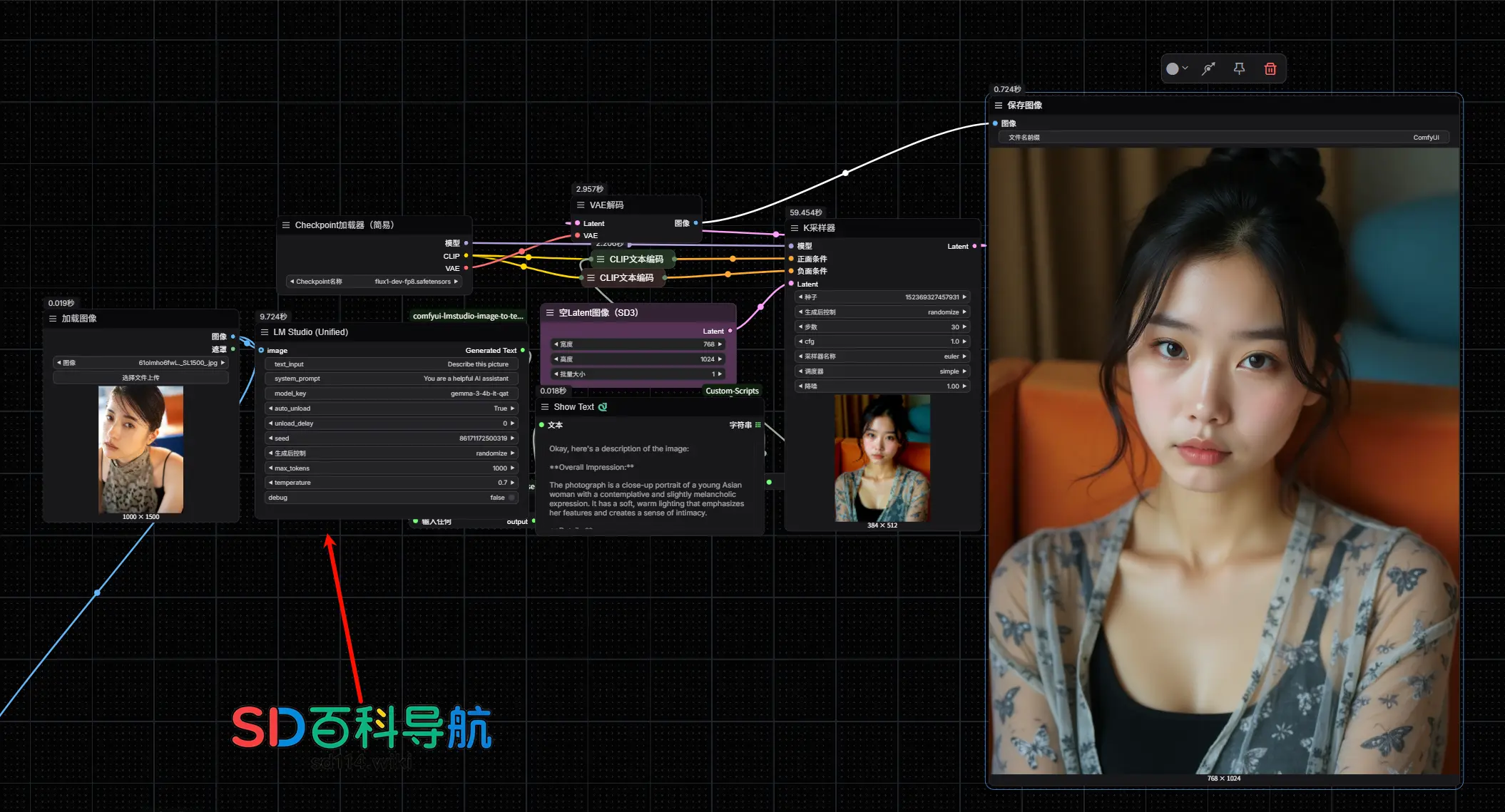

LM Studio

LM Studio 是一个可以帮你在本地运行大语言模型的开源程序,用于在本地实验和运行本地和开源的大语言模型 (LLMs)。LM Studio 跨平台桌面应用程序允许您从 Hugging Face 下载和运行任何 ggml Llama、MPT 和 StarCoder 兼容的模型,并提供了一个简单而强大的模型配置和推理界面。该应用程序在有显卡的情况下利用您的显卡。LM Studio 适用于个人用户,可完全离线在笔记本电脑上运行开源模型。可以通过应用程序的聊天界面或与 OpenAI 兼容的本地服务器使用模型。目前的缺点就是强制安装在 C 盘,对于 C 盘空间不足的朋友可能不太友好。

官网地址:https://lmstudio.ai

GitHub 地址:https://github.com/lmstudio-ai

Jan

Jan 是一个帮助你在本地运行开源大模型的程序,支持 Windows、Mac 和 Linux 多平台,移动端即将推出,可以从它上面方便的下载并运行开源大语言模型,并且能在本地提供一个兼容 ChatGPT API 协议的 Web 服务。它提供了一个类似于 ChatGPT 的聊天界面,可以基于它聊天,并且可以保留聊天历史。目前的缺点就是强制安装在 C 盘,对于 C 盘空间不足的朋友可能不太友好。

官网地址:https://jan.ai

GitHub 地址:https://github.com/janhq/jan

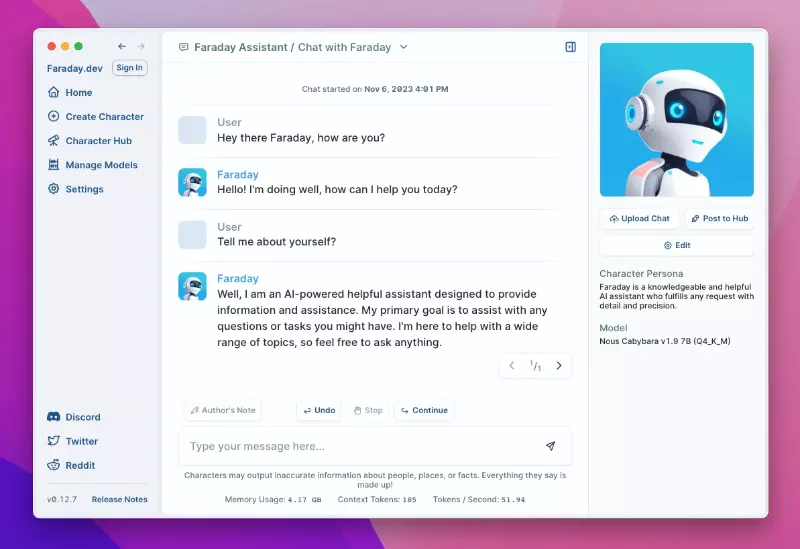

Faraday.dev

Faraday 与上面两款应用相似,同样是可以在本地运行开源大模型,目前支持支持 Windows、Mac,Faraday 内置了很多角色,大家下载模型后就直接与角色进行对话,大家也可以自定义角色。Faraday 可以用于各种场景,包括娱乐、学习和办公等。它可以帮助用户解答问题、提供建议、进行闲聊等。

官网地址:https://faraday.dev

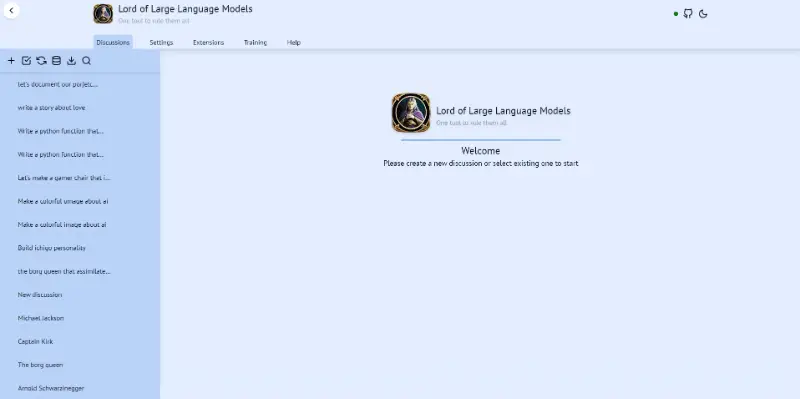

LoLLMS Web UI

LoLLMS Web UI 是一个可在本地运行大模型的开源程序,该项目旨在为广泛的任务提供一个用户友好的界面,以便访问和利用各种 LLM 模型。无论您需要在写作、编码、数据组织、生成图像或寻找问题答案方面需要帮助,LoLLMS WebUI 都能满足您的需求。目前 LoLLMS Web UI 支持 Windows、Mac 和 Linux 多平台。

GitHub 地址:https://github.com/ParisNeo/lollms-webui

GPT4All

GPT4All 是一个开源程序,允许任何人在日常硬件上训练和部署功能强大且定制化的大语言模型(LLM),GPT4All 软件经过优化,可以在笔记本电脑、台式机和服务器的 CPU 上运行 3 -13 亿参数的大型语言模型进行推断。

官网地址:https://gpt4all.io

GitHub 地址:https://github.com/nomic-ai/gpt4all

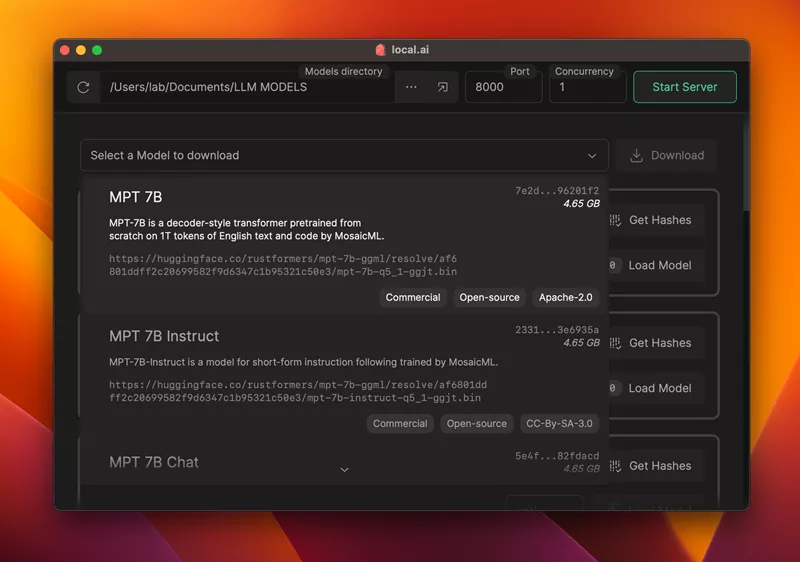

local.ai

local.ai 是一个可以在本地运行开源大模型的程序,由 Rust 语言打造,它可以与 window.ai 一起使用,作为一种立即启动并运行本地推理服务器的简单方法。window.ai + local.ai 使每个 Web 应用程序都可以利用 AI,而无需开发人员或用户承担任何费用!

GitHub 地址:https://github.com/louisgv/local.ai

window.ai 地址:https://github.com/alexanderatallah/window.ai

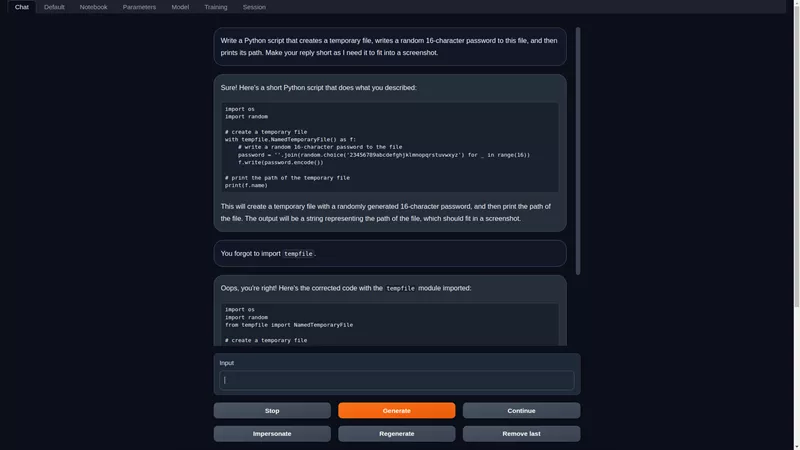

Text generation web UI

Text generation web UI 号称要做大语言模型领域的 AUTOMATIC1111/stable-diffusion-webui,Text generation web UI 可为开源大模型提供能够快速上手的网页界面,不仅可以提高使用效率,还可满足私有化部署,或对模型进行自定义。目前,该 Web UI 已经支持了许多流行的语言模型,包括 LLaMA、llama.cpp、GPT-J、Pythia、OPT、GALACTICA 等。

GitHub 地址:https://github.com/oobabooga/text-generation-webui

相关文章