阿里巴巴通义实验室 HumanAIGC 团队近日将推出 Wan-Animate —— 一个基于 Wan 系列模型构建的统一人物动画与角色替换框架。

- 项目主页:https://humanaigc.github.io/wan-animate

- GitHub:https://github.com/Wan-Video/Wan2.2

- 模型:Hugging Face | 魔塔

- Demo:Hugging Face | 魔塔

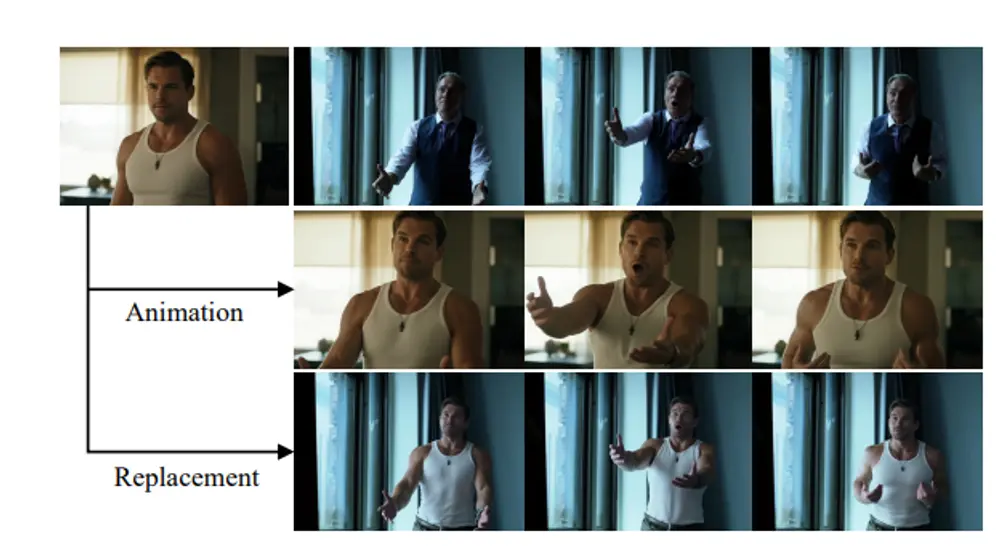

给定一张静态人物图像和一段参考视频,Wan-Animate 能够:

- 将图像中的人物“动起来”,复现视频中的动作与表情(角色动画)

- 或将该人物无缝替换进原视频场景,保留光照、色调与环境氛围(角色替换)

该框架在生成质量、动作还原度和环境融合方面达到当前开源方案中的领先水平,并承诺将开源模型权重与完整代码,推动社区在数字人、虚拟内容创作等方向的发展。

核心能力概览

| 模式 | 功能说明 |

|---|---|

| 动画模式 | 输入单张角色图 + 动作视频 → 输出该角色按参考动作表演的动画视频 |

| 替换模式 | 输入角色图 + 原始场景视频 → 替换原角色,生成自然融合的新视频 |

✅ 支持高保真面部表情重建

✅ 实现精确肢体运动复制

✅ 自动匹配目标场景光照与色彩风格

主要功能

| 功能 | 描述 |

|---|---|

| 角色动画生成 | 基于参考视频驱动静态图像,生成具有连续动作和表情的视频 |

| 角色替换合成 | 将新角色嵌入原始视频,替代原有主体,保持场景一致性 |

| 高保真输出 | 在时间连贯性、细节还原度和真实感方面表现优异 |

| 环境融合增强 | 通过专用模块自动适配光照与色调,避免“贴图感” |

技术特点

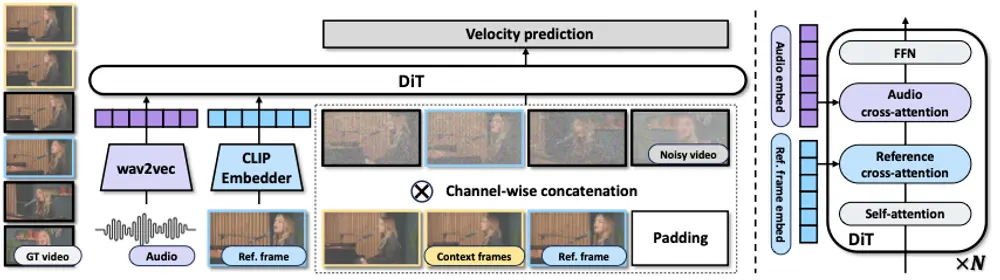

1. 统一输入范式,多任务一体化设计

Wan-Animate 采用修改后的输入表示方式,将以下三种信号统一编码为潜变量输入:

- 角色外观(源图像)

- 动作引导(骨架/姿态序列)

- 场景环境(参考视频帧)

并通过二进制掩码区分“参考条件”与“生成区域”,使动画与替换任务共享同一模型架构,减少冗余训练。

2. 高可控性的双路径控制机制

👤 面部表情控制

- 使用参考视频中的原始面部帧作为驱动信号

- 通过编码器提取隐式面部特征

- 利用交叉注意力机制注入扩散过程,实现细腻的表情迁移

🧍 身体动作控制

- 采用空间对齐的骨骼关键点(skeleton signal)作为身体运动表征

- 平衡动作准确性与跨姿态泛化能力

- 支持从复杂舞蹈到日常行为的广泛动作复现

3. 环境融合:Relighting LoRA 模块

在角色替换任务中,光照不一致是导致“违和感”的主要来源。为此,团队开发了轻量级 Relighting LoRA 模块:

- 学习原始场景的光照分布与色彩风格

- 在保持人物外观不变的前提下,动态调整其明暗、阴影与色温

- 实现更自然的视觉融合效果

4. 高效训练策略

采用分阶段渐进式训练流程:

- 先训练身体控制:固定面部,专注学习姿态迁移

- 再训练面部表达:冻结身体模块,优化表情同步

- 最后联合微调:整体优化协调性与时间一致性

显著加快收敛速度,提升最终生成质量。

工作原理简述

| 步骤 | 说明 |

|---|---|

| 基础模型 | 基于 Wan-I2V(图像到视频)架构,经过后训练增强时序建模能力 |

| 输入构成 | 包括噪声潜变量、条件潜变量和二进制掩码,指导不同信号的注入路径 |

| 动作驱动 | 骨架信号经空间对齐后注入初始噪声潜变量 |

| 表情驱动 | 面部图像特征通过编码器提取,并通过交叉注意力影响生成过程 |

| 光照适配 | Relighting LoRA 在推理阶段激活,完成环境风格迁移 |

性能评估结果

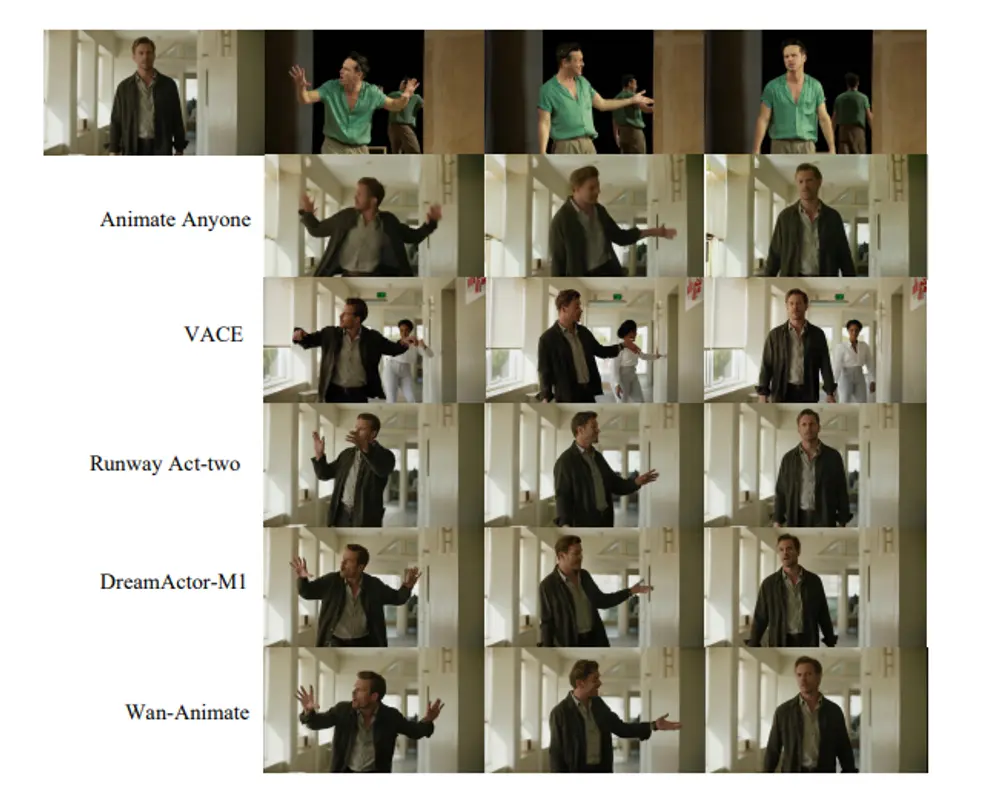

定量指标对比(优于现有开源方法)

| 指标 | 含义 | Wan-Animate 表现 |

|---|---|---|

| SSIM ↑ | 结构相似性 | 显著高于 DreamActor-M1 和 Act-one |

| LPIPS ↓ | 感知差异 | 更接近真实视频分布 |

| FVD ↓ | 视频特征距离 | 时间连贯性更优 |

测试基于自建基准数据集,涵盖多种动作类型与复杂背景。

用户研究(Human Evaluation)

在与 Runway 的 Act-two 和字节跳动的 DreamActor-M1 对比中:

- 78% 的用户认为 Wan-Animate 输出更具真实感

- 82% 认为其动作更自然流畅

- 75% 表示替换结果更易融入原始场景

表明其在主观视觉质量上具备明显优势。

定性表现

在动画模式下,面部微表情(如眨眼、嘴角抽动)还原准确;

在替换模式下,即使面对强逆光、动态打光等复杂场景,也能保持角色与环境的一致性。

典型应用场景

示例 1:角色动画

你有一张游戏角色立绘,想让它跳起 TikTok 上的热门舞蹈。

使用 Wan-Animate,只需提供这张图像和一段跳舞视频,即可生成该角色“亲自出演”的动画片段,适用于游戏宣传、虚拟偶像运营等场景。

示例 2:影视角色替换

你想将某电影片段中的演员替换成自定义形象(如动漫角色),同时保持原片的灯光、镜头运动和整体氛围。Wan-Animate 可实现高质量替换,输出视觉上难以察觉拼接痕迹的结果。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...