新加坡国立大学和微软研究院的研究团队提出了一种全新的扩散采样策略——区域自适应采样 (Region-Adaptive Sampling, RAS)。这是首个允许采样率在图像不同区域间动态变化的扩散采样方法。通过将处理能力集中在模型当前感兴趣的区域,RAS 在相同的推理预算内显著提高了生成质量,同时实现了高达 2 倍的加速。

动机与背景

扩散模型(Diffusion Models, DM)近年来因其强大的生成能力而备受关注,能够生成高质量的数据,广泛应用于图像、音频和文本等领域。然而,传统的扩散模型依赖于逆时间生成随机或常微分方程(SDE/ODE)的求解,这需要多次顺序前向传递大型神经网络,限制了其实时应用能力。

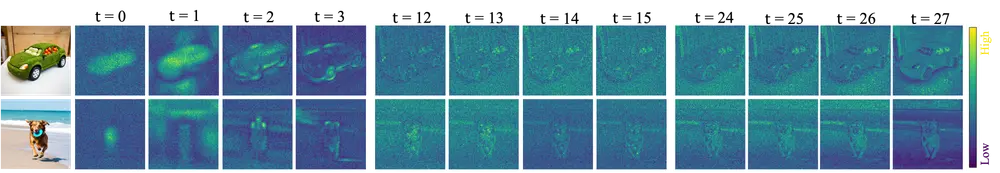

与基于 U-Net 的传统扩散模型不同,DiT(Diffusion Transformers) 提供了灵活处理任意数量 token 的能力,为设计新的采样方法打开了大门。研究团队观察到以下两个关键现象:

- 步骤间的连续性:在扩散后期阶段,相邻步骤中的焦点区域表现出较高的连续性。

- 语义区域的关注:在每个采样步骤中,模型倾向于关注图像中特定的语义上有意义的区域。

基于这些洞察,研究团队提出了 RAS 方法,允许模型根据兴趣区域动态调整采样速率,从而优化计算资源分配。

例如,在使用 Stable Diffusion 3 生成图像时,传统的采样方法会均匀地处理图像的每个区域。而 RAS 会识别出图像中更重要的区域(如主体部分),并为这些区域分配更多的采样步骤,而对于背景等不重要的区域则减少采样步骤。这样可以在保持图像质量的同时,显著减少计算量。

主要功能

- 动态区域采样:RAS 能够根据扩散模型在每个采样步骤中的注意力焦点,动态调整图像不同区域的采样比例。

- 高效生成加速:通过减少不重要区域的计算量,RAS 显著提高了扩散模型的生成速度,速度提升可达 2.36 倍以上。

- 保持生成质量:即使在减少采样步骤的情况下,RAS 仍能保持与传统方法相当的生成质量,确保生成图像的细节和语义一致性。

- 用户研究验证:通过用户研究,RAS 在人类评估中表现出与默认采样方法相当的质量,同时速度提升 1.6 倍。

主要特点

- 基于注意力的区域识别:RAS 利用扩散模型的输出噪声标准差来识别当前步骤中的重要区域,并利用这些区域的连续性来指导后续步骤。

- 灵活的采样比例调整:RAS 支持动态调整采样比例,允许在不同区域使用不同的采样步骤,从而优化计算资源的分配。

- 缓存机制:RAS 引入了键(Key)和值(Value)缓存机制,避免在注意力模块中重复计算不活跃区域的特征,进一步提高效率。

- 调度优化:RAS 通过动态采样比例和定期重置累积误差,平衡了计算效率和生成质量,确保生成图像的全局一致性。

工作原理

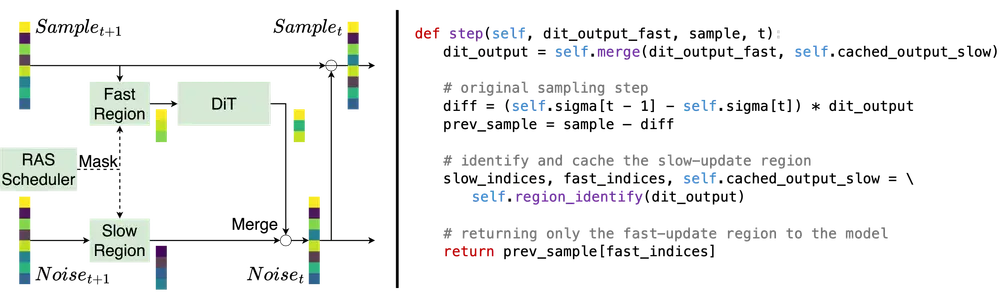

- 区域识别:RAS 在每个采样步骤中计算模型输出噪声的标准差,识别出当前步骤中的重要区域(快更新区域)和不重要区域(慢更新区域)。

- 动态采样:RAS 仅对快更新区域进行模型处理,而慢更新区域则直接使用上一步的噪声输出。这种区域差异化的采样策略减少了不必要的计算。

- 注意力缓存:在注意力模块中,RAS 缓存不活跃区域的键和值,避免在后续步骤中重复计算,同时通过部分更新保持注意力模块的完整性。

- 调度优化:RAS 在扩散过程的早期阶段使用 100% 的采样比例,以确保生成图像的基础结构。在稳定阶段,逐渐降低采样比例,同时定期插入密集步骤以重置累积误差。

评估结果

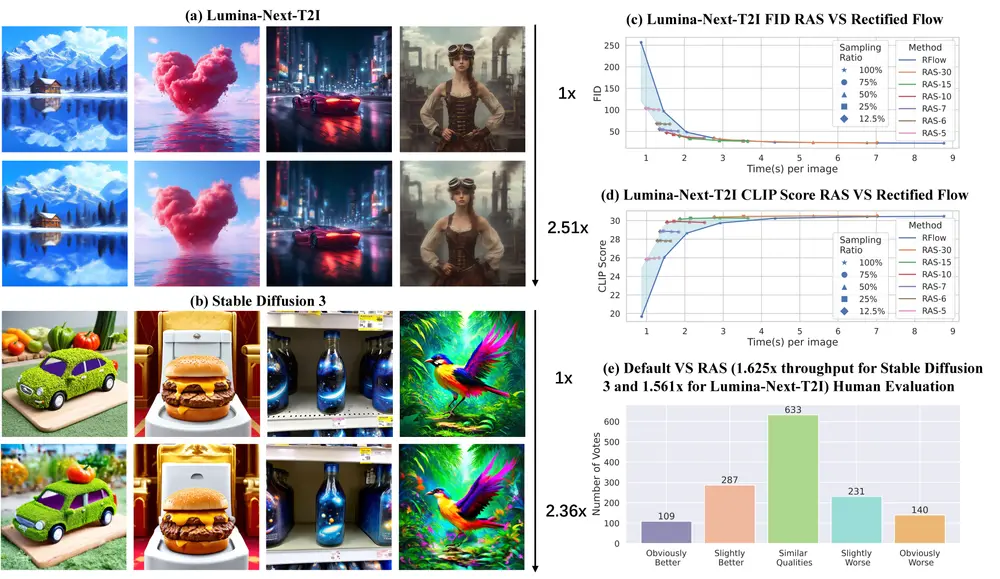

定性结果

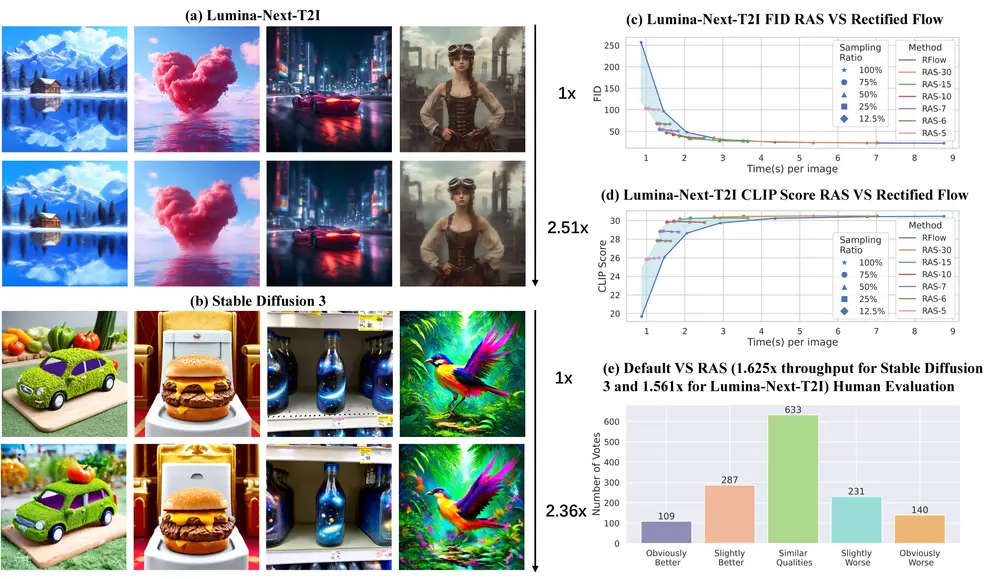

为了评估 RAS 的生成质量,研究团队进行了用户研究。从 Stable Diffusion 3 和 Lumina 的官方研究论文及博客中随机选择了 14 个提示,并为每个提示生成两幅图像:

- 一幅使用密集推理(标准方法)。

- 另一幅使用 RAS。

在 1400 票的人工评估中:

- 45.21% 的票数认为两幅图像的质量相似。

- 28.29% 的票数支持密集推理结果优于 RAS。

- 26.50% 的票数偏爱 RAS 结果优于密集推理。

这些结果表明,RAS 在吞吐量方面实现了显著提升(Stable Diffusion 3 提升 1.625 倍,Lumina-Next-T2I 提升 1.561 倍),而人类对生成质量的偏好几乎没有受到影响。

定量结果

推理效率

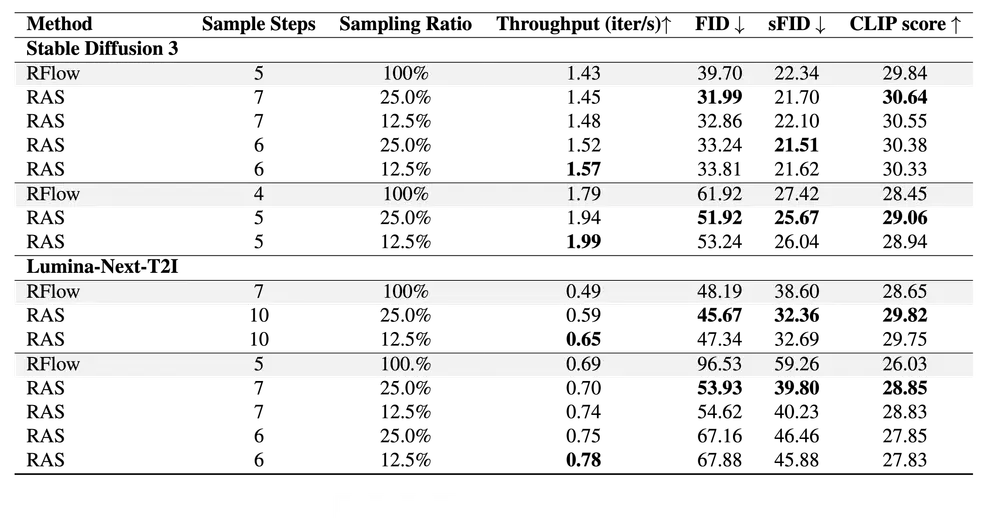

如图 4(c)(d) 所示,RAS 显著减少了每个时间步的推理时间,同时保持了有竞争力的图像质量。与仅降低总时间步数的方法相比,RAS 的质量下降更慢,尤其是在时间步数低于 10 的情况下。

Pareto 改进

在 Stable Diffusion 3 和 Lumina-Next-T2I 的并排比较中,RAS 经常在吞吐量和图像质量之间实现 Pareto 改进。如表 1 所示,对于给定的加速目标,几乎总是存在一个 RAS 配置,能够提供比密集推理基线更好的 FID、sFID 或 CLIP 分数。

实际加速效果

- 使用 Stable Diffusion 3 时,RAS 实现了 1.6 倍的加速,图像质量损失可忽略不计。

- 使用 Lumina-Next-T2I 时,RAS 实现了 1.561 倍的加速,同时保持了生成质量。

具体应用场景

- 图像生成:RAS 可以显著加速 Stable Diffusion 3 和 Lumina-Next-T2I 等扩散模型的图像生成过程,适用于实时图像生成和交互式应用。

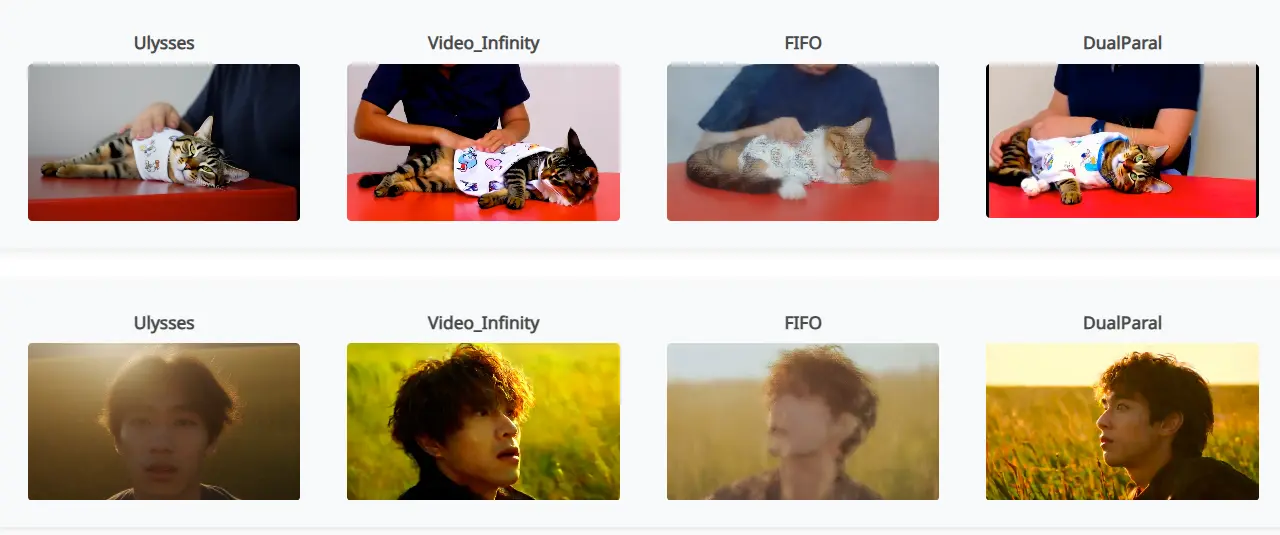

- 视频合成:在视频生成任务中,RAS 可以动态调整每一帧中不同区域的采样比例,提高生成效率,同时保持视频的连贯性和质量。

- 图像编辑:RAS 可以在图像编辑任务中快速生成高质量的编辑结果,例如在 Imagic 等工具中加速文本引导的图像编辑。

- 超分辨率:RAS 可以优化扩散模型在超分辨率任务中的采样过程,减少计算量,同时保持高分辨率图像的质量。

- 多模态生成:RAS 可以应用于多模态生成任务,如从文本生成 3D 模型或视频,通过动态调整采样比例提高生成效率。

相关文章