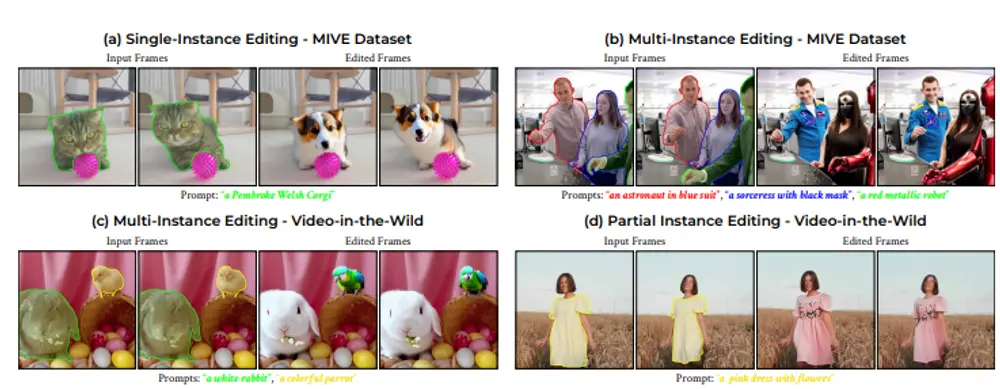

近年来,基于人工智能的视频编辑技术取得了显著进展,用户可以通过简单的文本提示轻松编辑视频。然而,现有的零样本视频编辑方法主要集中在全局或单一对象的编辑上,这可能导致视频其他部分发生意外变化。当需要对多个对象进行局部编辑时,现有方法面临以下挑战:

- 编辑不忠实:编辑后的对象可能失去原有的特征或细节。

- 编辑泄露:编辑意图仅限于特定对象,但可能会无意中影响到视频中的其他元素。

- 缺乏评估标准:当前缺乏专门针对多实例视频编辑的数据集和评估指标。

MIVE框架的提出

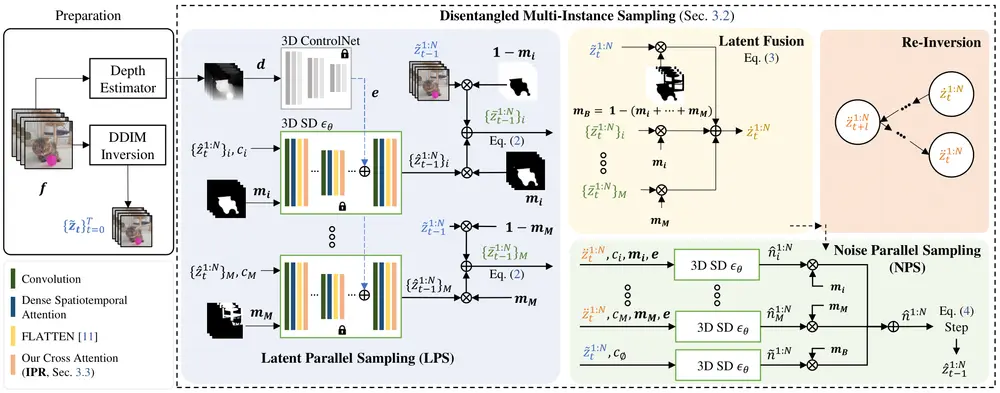

为了解决上述问题,韩国科学技术院、Adobe 研究中心和韩国中央大学的研究人员共同提出了一个零样本多实例视频编辑框架——MIVE(Multi-Instance Video Editing)。MIVE框架能够对视频中的多个独立对象进行精确编辑,而不影响视频中的其他部分。这项技术特别适用于需要对视频中的多个对象进行局部修改的场景,例如改变特定对象的样式、颜色或纹理,同时保持视频的其他部分不变。它通过引入两个关键模块来克服现有方法的局限性:

- 解耦多实例采样(DMS)

- 以实例为中心的概率重分配(IPR)

此外,研究团队还推出了新的MIVE数据集,并引入了跨实例准确率(CIA)评分,用于评估多实例视频编辑任务中的编辑泄露情况。

例如,有一个视频场景,其中包含一个穿着蓝色西装的宇航员和一个红色金属机器人。使用MIVE框架,用户可以仅对宇航员进行编辑,将其西装颜色改为黄色,而机器人的颜色和样式保持不变。MIVE能够理解每个对象的特定编辑需求,并精确地应用这些更改,而不会对视频中的其他对象产生影响。

MIVE的工作原理

1. 解耦多实例采样(DMS)

DMS旨在减少编辑泄露,确保每个实例的编辑不会影响到其他实例。具体实现步骤如下:

- 潜在并行采样:对于每个实例,独立地生成潜在变量(蓝色框),这些变量代表了该实例在视频帧中的潜在表示。

- 潜在融合:将多个去噪后的实例潜在变量融合在一起(黄色框),以协调不同实例之间的关系。

- 重新反转:通过重新反转过程(橙色框),将融合后的潜在变量转换回图像空间。

- 噪声并行采样:最终,通过噪声并行采样(绿色框)生成编辑后的视频帧,确保每个实例的编辑效果独立且一致。

2. 以实例为中心的概率重分配(IPR)

IPR增强了编辑的局部化和忠实度,确保编辑操作精确地应用于目标实例,而不影响其他部分。具体来说,IPR通过调整每个实例的概率分布,使得编辑操作更加集中于目标区域,从而提高编辑的准确性。

数据集与评估指标

为了验证MIVE的有效性,研究团队构建了一个新的MIVE数据集,涵盖了多样化的视频场景,包括室内、室外、动态和静态环境等。此外,他们还引入了跨实例准确率(CIA)评分,用于量化编辑泄露的程度。CIA评分越高,表示编辑泄露越少,编辑效果越忠实。

实验结果与优势

通过广泛的定性和定量评估,以及用户研究,MIVE在以下几个方面表现出显著优势:

- 编辑忠实度:MIVE能够精确地编辑目标实例,保留其原有特征和细节。

- 编辑准确性:IPR模块有效减少了编辑泄露,确保编辑操作仅限于目标区域。

- 防止泄露:DMS模块显著降低了编辑对非目标实例的影响,提高了整体编辑质量。

- 新基准:MIVE在多个评估指标上均优于现有的最先进方法,为多实例视频编辑设定了新的性能标准。

相关文章