随着深度学习技术的发展,图像生成领域取得了显著进展。DiT架构作为一种新兴方法,通过简单地将注意力机制应用于图像连接,实现了任务无关的图像生成。然而,即便投入大量计算资源,生成图像的质量仍有待提升。

阿里通义团队的研究贡献

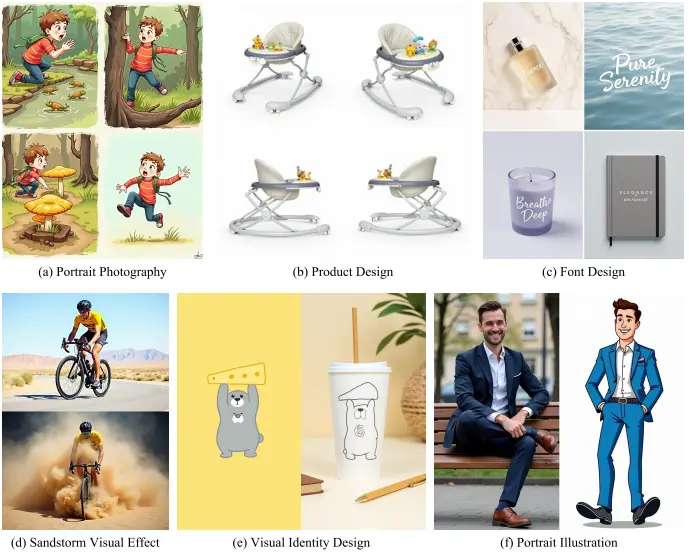

针对上述挑战,阿里通义团队深入研究了DiT架构模型,发现这些模型本质上具备上下文生成能力,仅需轻微调整即可激发其潜力。团队通过一系列多样化任务的实验,验证了现有DiT架构文生图模型的有效性,证实无需额外调整即可实现上下文生成。

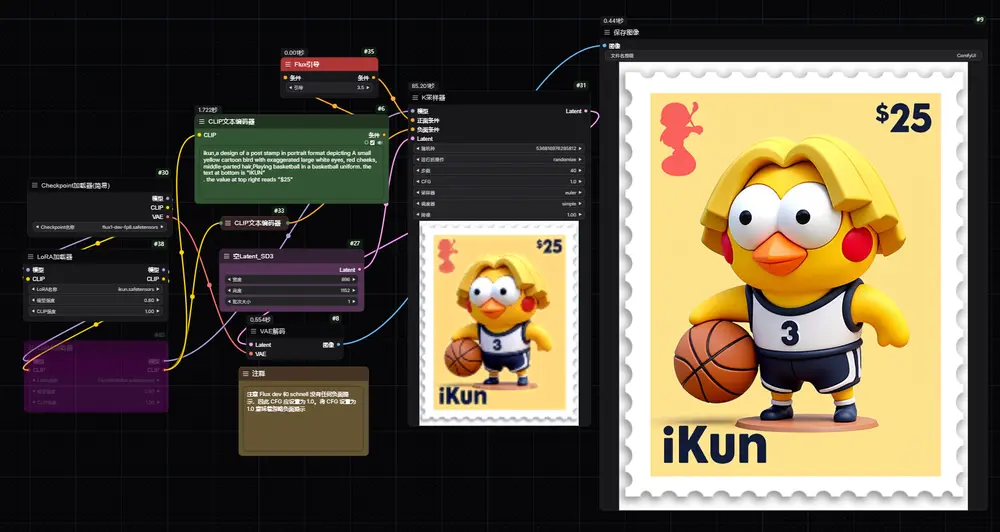

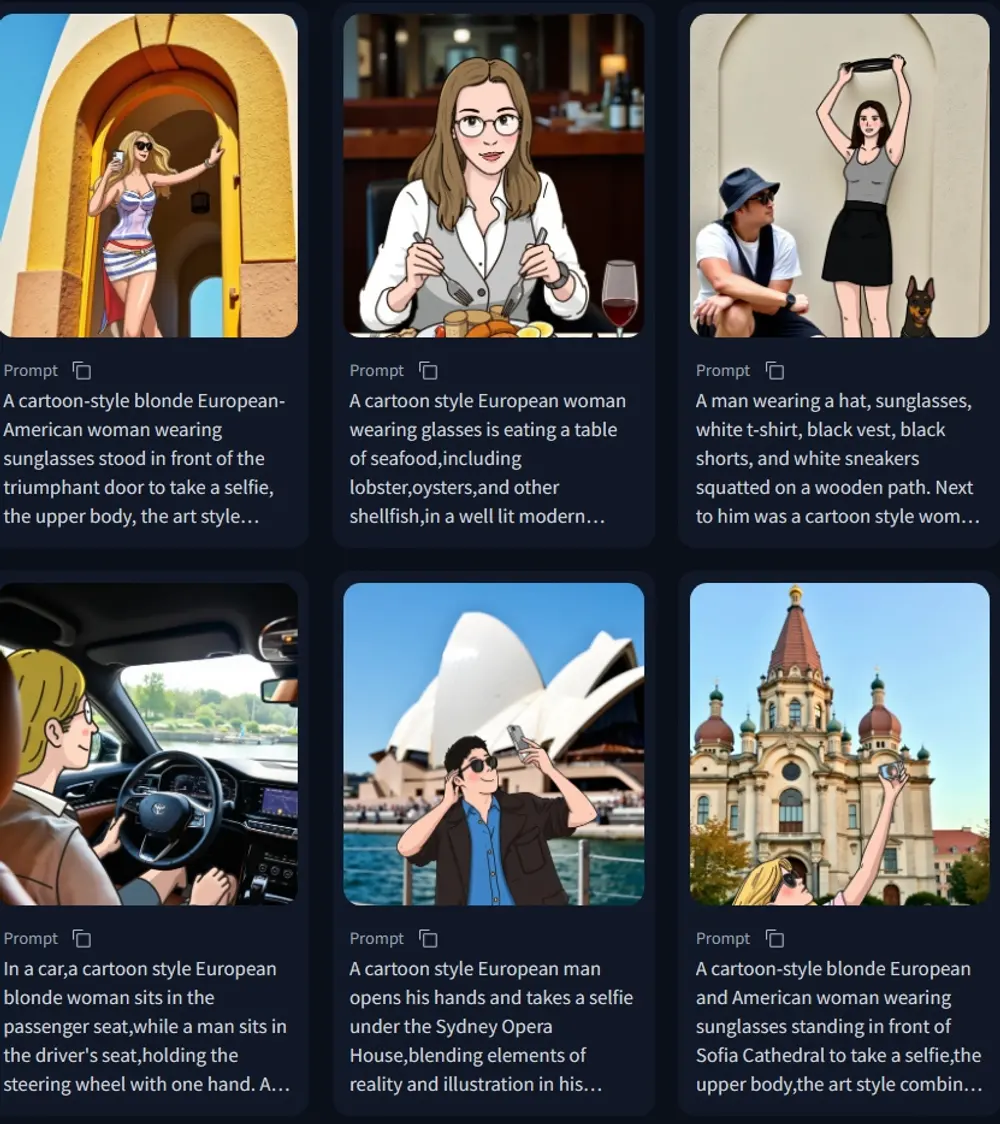

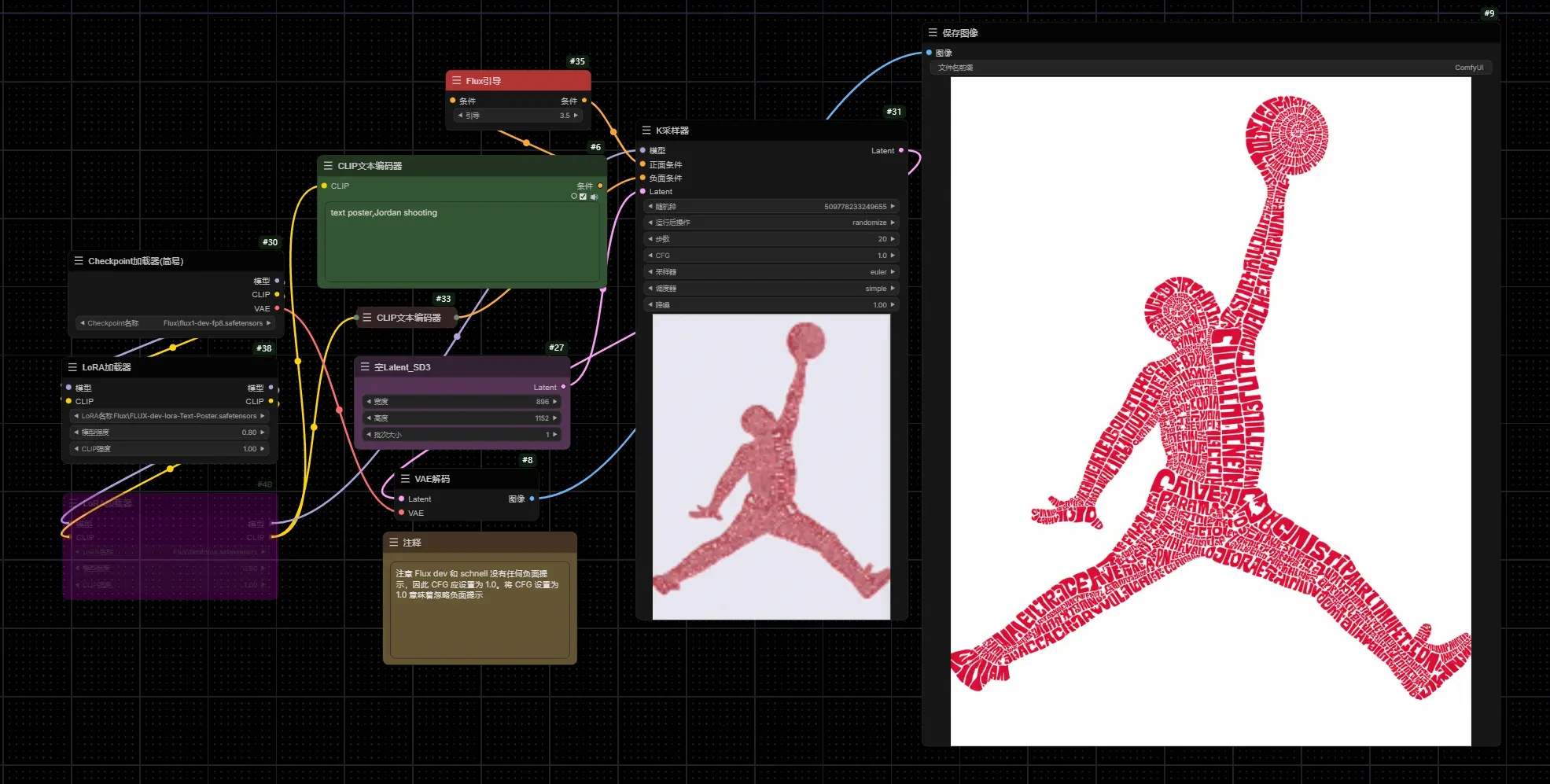

IC-LoRA:创新的图像生成解决方案

基于上述发现,阿里通义团队提出了In-Context LoRA(IC-LoRA),这是一种用于图像生成的新型框架。IC-LoRA旨在通过利用现有的DiT架构模型(Flux模型)的上下文生成能力,来简化和提高图像生成任务的质量和效率。它可以通过提示词基于 Flux 生成主题连贯的三连图、四连图,非常适合内容创作。不过,目前模型并未完全开放,只开源了训练配置和一些测试数据集。

- 项目主页:https://ali-vilab.github.io/In-Context-LoRA-Page

- GitHub:https://github.com/ali-vilab/In-Context-LoRA

- 模型:https://huggingface.co/ali-vilab/In-Context-LoRA

该方案的核心在于:

- 图像连接而非标记:直接处理图像而非标记,以更自然的方式捕捉图像间的联系。

- 多图联合标注:通过同时标注多张图像,增强模型对上下文的理解。

- 小规模数据集微调:采用少量样本(约20至100个)进行特定任务的LoRA调整,避免了大规模数据集带来的高昂成本。

主要功能:

IC-LoRA的主要功能是适应多样化的图像生成任务,同时保持对生成图像的高质量控制。它通过在不需要对原始DiT模型进行任何架构修改的情况下,仅通过调整训练数据来实现对模型的微调。

主要特点:

- 简单性:IC-LoRA的流程非常简单,不需要对原始DiT模型进行任何修改,只需要改变训练数据。

- 高保真度:生成的图像集具有更高的保真度,并且更符合提示的要求。

- 任务无关性:虽然在调整数据时是任务特定的,但框架和流程在架构上保持任务无关,可以适应广泛的任务。

- 数据和计算效率:使用小型数据集(20-100个样本)进行微调,而不是使用大型数据集进行全参数调整,大大减少了计算资源的需求。

成果与展望

IC-LoRA不仅保持了原有DiT模型的结构不变,还通过优化训练数据显著提升了生成图像的保真度和一致性。此外,尽管在数据准备阶段需要针对具体任务做适当调整,但整个框架的设计理念是任务无关的,为后续研究提供了灵活且强大的工具。

示例提示:

为了帮助理解如何根据阿里提供的规范生成多场景图像描述,以下是一个具体的示例:

图像描述示例:

[MOVIE-SHOTS] 在这部电影镜头中,[SCENE-1] <约翰>站在昏暗的房间中央,手中紧握着一把古老的钥匙,背景是一扇半开的木门;[SCENE-2] 转场到一片荒凉的沙漠,<玛丽>骑着一匹骆驼,远处可见几座摇摇欲坠的废墟;[SCENE-3] 最后,画面切换到一座灯火通明的城市,<汤姆>站在高楼顶端,俯瞰着繁忙的街道,表情凝重。

解释

- 前缀 [MOVIE-SHOTS]:表示这是一个电影镜头的描述。

- 整体总结:开头部分简要概述整个图像的内容。

- 场景标记 [SCENE-1]、[SCENE-2]、[SCENE-3]:用于分隔不同的场景描述。

- 角色命名:使用尖括号

< >包裹角色名字,如<约翰>、<玛丽>、<汤姆>。 - 连贯性:确保整个描述连贯,形成一句完整的句子。

- 长度限制:描述总长度不超过512个字。

官方示例:

Prompt: “This set of four images illustrates a young artist's creative process in a bright and inspiring studio; [IMAGE1] she stands before a large canvas, brush in hand, adding vibrant colors to a partially completed painting, [IMAGE2] she sits at a cluttered wooden table, sketching ideas in a notebook with various art supplies scattered around, [IMAGE3] she takes a moment to step back and observe her work, and [IMAGE4] she experiments with different textures by mixing paints directly on the palette, her focused expression showcasing her dedication to her craft.”

相关文章