近年来,角色图像动画技术取得了显著进展,即从参考图像和目标姿态序列生成高质量视频。然而,大多数现有方法仅适用于人体,对拟人化角色(如卡通角色、游戏角色等)的泛化效果不佳。这种限制主要归因于对运动的建模不足,无法理解驱动视频的运动模式,从而将姿态序列僵硬地施加到目标角色上。

为了解决这一问题,蚂蚁集团和阿里巴巴的研究人员提出了 Animate-X,一种基于潜在扩散模型(LDM)的通用动画框架,适用于各种角色类型(统称为 X),包括拟人化角色。例如,你有一张静态的图片,比如一个卡通角色或者一个游戏里的角色,你想让这个角色动起来,就像在动画片或者电影里一样。

Animate-X 的主要特点

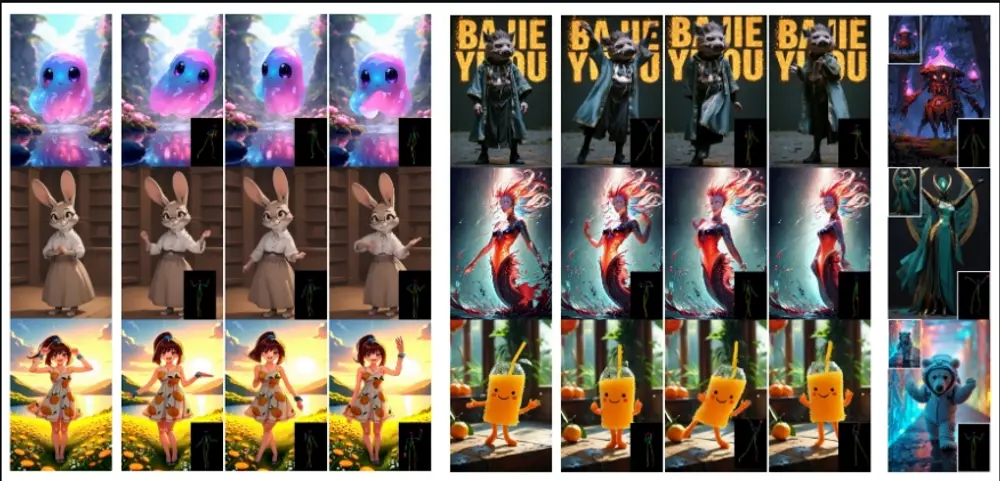

通用性:Animate-X 不仅适用于人类角色,还能处理具有人类特征的非人类角色,如卡通人物、游戏角色和电影中的奇幻生物。

运动表示增强:

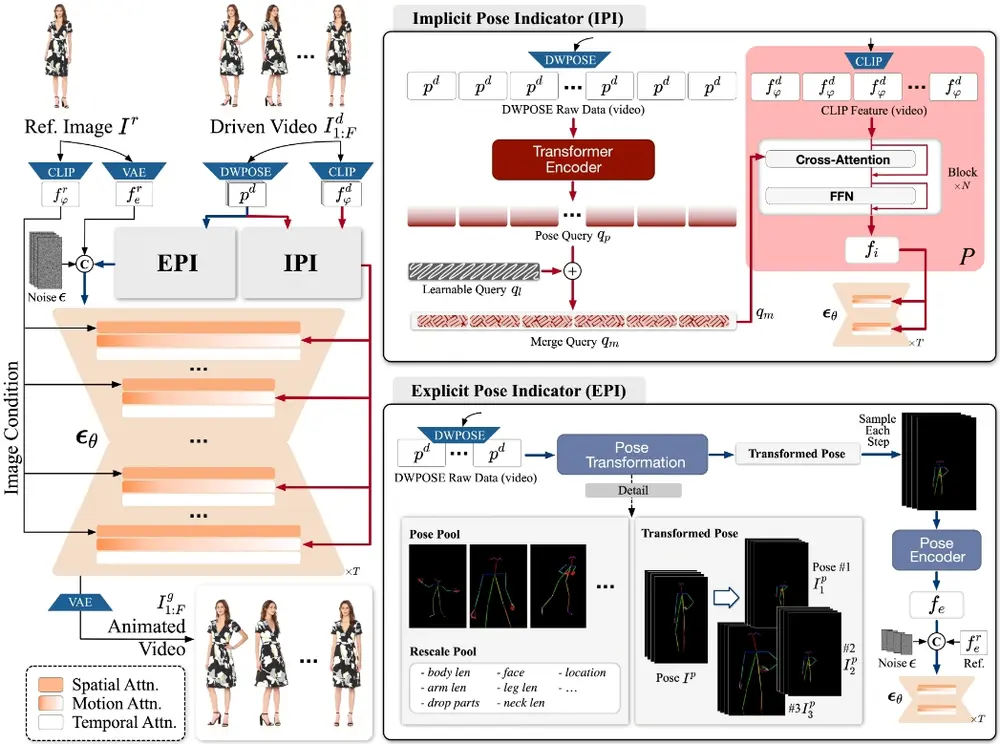

姿态指示器:引入了姿态指示器,通过隐式和显式方式从驱动视频中捕捉全面的运动模式。

- 隐式方式:利用驱动视频的 CLIP 视觉特征提取其运动要点,如整体运动模式和运动之间的时间关系。

- 显式方式:通过提前模拟推理过程中可能出现的输入来增强 LDM 的泛化能力。

新的基准测试:

A2Bench:研究团队引入了一个新的拟人化动画基准 A2Bench,包含 500 个不同的卡通角色和相应的舞蹈视频,用于评估 Animate-X 在通用和广泛适用的动画图像上的性能。

工作原理

运动模式捕捉:

- CLIP 视觉特征:使用 CLIP 模型提取驱动视频的视觉特征,捕捉整体运动模式和时间关系。

- 姿态指示器:结合 CLIP 特征和目标姿态序列,生成姿态指示器,指导 LDM 生成更自然的运动。

潜在扩散模型(LDM):

- 训练阶段:使用大量的人体姿态数据训练 LDM,使其学会生成高质量的动画帧。

- 推理阶段:在生成动画时,LDM 使用姿态指示器作为输入,生成符合目标姿态序列的动画帧。

泛化能力增强:

- 输入模拟:通过提前模拟推理过程中可能出现的输入,增强 LDM 的泛化能力,使其能够处理各种角色类型的动画生成。

实验结果

广泛的实验证明了 Animate-X 相比最先进方法的优越性和有效性。在 A2Bench 基准测试中,Animate-X 生成的动画在质量和自然度方面表现优异,能够处理各种复杂和多样化的角色。

应用场景

- 游戏开发:游戏开发者可以使用 Animate-X 自动生成游戏角色的动画,提高开发效率和动画质量。

- 影视制作:影视制作团队可以利用 Animate-X 为电影和动画片中的角色生成高质量的动画,节省时间和成本。

- 虚拟现实和增强现实:在 VR 和 AR 应用中,Animate-X 可以用于实时生成角色动画,提供更加沉浸式的体验。

Animate-X 通过引入姿态指示器和潜在扩散模型,显著提升了角色图像动画的通用性和自然度。其在 A2Bench 基准测试中的优秀表现证明了其在处理各种角色类型动画生成任务中的有效性和优越性。希望 Animate-X 能够成为计算机视觉和动画生成领域的有力工具,推动相关应用的发展。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...