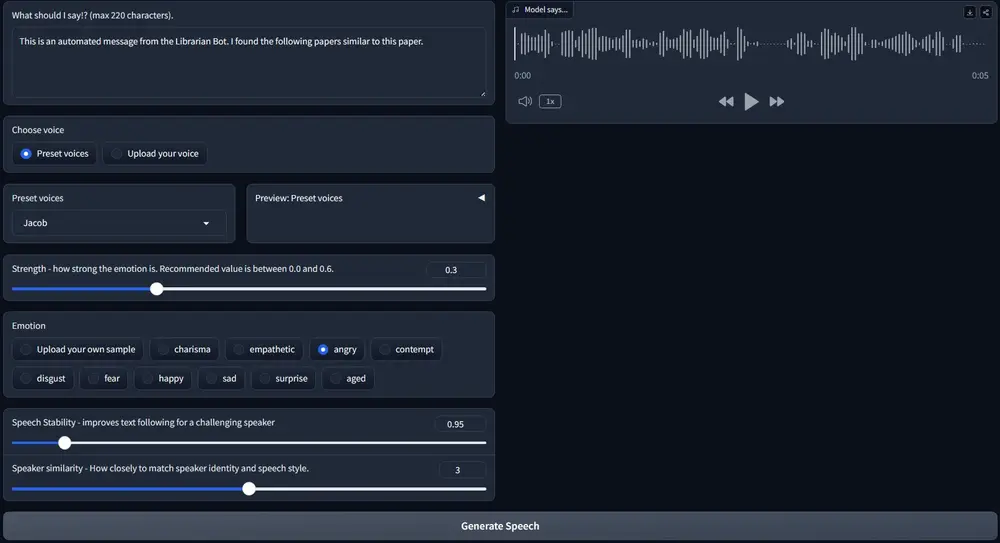

哥伦比亚大学的研究人员推出一个允许在语音合成中对任意情感进行细粒度控制的框架EmoKnob,它用于提升语音克隆技术,只需少量示 范样本,允许用户在语音合成中精细控制情感及其强度。简单来说,EmoKnob让你能够给机器生成的语音添加你想要的任何情感色彩,比如快乐、悲伤、愤怒等,并且还能调整情感的强度。

- 项目主页:https://emoknob.cs.columbia.edu

- GitHub:https://github.com/tonychenxyz/emoknob

- Demo:https://huggingface.co/spaces/tonychenxyz/emo-knob

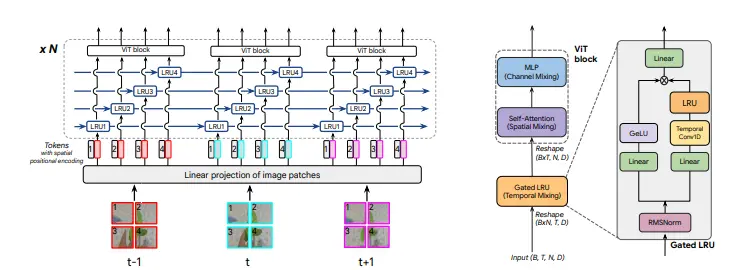

EmoKnob利用了基础声音克隆模型的最新进展所实现的富有表现力的说话人表示空间。基于情感控制框架EmoKnob的少量样本能力,研究人体提出了两种方法来对由开放式文本描述的情感进行情感控 制,从而实现了一种直观的界面,用于控制一系列微妙的情感。为了促进更系统的情感语音合成领域,研究人员引入了一套评估指标,旨在严格评估情感控制框架的忠实度和可识别性。

例如,你想为一个故事生成一段有声版本,故事中的某个角色在说“生存还是毁灭,这是一个值得考虑的问题”时,表现出了悲伤和沉思的情感。使用EmoKnob,你可以选择悲伤和沉思的情感,调整强度,然后生成带有这种情感色彩的语音,使得听众能够更加真切地感受到角色的情感状态。

主要功能

EmoKnob的主要功能包括:

- 精细控制情感:用户可以选择想要表达的情感,并调整其强度。

- 少量样本学习:通过少量的示范样本,EmoKnob就能学会如何在语音中嵌入特定的情感。

- 开放性文本情感控制:用户可以使用自然语言描述情感,EmoKnob能够理解这些描述并生成相应情感的语音。

主要特点

- 高自然度:生成的语音听起来自然,贴近真人的表达。

- 情感强度可调:用户可以通过一个类似旋钮的机制来调整情感的强度。

- 少量样本即可学习:不需要大量的样本数据,EmoKnob就能学习到新的情感表达。

工作原理

EmoKnob的工作原理基于以下几个步骤:

- 训练模型:使用预训练的基础语音克隆模型来提取说话人的嵌入表示。

- 情感表示:通过分析情感和中性语音样本的差别,提取情感方向向量。

- 情感控制:在生成语音时,根据指定的情感方向和强度调整说话人的嵌入表示,从而在合成的语音中嵌入特定的情感。

- 文本到语音的转换:利用文本到语音的解码器生成最终的语音输出。

具体应用场景

EmoKnob可以应用于多种场景,例如:

- 客户服务:自动客服系统可以使用EmoKnob生成听起来更自然、更有同情心的语音,提升用户体验。

- 有声读物:为电子书或有声读物生成带有情感的朗读语音,使听众更容易沉浸在故事中。

- 视频配音:为视频自动添加情感配音,使内容更加引人入胜。

- 语音助手:让语音助手的回应听起来更富有情感,更加人性化。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...