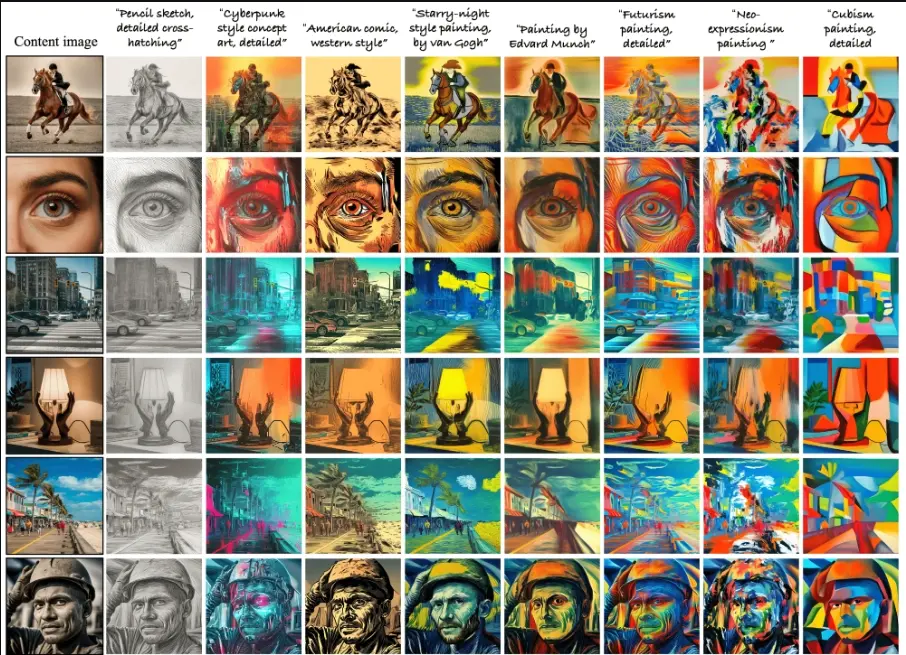

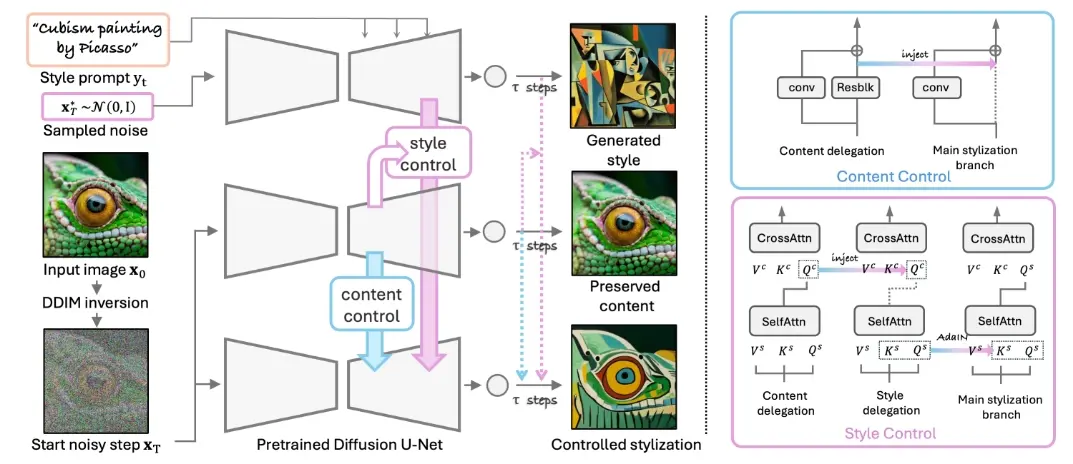

香港理工大学的研究人员推出一种无需训练即可实现美学控制的文本驱动风格化方法Artist。简而言之,Artist能够根据文本描述,将一张静态图片转换成具有特定艺术风格的图像,同时保持图片内容的完整性和细节。Artist的关键洞察是将内容与风格的去噪分解为独立的扩散过程,同时在这两者之间共享信息。研究团队提出了一种简单却有效的控制方法,该方法抑制了与风格无关的内容生成,从而产生了和谐的风格化结果。

主要功能:

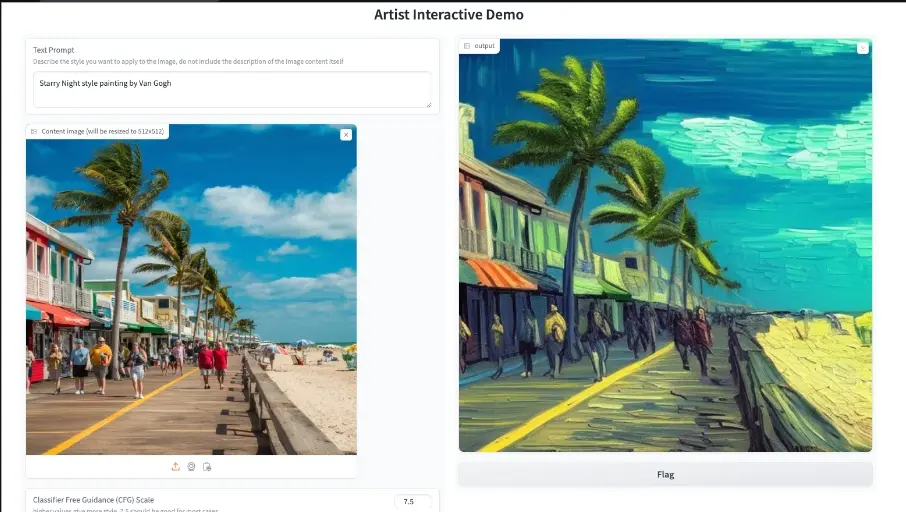

- 文本驱动的风格化:用户可以输入文本描述,如“梵高的星夜风格画作”,Artist将据此生成具有相应艺术风格的作品。

- 美学控制:Artist能够根据文本提示,精细控制生成图像的风格强度和内容抽象度。

主要特点:

- 无需训练:Artist是一种训练免费的方法,可以直接使用预训练的扩散模型进行风格化。

- 内容与风格分离:通过将内容和风格的去噪过程分离,Artist能够更灵活地控制风格化结果。

- 高度控制性:Artist提供了简单而有效的方法来控制内容和风格的生成,从而实现和谐的风格化效果。

工作原理:

Artist的核心思想是将内容和风格的去噪过程分离,并在它们之间共享信息。具体来说:

- 使用辅助的扩散分支来分别控制内容保留和风格生成。

- 在去噪过程中,通过特征级别的软约束来实现对内容和风格生成的精细控制。

- 利用视觉-语言模型(VLMs)作为美学级度量,评估文本驱动的风格化结果。

具体应用场景:

- 艺术创作:艺术家和设计师可以使用Artist根据文本描述快速生成具有特定风格的艺术作品。

- 个性化内容生成:用户可以根据自己的喜好,输入描述来创建个性化的图像和艺术作品。

- 图像编辑:在图像编辑和后期制作中,Artist可以根据文本提示对图片进行风格化处理,提高工作效率。

总的来说,Artist是一个强大的文本到图像的风格化工具,它通过创新的方法解决了现有技术在风格化任务中的一些限制,如内容修改和风格控制的难题,为用户提供了一种新的艺术创作和图像编辑的可能性。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...