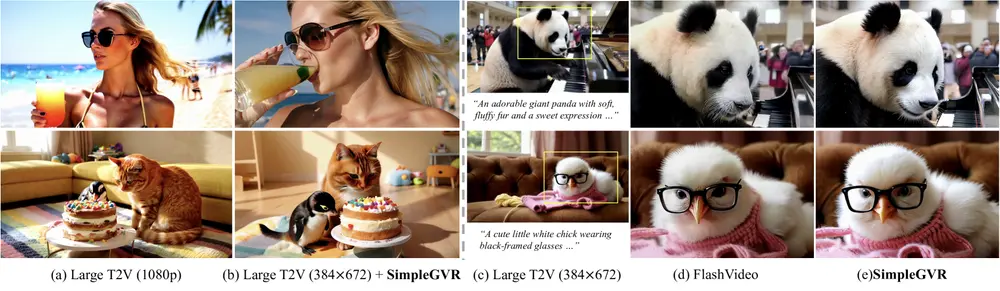

在 AI Agent 的开发中,我们一直面临着一个两难选择:

用最强的模型(如 Opus),智能够高但贵得让人肉疼;用便宜的模型(如 Sonnet 或 Haiku),成本低但遇到复杂逻辑容易“犯傻”。

以前,常见的解决方案是“大模型当指挥官,小模型当工人”:让 Opus 拆解任务,分发给 Sonnet 去执行。但这依然昂贵,因为指挥官本身就很贵,且上下文管理复杂。

- 官方介绍:https://claude.com/blog/the-advisor-strategy

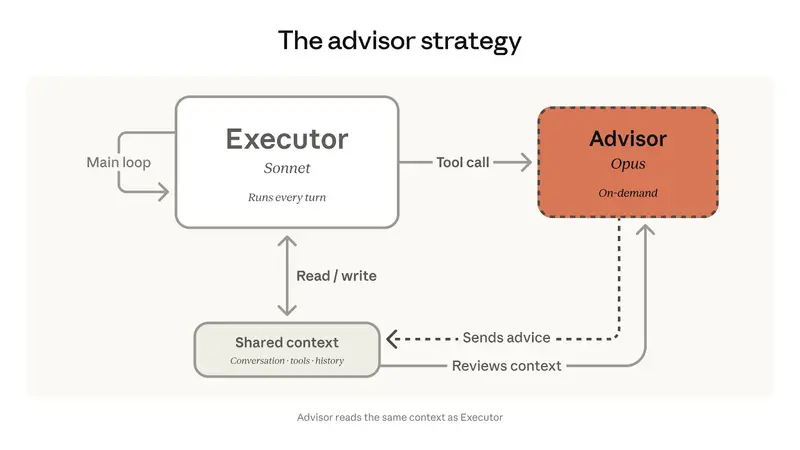

现在,Anthropic 提出了一种颠覆性的新思路:“顾问策略”(Advisor Strategy)。

核心逻辑:小模型主导,大模型点睛

这次的角色完全反过来了:

- 执行者(Worker):由 Sonnet 或 Haiku 担任。它们全程负责跑任务、调工具、处理结果。因为它们便宜,所以可以大胆地试错和迭代。

- 顾问(Advisor):由 Opus 担任。它不直接干活,也不接触用户。只有当执行者遇到搞不定的决策、陷入死胡同或需要高阶推理时,才会向 Opus “请教”。Opus 给出一个计划或修正建议,然后退居幕后,让执行者继续干。

这就像是一个经验丰富的初级工程师(Sonnet)在处理日常代码,遇到真正棘手的架构难题时,才去请教首席架构师(Opus)。首席架构师只给方向,不写代码。

效果惊人:智能提升,成本下降

Anthropic 的测试数据证明了这一策略的有效性:

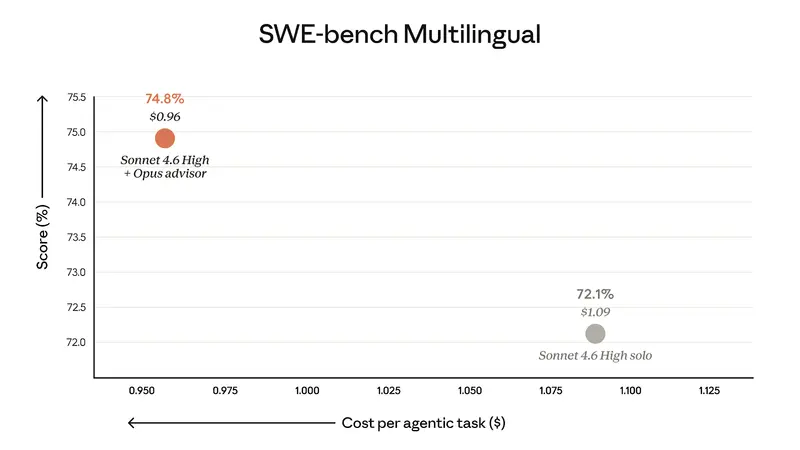

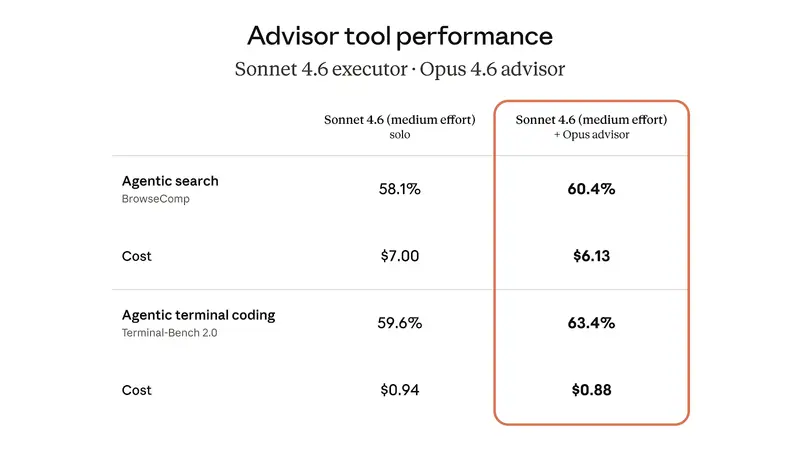

- Sonnet + Opus 顾问:

- 在 SWE-bench Multilingual(代码基准测试)上,得分比单独使用 Sonnet 高出 2.7%。

- 每个任务的成本反而降低了 11.9%。

- 结论:你得到了比 Sonnet 更聪明的结果,却花了更少的钱。

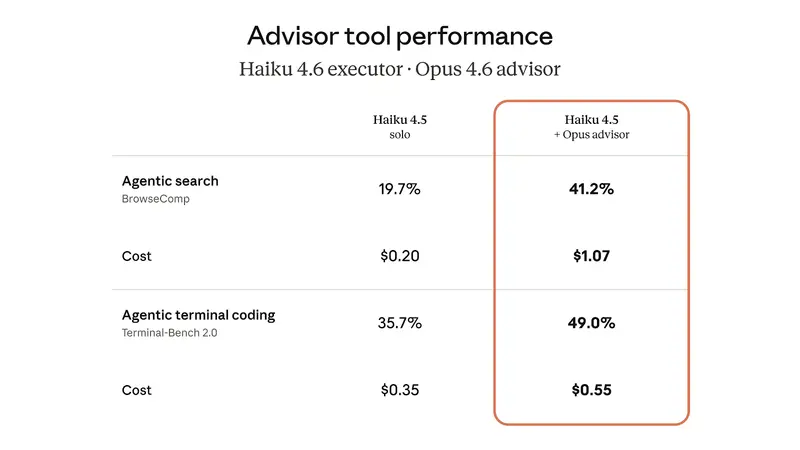

- Haiku + Opus 顾问:

- 在 BrowseComp(浏览理解基准测试)上,得分从 19.7% 飙升至 41.2%,翻了一倍多。

- 虽然分数仍低于单独使用 Sonnet,但成本仅为 Sonnet 的 15%。

- 结论:对于海量、对智能要求中等但需要一定推理能力的任务,这是极致的性价比之选。

如何使用?只需一行代码

Anthropic 将这一策略封装为一个原生工具 advisor,无需开发者自己构建复杂的路由逻辑。

在 API 请求中,你只需声明执行者模型,并在 tools 列表中加入 advisor_20260301:

response = client.messages.create(

model="claude-sonnet-4-6", # 执行者:便宜且快

tools=[

{

"type": "advisor_20260301",

"name": "advisor",

"model": "claude-opus-4-6", # 顾问:聪明但贵

"max_uses": 3, # 限制咨询次数,控制成本

},

# ... 其他工具如搜索、代码执行等

],

messages=[...]

)

关键特性:

- 自动路由:执行者模型自己决定何时调用顾问。

- 单次请求:整个交互(执行-咨询-继续执行)在一个 API 调用内完成,无需管理多次往返的上下文。

- 透明计费:账单中会分别列出执行者和顾问的 Token 消耗,方便监控。由于顾问只生成简短的计划(通常几百个 Token),总成本远低于全程运行 Opus。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...