Ollama在0.9版本更新中新增了一项重要功能:支持用户启用或禁用模型的“思考”行为。这项功能为开发者和终端用户提供了更高的灵活性,可以根据不同应用场景选择是否展示模型的推理过程。

什么是“思考功能”?

当 启用思考功能 时,模型会在输出最终答案前,先展示其内部的推理过程;而当 禁用思考功能 时,模型将直接输出结果,跳过中间的思考步骤。

这对于需要高效响应的场景(如自动化脚本、快速问答)非常实用;而对于教学、演示、调试等用途,则可以通过开启思考功能,帮助用户更好地理解模型是如何得出结论的。

当前支持该功能的模型

目前,以下模型已支持“思考功能”:

- DeepSeek R1

- Qwen 3

更多模型正在逐步加入“可思考模型列表”,未来将陆续开放支持。

如何在不同场景中使用思考功能?

✅ 命令行界面(CLI)

在命令行中,默认是 启用思考功能 的,这意味着你可以看到模型完整的推理过程。

启用思考:

--think禁用思考:

--think=false你也可以在交互式会话中动态切换:

在对话中启用:

/set think在对话中禁用:

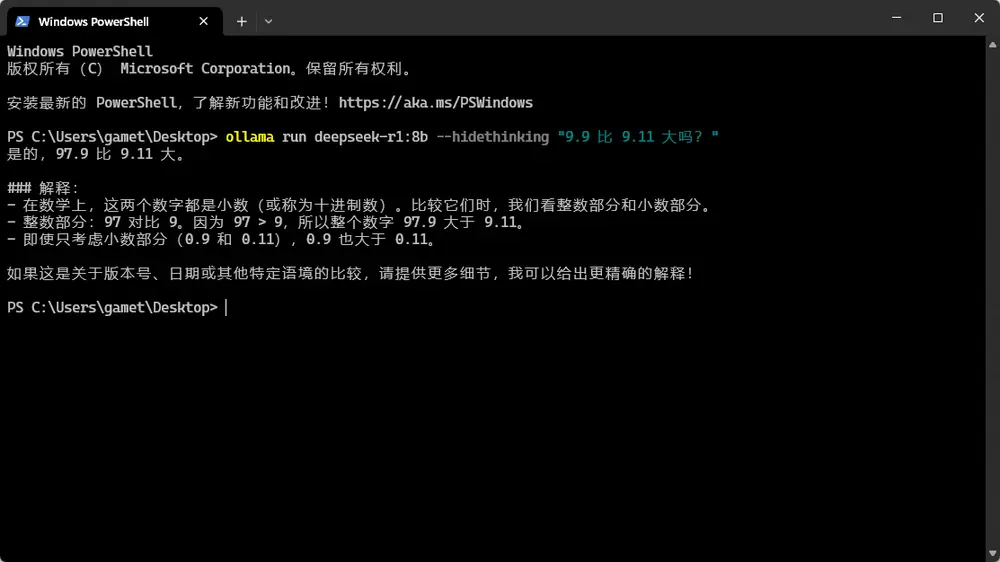

/set nothink✅ 脚本编写

如果你希望使用具备思考能力的模型,但又不希望输出中包含推理过程,可以使用 --hidethinking 参数来隐藏思考内容,只显示最终答案。

示例:

ollama run deepseek-r1:8b --hidethinking "9.9 比 9.11 大吗?"

✅ API 使用(生成与聊天接口)

Ollama 的 /api/generate 和 /api/chat 接口也已更新,支持通过参数控制是否启用模型的思考功能。

新增参数:

{

"think": true | false

}- 设置为

true:返回模型的思考过程 + 最终答案; - 设置为

false:仅返回最终答案,不进行推理展示。

示例:使用聊天 API 启用思考功能

curl http://localhost:11434/api/chat -d '{

"model": "deepseek-r1",

"messages": [

{

"role": "user",

"content": "how many r in the word strawberry?"

}

],

"think": true,

"stream": false

}'应用场景举例

| 场景 | 是否启用思考功能 | 说明 |

|---|---|---|

| 教学演示 | ✅ 是 | 展示模型如何一步步分析问题,增强学习效果 |

| 自动化脚本 | ❌ 否 | 提升响应速度,避免冗余输出 |

| 游戏 NPC 对话 | ✅ 是 | 可用于构建“NPC 思考气泡”动画,提升沉浸感 |

| 快速问答系统 | ❌ 否 | 直接给出答案,提高效率 |

开始使用

要体验这一新功能,请确保你已安装 最新版本的 Ollama。你可以在 官网 下载并更新至当前支持思考功能的版本。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...