你是否拥有一张消费级显卡(如 RTX 4070/5070 12GB),却眼馋那些需要 24GB 甚至 48GB 显存才能运行的超大语言模型(如 GLM-4-Flash, Llama-3-70B)?

传统的解决方案要么是让速度暴跌的 CPU 卸载,要么是损失精度的低比特量化,要么就是天价的专业卡。GreenBoost 给出了第四种选择:透明地利用系统 DDR4 内存和 NVMe 存储,将你的 GPU 显存扩展数倍,且无需修改任何推理软件。

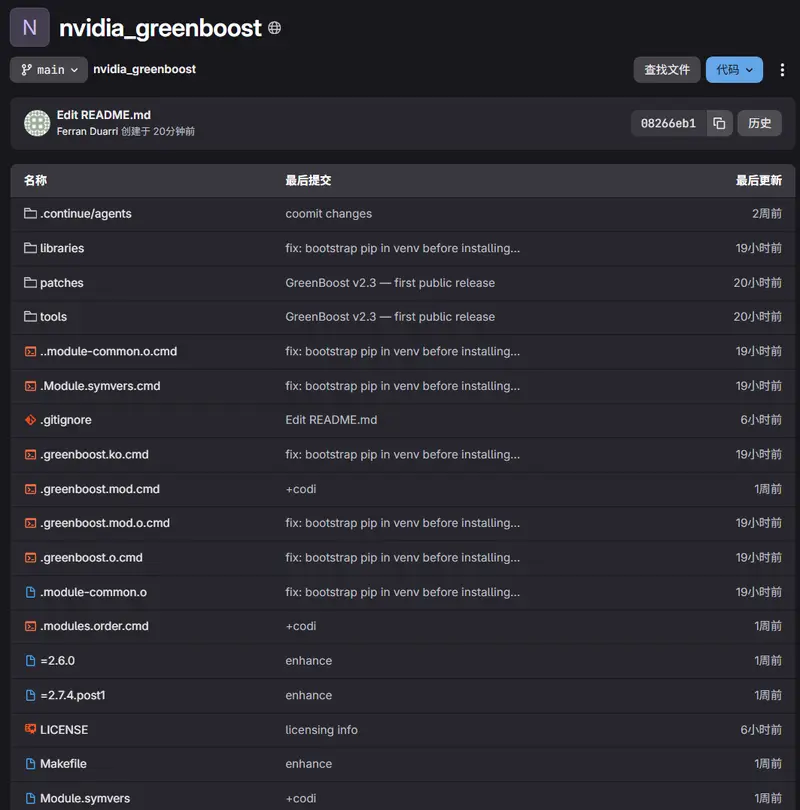

- 地址:https://gitlab.com/IsolatedOctopi/nvidia_greenboost

🚀 核心突破:三层显存架构

GreenBoost 不是一个虚拟 GPU,而是一个智能的内存层级管理系统。它在 NVIDIA 官方驱动之上,构建了一个透明的 CUDA 分配层,将内存分为三级:

| 层级 | 设备 | 容量示例 | 带宽 | 用途 |

|---|---|---|---|---|

| T1 (热) | GPU 显存 (VRAM) | 12 GB | ~336 GB/s | 活跃计算层、高频权重 |

| T2 (温) | 系统内存 (DDR4) | 51 GB | ~32 GB/s (PCIe 4.0) | KV 缓存、冷权重、中间激活值 |

| T3 (冷) | NVMe 存储 | 64 GB+ | ~1.8 GB/s | 安全溢出区 (Swap),极少命中 |

神奇之处:对于运行中的程序(如 Ollama, vLLM),它看到的只是一个巨大的、连续的显存空间。它不知道数据其实藏在系统内存里,直到 GPU 通过 PCIe 总线直接读取(DMA-BUF),完全绕过 CPU 拷贝。

⚙️ 工作原理:内核模块 + CUDA 垫片

GreenBoost 由两个精密协作的组件构成:

- 内核模块 (

greenboost.ko):- 锁定并分配大块 DDR4 物理页(2MB 复合页优化)。

- 通过 DMA-BUF 机制将这些内存导出为文件描述符。

- GPU 通过

cudaImportExternalMemory直接导入这些内存,视其为设备内存。 - 提供

/sys/class/greenboost/...接口实时监控各层使用情况。

- CUDA 垫片 (

libgreenboost_cuda.so):- 通过

LD_PRELOAD注入,拦截cudaMalloc,cudaFree等调用。 - 智能路由:<256MB 的小分配走原生显存;>256MB 的大分配(如模型权重、KV 缓存)自动重定向到 T2/T3 层。

- 欺骗检测:特别针对 Ollama 等通过

dlsym动态查询显存大小的软件,垫片会拦截dlsym并返回“扩容后”的显存总量,防止软件误判而强制使用 CPU 卸载。

- 通过

📈 性能实测:12GB 显存跑 32GB 模型

在 RTX 5070 (12GB) + i9-14900KF + 64GB DDR4 平台上,运行 GLM-4-7B-Flash (Q8_0, 31.8GB) 的表现:

| 配置方案 | 解码速度 (tok/s) | 首 Token 延迟 | 评价 |

|---|---|---|---|

| Ollama + GreenBoost (基线) | 2–5 | 5–15s | 能跑,但受限于 PCIe 带宽 |

| + kvpress (KV 压缩 50%) | 4–8 | 3–10s | 显著减少 T2 层压力 |

| ExLlamaV3 + GreenBoost 缓存 | 8–20 | 2–8s | 专为 GreenBoost 优化的引擎 |

| ModelOpt FP8 量化 (16GB) | 10–25 | 1–5s | 推荐策略:模型进显存,KV 进内存 |

| EXL3 2bpw (全显存) | 25–60 | <1s | 终极形态:模型完全 fit 进 T1 |

💡 最佳实践:

单纯依赖 T2 (DDR4) 会有 PCIe 带宽瓶颈。最强组合拳是:

- 使用 FP8 或 EXL3 (2-4bit) 量化,将模型权重压缩至完全放入 T1 (显存)。

- 利用 GreenBoost 的 T2 层专门存放巨大的 KV 缓存,支持超长上下文(如 128K+)。

- 这样既享受了显存的高速计算,又拥有了内存的海量容量。

🛠️ 安装与使用

GreenBoost 提供了极其友好的一键脚本,自动检测硬件并调优系统。

# 1. 克隆项目

git clone https://gitlab.com/IsolatedOctopi/nvidia_greenboost.git

cd nvidia_greenboost

# 2. 全自动安装 (构建模块、设置 Swap、调优 Sysctl、配置 Ollama)

sudo ./greenboost_setup.sh full-install

# 3. 重启系统

sudo reboot

# 4. 诊断验证

sudo ./greenboost_setup.sh diagnose

# 5. 直接使用 (对应用完全透明)

ollama run glm4:latest # 自动利用扩展显存!

🧰 生态整合

项目不仅提供底层驱动,还捆绑了针对扩展内存优化的上层工具:

- ExLlamaV3:原生支持 GreenBoost,零拷贝加载 KV 缓存。

- kvpress:运行时动态压缩 KV 缓存,进一步节省内存。

- NVIDIA ModelOpt:一键 FP8/INT4 量化,无需重新训练。

- Unsloth + LoRA:支持在有限显存下进行高效微调。

⚠️ 注意事项

- 系统要求:目前主要在 Ubuntu 26.04 (Kernel 6.19+) 上测试通过。需要 NVIDIA 驱动 580.x+。

- 硬件兼容:主要测试于 Blackwell (RTX 50 系列),Ada (40 系) 和 Ampere (30 系) 理论上兼容。

- 非官方驱动:GreenBoost 不替换 官方

nvidia.ko驱动,而是作为独立模块共存,安全性更高。 - NVMe 延迟:T3 层 (NVMe) 仅作为应急 Swap,频繁访问会导致性能骤降。理想情况是 T1+T2 足够容纳工作集。

结语

GreenBoost 是 Linux 桌面 AI 玩家的一大福音。它打破了“显存即正义”的硬件军备竞赛,让普通消费者也能用亲民的价格体验超大参数模型的魅力。

如果你有一张 12GB 或 16GB 的显卡,却渴望运行 70B 级别的模型,或者需要处理百万字级的长文档,GreenBoost 绝对值得你尝试。它让“小马拉大车”变成了“小马装涡轮,跑得比大车还快”。

相关文章