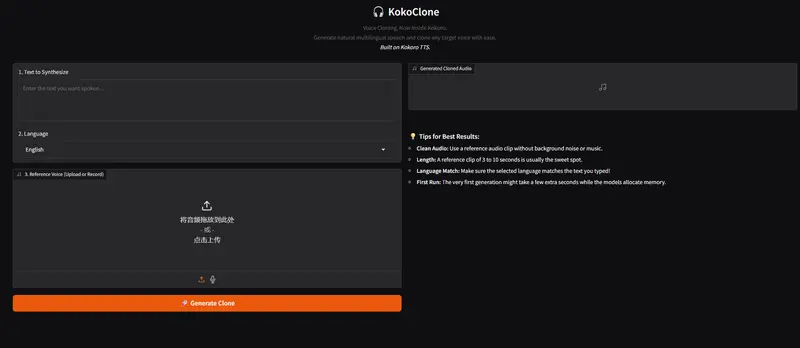

KokoClone 是一款构建在 Kokoro-ONNX(目前最快的开源神经语音合成引擎之一)之上的高性能语音克隆系统。它打破了传统 TTS(文本转语音)和语音转换的延迟瓶颈,实现了快速、实时兼容的多语言声音复刻。

- GitHub:https://github.com/Ashish-Patnaik/kokoclone

- 模型:https://huggingface.co/PatnaikAshish/kokoclone

- Demo:https://huggingface.co/spaces/PatnaikAshish/kokoclone

无论是需要即时生成多语言配音,还是想要将现有录音“换脸”成特定说话人的声音,KokoClone 都能通过简单的流程瞬间完成。

核心能力:两大克隆模式

1. 文本 → 克隆 (Text-to-Voice Cloning)

- 流程:输入多语言文本 + 提供一段 3-10 秒的参考音频。

- 效果:系统立即提取参考音频的声纹特征,并用该声音朗读输入的文本。

- 优势:零样本(Zero-shot)学习,无需训练,即刻生效。

2. 音频 → 克隆 (Voice-to-Voice Conversion)

- 流程:上传任意现有的语音录音 + 提供一段参考音频。

- 效果:将原录音的内容完全保留,但音色替换为参考说话人的声音。

- 技术亮点:

- 跳过 TTS:不经过“语音转文字再转语音”的过程,直接通过 Kanade 语音转换模型 处理,保留了原说话人的语气、情感和节奏。

- 无限长度支持:内置自动显存感知分块(VRAM-aware chunking),可处理任意时长的录音,无需手动切割。

多语言原生支持

KokoClone 支持生成以下 8 种语言的原生口音语音,而非生硬的翻译腔:

- 🇺🇸 英语 (en)

- 🇮🇳 印地语 (hi)

- 🇫🇷 法语 (fr)

- 🇯🇵 日语 (ja)

- 🇨🇳 中文 (zh)

- 🇮🇹 意大利语 (it)

- 🇵🇹 葡萄牙语 (pt)

- 🇪🇸 西班牙语 (es)

为什么选择 Kokoro 引擎?

KokoClone 的核心动力来自 Kokoro-ONNX,专为极致效率设计:

- 极速推理:相比传统笨重的 TTS 模型,Kokoro 轻量且响应迅速,适合实时交互。

- 自然韵律:生成的语音富有表现力,语调自然,告别机器感。

- 硬件友好:

- CPU 实时运行:在普通笔记本电脑上即可流畅运行,无需昂贵显卡。

- GPU 加速:在图形工作站上可发挥更强性能,实现更低延迟。

- ONNX 优化:基于 ONNX 运行时流水线,确保跨平台兼容性和稳定性。

便捷特性

- 自动模型管理:首次运行时,系统会自动从 Hugging Face 下载所需的模型权重文件并配置到正确目录,用户无需手动干预。

- 实时友好架构:专为实时应用(如语音助手、直播变声、交互式演示)打造,低延迟输出。

应用场景

- 多语言视频配音:一键将视频内容克隆为多国语言版本,保持原作者音色。

- 有声书/广播剧制作:用少量样本克隆角色声音,快速生成大量对白。

- 游戏/虚拟人实时对话:利用 CPU 实时运行能力,为 NPC 或虚拟主播提供即时语音反馈。

- 隐私保护变声:在会议或直播中,实时将声音转换为他人音色,保护真实身份。

- 残障辅助:为失语症患者克隆其亲属或理想的声音进行沟通。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...