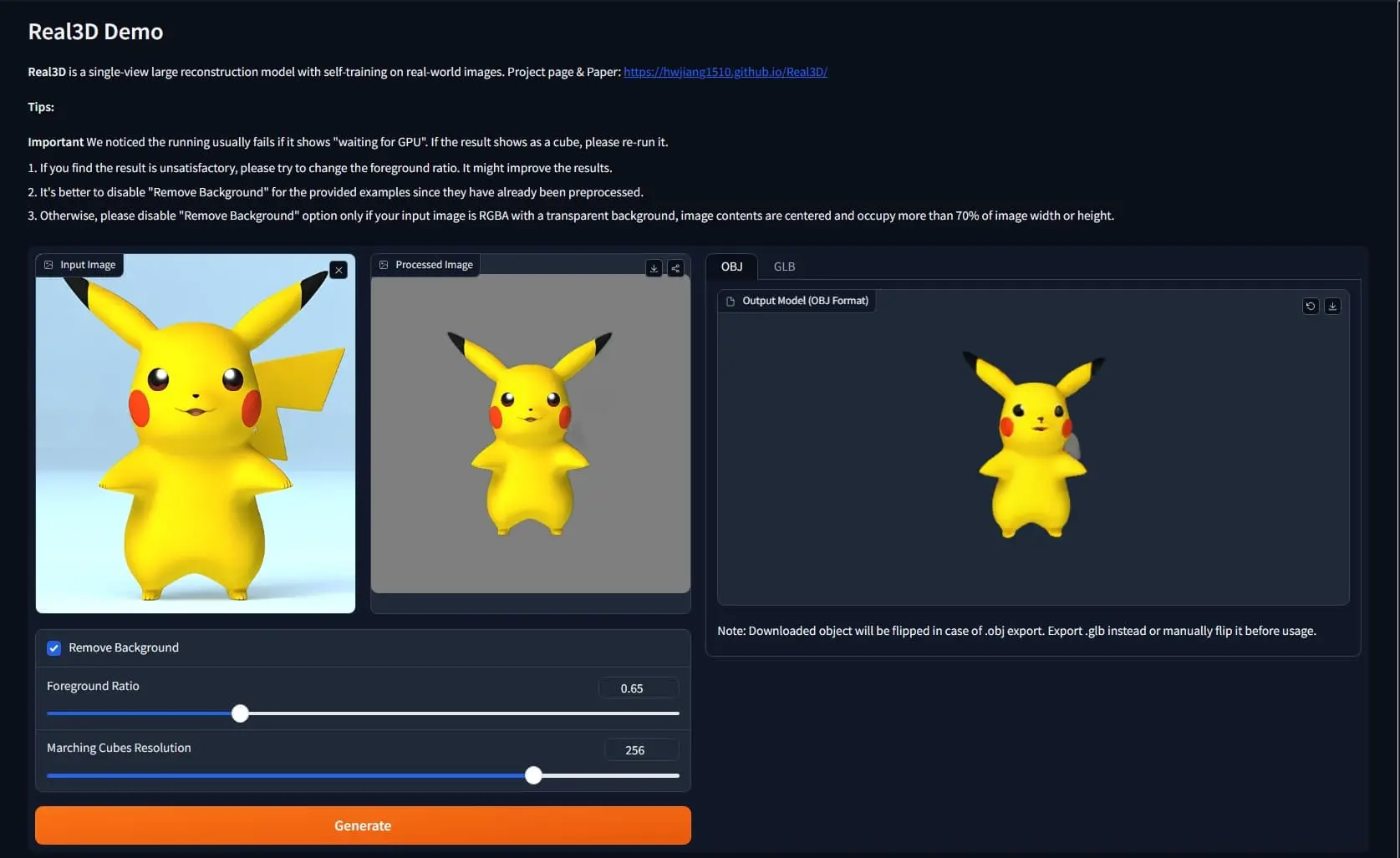

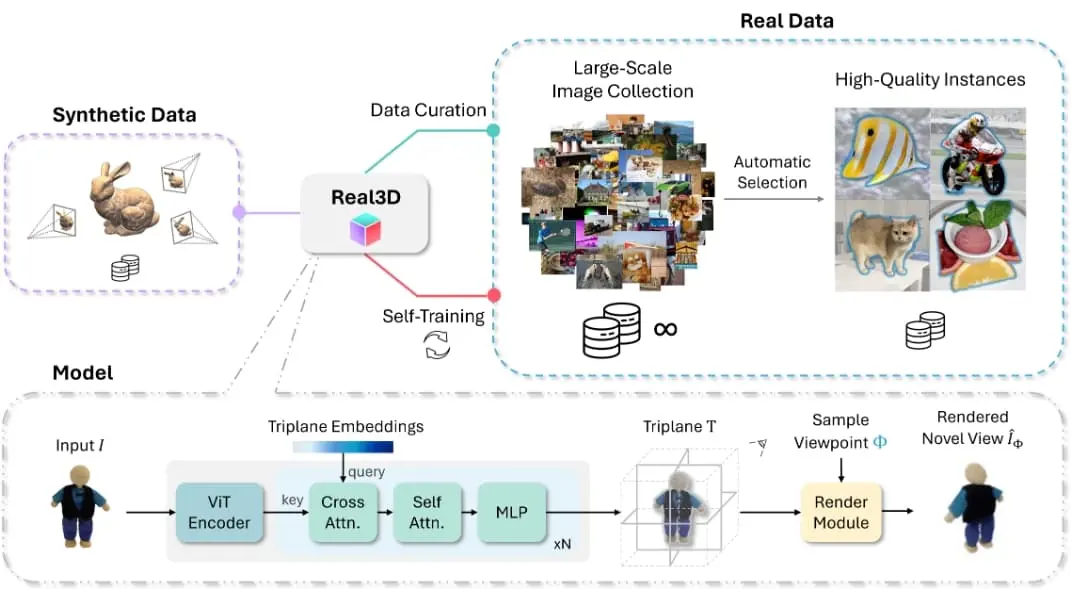

德克萨斯大学奥斯汀分校的研究人员推出Real3D,它是首个能够使用单视图真实世界图像进行训练的大型重建模型(Large Reconstruction Model,简称LRM)。Real3D通过自训练框架,利用现有的合成数据和多样化的单视图真实图像,提出了两种无监督损失函数,使得即使在没有真实3D数据或新视图的情况下,也能对LRM进行像素级和语义级的监督。Real3D的局限性,例如在自训练过程中使用了恒定的内在参数,以及对Real3D的更广泛影响,包括其在3D重建领域的潜在应用。

- 项目主页:https://hwjiang1510.github.io/Real3D

- GitHub:https://github.com/hwjiang1510/Real3D

- Demo:https://huggingface.co/spaces/hwjiang/Real3D

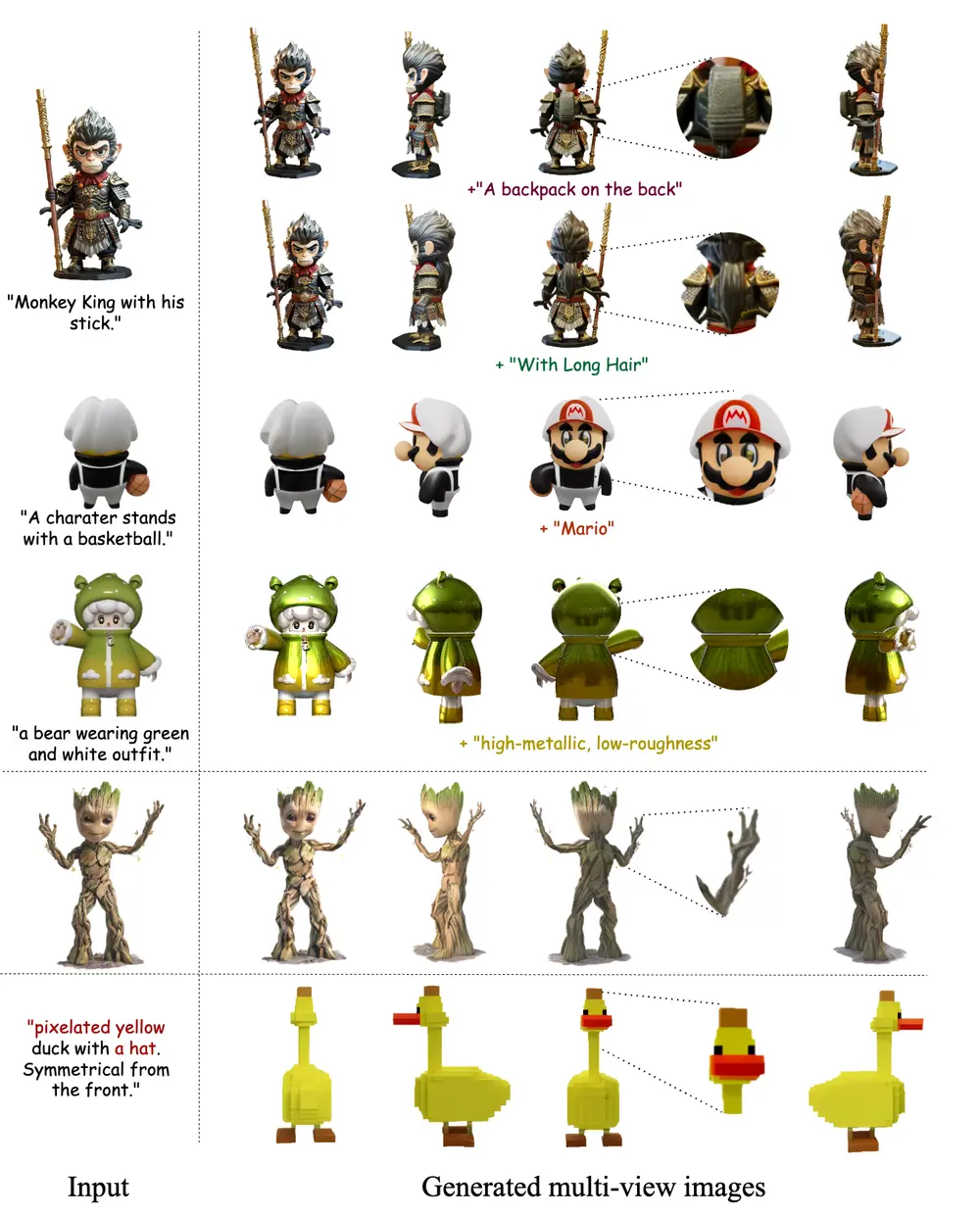

例如,你手头只有一张咖啡杯的图片,你想要重建这个咖啡杯的三维模型。传统的方法可能需要多角度的图片或者3D扫描数据。但Real3D系统能够仅凭这一张图片,通过自训练和无监督学习,生成咖啡杯的3D模型,并且可以从新的视角渲染出该咖啡杯的图像。

主要功能:

- 利用单视图真实世界图像进行3D重建。

- 通过自训练框架结合合成数据和真实图像数据进行训练。

主要特点:

- 无监督学习:Real3D不需要3D地面真实数据或多视图数据进行训练。

- 自训练框架:结合像素级循环一致性渲染损失和语义损失,提高模型性能。

- 数据筛选:开发了自动化数据筛选方法,选择高质量的实例进行训练。

工作原理:

- 初始化:在合成数据集上初始化LRM。

- 数据收集:从野外图像中收集真实世界的对象实例。

- 自训练:在合成数据和真实数据上执行自训练,使用无监督损失来提高模型性能。

- 数据筛选:自动筛选高质量的实例,如未被遮挡的实例,以提高训练质量。

具体应用场景:

- 增强现实/虚拟现实(AR/VR):为虚拟环境中的对象生成3D模型。

- 机器人视觉:帮助机器人更好地理解和操作三维空间中的对象。

- 人工智能生成内容(AIGC):自动生成3D内容,如游戏或电影中的3D资产。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...