Meta推出基于文本的视频编辑模型Emu Video Edit (EVE),它能够在没有监督视频编辑数据的情况下,实现先进的视频编辑功能。

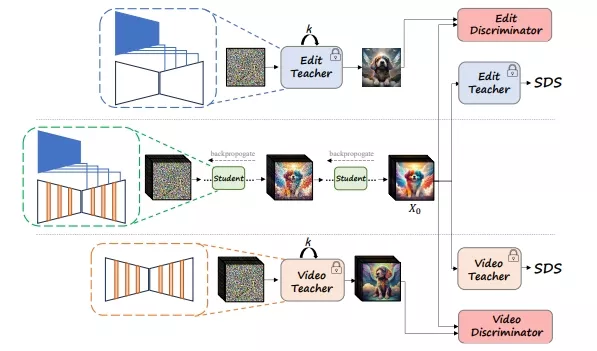

EVE模型通过结合图像编辑适配器和视频生成适配器,并使用一种新的无监督蒸馏过程(Factorized Diffusion Distillation,简称FDD)来对这些适配器进行对齐,从而实现视频编辑。

主要功能和特点:

- 无监督学习: EVE不需要任何监督视频编辑数据,这意味着它可以在没有大量标注数据的情况下学习视频编辑任务。

- 两阶段训练: 首先,分别训练图像编辑适配器和视频生成适配器;然后,通过FDD方法对这两个适配器进行对齐,以实现视频编辑。

- 高效率: EVE通过蒸馏(distillation)过程,将图像编辑和视频生成的知识整合到一个模型中,提高了训练效率。

- 多样化编辑能力: EVE不仅能够进行基本的视频编辑,如改变视频风格、添加或删除对象,还能处理更复杂的编辑任务,如改变视频中物体的纹理。

工作原理:

- 适配器训练: EVE首先在相同的文本到图像模型上分别训练图像编辑适配器和视频生成适配器。

- 适配器对齐: 使用FDD方法,将图像编辑适配器的精确编辑能力和视频生成适配器的时序一致性保障能力整合到一个学生模型中。

- 蒸馏过程: 在FDD过程中,学生模型尝试生成编辑后的视频,然后使用生成的视频为所有教师模型提供反馈,通过评分蒸馏采样(Score Distillation Sampling)和对抗性损失(adversarial losses)进行训练。

具体应用场景:

- 在线内容创作: EVE可以用于社交媒体内容创作者编辑和定制视频内容,以适应特定的叙事或风格需求。

- 视频制作: 电影和电视制作人员可以使用EVE进行初步的视频编辑,快速实现创意概念。

- 个性化视频服务: EVE可以为用户提供个性化的视频编辑服务,例如根据用户的文本描述定制视频片段。

EVE是一个强大的视频编辑工具,它利用无监督学习方法和适配器对齐技术,在没有大量标注数据的情况下,实现了先进的视频编辑能力。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...