南京大学软件新技术国家重点实验室和腾讯公司研究团队推出图像编辑框架StableDrag,它专注于通过点(handle points)来精确控制图像编辑。

StableDrag提供了一种稳定且精确的图像编辑方法,它通过点跟踪和运动监督的创新技术,使得用户能够更加自由地控制图像编辑过程。

想象一下,你有一张图片,你想要移动图片中的某个物体,比如把一只狮子的嘴巴从闭合状态变成张开状态。在StableDrag中,你可以指定一个手柄点(handle point),然后告诉系统你想要它移动到的目标位置。StableDrag会帮你实现这个变化,同时保持图像的其他部分不变。

主要功能和特点:

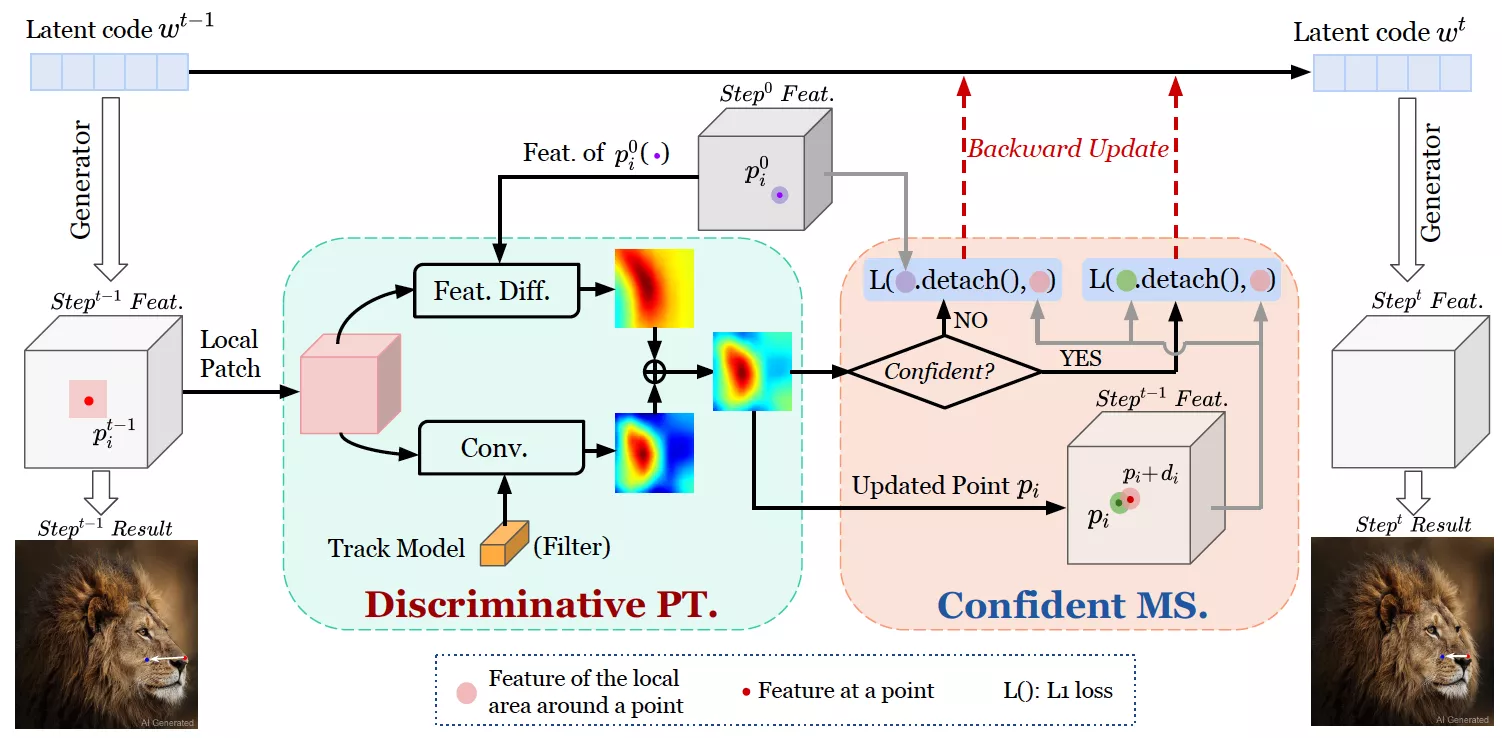

- 精确的点跟踪: StableDrag通过设计一种判别性的点跟踪方法,能够准确地定位用户指定的手柄点,即使在复杂的背景中也能区分出目标点。

- 自信的运动监督: 通过一种基于置信度的潜在增强策略,StableDrag确保在每一步编辑过程中都能保持高质量的潜在图像,从而提高编辑的稳定性和质量。

- 适用于多种生成模型: StableDrag不仅适用于基于生成对抗网络(GAN)的模型,还适用于基于扩散模型的图像编辑。

工作原理:

- 点跟踪: 在编辑过程开始时,StableDrag会学习一个点跟踪模型,这个模型可以帮助系统在后续的编辑步骤中准确地识别和跟踪用户指定的手柄点。

- 运动监督: 在每一步编辑中,StableDrag都会评估当前编辑过程的质量,并根据这个质量来决定是否需要使用初始模板来增强监督,以确保编辑内容的质量。

StableDrag在与其他图像编辑工具比较时,具有以下独特的优势:

- 精确的点级控制:StableDrag允许用户通过指定手柄点和目标点来精确控制图像中的特定部分,这在传统的图像编辑工具中往往难以实现,因为它们通常依赖于区域选择和刷子工具。

- 判别性点跟踪:StableDrag采用判别性学习的方法来跟踪手柄点,这使得它能够在复杂的背景中准确地识别和跟踪目标点,提高了编辑的准确性。

- 自信的运动监督:通过基于置信度的潜在增强策略,StableDrag能够在每一步编辑过程中保持高质量的潜在图像,这有助于在长距离操纵中保持稳定性。

- 适用于多种生成模型:StableDrag不仅适用于基于GAN的模型,还可以与扩散模型结合使用,这为图像编辑提供了更广泛的应用场景和更高的生成质量。

然而,StableDrag也有一些局限性:

- 计算成本:虽然StableDrag在点跟踪阶段的计算效率较高,但在运动监督阶段可能需要较多的计算资源,尤其是在处理高分辨率图像或复杂场景时。

- 模型依赖性:StableDrag的性能在很大程度上依赖于底层的生成模型(如GAN或扩散模型),这意味着如果底层模型的质量不高,编辑结果也可能受到影响。

- 用户输入要求:用户需要明确指定手柄点和目标点,这可能需要一定的图像编辑经验。对于没有经验的用户来说,这可能是一个学习曲线。

- 实时性能:在某些情况下,StableDrag可能需要多步迭代才能达到理想的编辑效果,这可能影响实时编辑的体验。

- 泛化能力:尽管StableDrag在多种场景下表现良好,但它在处理一些非常规或罕见的图像编辑任务时可能仍存在挑战,这需要进一步的研究和改进。

总的来说,StableDrag在精确控制和高质量图像编辑方面具有显著优势,但在计算成本、模型依赖性和用户输入要求方面也存在一定的局限性。随着技术的进步,这些局限性有望得到改善。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...