AI21 正式发布开源模型Jamba 1.6 系列,专为企业私有部署设计,兼具卓越性能和数据安全性。

核心优势

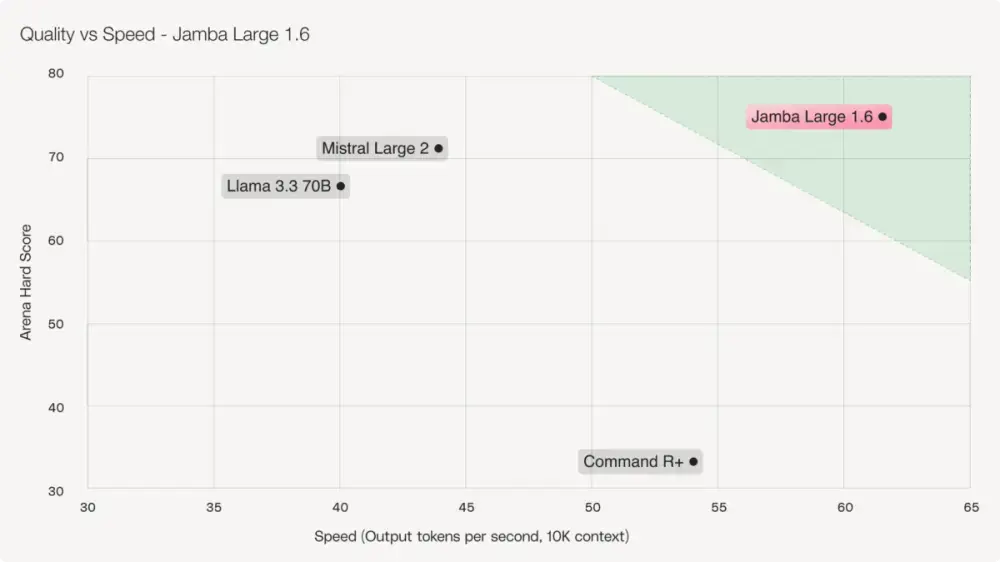

1. 领先的开源模型质量

Jamba Large 1.6 在质量上优于 Mistral Large 2、Llama 3.3 70B 和 Command R+,而 Jamba Mini 1.6 则优于 Ministral 8B、Llama 3.1 8B 和 Command R7B。Jamba 1.6 的性能与领先的闭源模型相媲美,同时支持完全本地或 VPC 内部署,确保敏感数据始终保留在企业内部。

2. 无与伦比的长上下文性能

Jamba 1.6 采用混合 SSM-Transformer 架构,支持 256K 的上下文窗口,使其在 RAG(检索增强生成)和长上下文问答任务中表现出色。这一特性让 Jamba 在处理海量数据时保持高效和准确,而不会出现性能下降。

3. 灵活的部署选项

除了通过 AI21 Studio 使用外,Jamba 1.6 还可在 Hugging Face 上下载,并支持私有化部署(本地或 VPC 内)。未来还将推出更多部署选项,满足不同企业的多样化需求。

实际应用场景

1. 研发团队

从事新药研发的团队需要 AI 检索和分析多年的研究数据,Jamba 1.6 的长上下文窗口能够确保在处理大量数据时保持准确性和高效性。

2. 法律团队

在审查并购文件时,法律团队需要 AI 提取关键条款、引用来源并总结数千页的内容。Jamba 1.6 能够高效处理长文档,确保输出基于事实且准确。

3. 金融分析师

构建风险模型的金融分析师需要 AI 推理数百份收益报告、法规和市场趋势,Jamba 1.6 能够在处理复杂数据时保持高精度,避免遗漏细节。

新功能:批量 API

此次发布还推出了新的批量 API,专为处理大量请求而设计。与逐个处理请求不同,批量处理允许一次性提交多个请求进行异步处理。在与 Fnac 的测试中,批量 API 将数万个请求的等待时间从数小时缩短至不到一小时,显著提高了效率。

开始使用 Jamba 1.6

企业可以通过以下方式开始使用 Jamba 1.6:

- 在 AI21 Studio 上与 Jamba 聊天,体验其强大功能。

- 直接从Hugging Face下载模型权重,进行本地部署和测试。

Jamba 1.6 不仅在性能上超越了其他开源模型,还通过私有化部署为企业提供了数据安全性和灵活性。它正在成为企业 AI 应用的新选择,助力企业在数据隐私和性能之间找到最佳平衡。

相关文章