来自字节跳动、中科院自动化研究所、中国科学院大学人工智能学院等机构的研究人员,提出了一个名为CreativeSynth的创新框架,它基于多模态扩散模型,能够协调多模态输入并在艺术图像生成领域实现多任务处理。

CreativeSynth通过整合多模态特征和定制化的注意力机制,实现了将现实世界中的语义内容导入艺术领域,并通过逆向和实时风格转移来精确操控图像风格。

这种方法不仅能够生成具有高保真度现实感的图像,而且有效地保持了真实艺术作品的基础概念、构图、风格元素和视觉象征,确保艺术作品的内在主题、情感和叙事得到保留,超越了仅仅将风格叠加到自然图像上的做法。

特点:

- 多模态输入协调:CreativeSynth能够处理文本和图像等多种模态的输入,并将这些输入融合到艺术图像的生成过程中。

- 艺术风格保持:在添加新的视觉元素时,框架确保艺术家的原始意图和艺术作品的原始风格不被丢失,同时保持整体的审美和谐。

- 语义融合:强调多模态输入与视觉艺术创作的协同作用,增强作品的个性化定制能力,反映用户的意图和叙事。

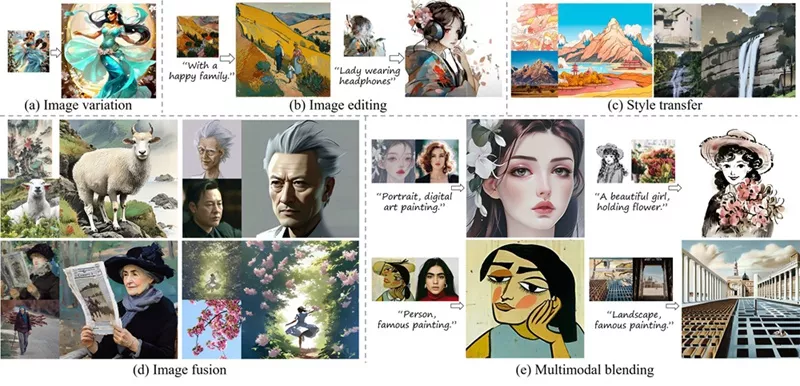

- 广泛的应用:CreativeSynth支持多种有趣的应用,包括图像变化、图像编辑、风格转移、图像融合和多模态混合。

实现方法:

- 条件引导:CreativeSynth首先通过编码来自图像和文本提示的语义线索,为条件引导打下基础。然后,框架专注于审美维护,通过专门的处理器调整语义图像风格,使其与艺术图像保持一致。

- 审美维护:引入风格对齐处理器,使用自适应实例归一化(AdaIN)技术调整语义图像,使其具有与审美图像相同的均值和方差,实现风格融合。

- 语义融合:采用解耦的交叉注意力机制,精确协调视觉和文本特征之间的相互作用,实现和谐的合成效果。

- 采样过程:基于图像逆向原理,使用去噪技术从初始噪声中反向采样图像,最终生成与给定语义提示和选择的审美风格相协调的定制艺术作品。

具体应用场景包括:

- 图像变化(Image Variation):用户可以通过文本提示来改变现有艺术图像的风格或内容,创造出新的视觉效果,同时保持原有艺术作品的基本特征。

- 图像编辑(Image Editing):CreativeSynth允许用户对艺术图像进行编辑,如添加或修改图像中的特定元素,例如改变人物的面部特征、服饰或背景,而不影响整体的艺术风格。

- 风格转移(Style Transfer):将一种艺术风格应用到另一幅图像上,例如将油画风格转移到照片上,或者将现代艺术风格与古典艺术风格相结合。

- 图像融合(Image Fusion):将多幅图像的风格和内容融合在一起,创造出全新的艺术作品,这在多图像风格一致性方面尤为重要。

- 多模态混合(Multimodal Blending):结合文本描述和图像,生成新的艺术图像,这可以用于创作具有特定主题或情感表达的艺术作品。

- 个性化艺术创作(Personalized Art Creation):用户可以根据自己的喜好和创意,通过文本提示来指导艺术图像的生成,实现个性化的艺术创作。

- 艺术教育和灵感激发(Art Education and Inspiration):CreativeSynth可以作为艺术教育工具,帮助学生和艺术家理解不同艺术风格和技术,激发创作灵感。

- 艺术作品的数字化再现(Digital Reproduction of Artworks):利用CreativeSynth,可以将传统艺术作品以数字形式再现,同时加入现代元素,为艺术作品赋予新的生命力。

- 艺术作品的数字化再现(Digital Reproduction of Artworks):利用CreativeSynth,可以将传统艺术作品以数字形式再现,同时加入现代元素,为艺术作品赋予新的生命力。

这些应用场景展示了CreativeSynth在艺术创作、编辑和风格转换方面的潜力,为艺术家、设计师和普通用户提供了强大的工具,以探索和实现他们的创意愿景。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...