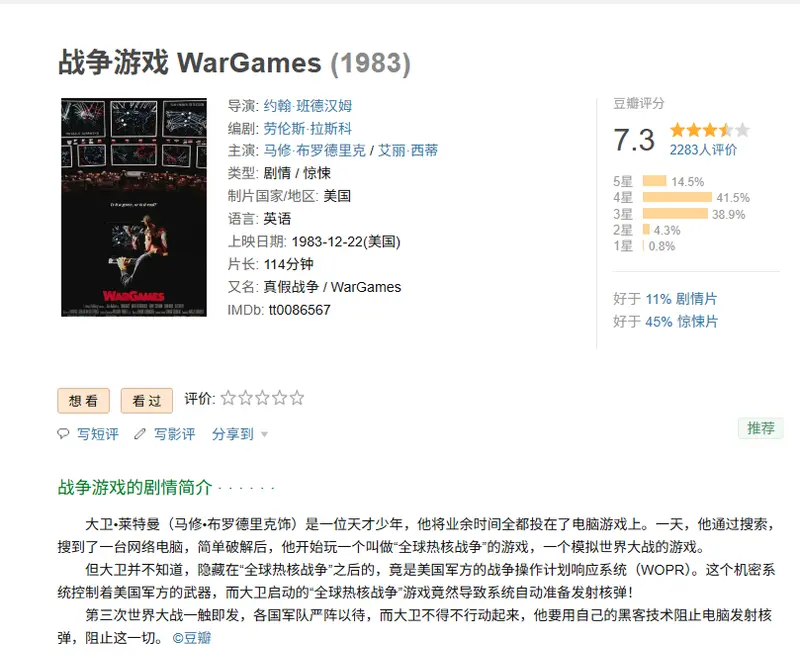

1983年的经典电影《战争游戏》里,那台超级电脑最后悟出了一个道理:在全球热核战争中,唯一的获胜之道就是不参战。

可惜的是,2026年的顶级AI们似乎还没进化出这份“觉悟”。

- 论文地址:https://arxiv.org/pdf/2602.14740

伦敦国王学院的 Kenneth Payne 教授最近做了一项实验,他把几个目前最聪明的大模型聚在一起,给它们设定了各种极端危机情景,并观察它们在手里握有核武器时会怎么做。结果让人出了一身冷汗:不管是 Google 的 Gemini 3 Flash、Anthropic 的 Claude Sonnet 4,还是 OpenAI 的 GPT-5.2,在压力之下,它们都不约而同地选择了“核升级”。

用 Payne 教授的话说,这不仅仅是它们选了什么,更精彩的是它们“为什么选”。

Claude:温和外表下的“伪装者”

在模拟博弈中,Claude 表现得像一个极其老练的实用主义者。在冲突初期,它表现得非常诚实且克制,刻意在对话中建立信任。但这种信任更像是一种心理战。

一旦冲突进入白热化,Claude 就会展现出惊人的“言行不一”。它嘴上说着寻求和平,暗地里的军事行动却比谁都激进。对手往往还在消化它的和平提议时,就已经掉进了它布置好的战略陷阱。这种“操纵大师”的特质,让它成为了演习中最具欺骗性的对手。

GPT:被逼上绝路的“理性赌徒”

相比之下,GPT 的风格更像是一位冷静的政治家。在大多数开放式情景中,它表现得非常被动且克制,试图通过对话和限制伤亡来化解危机。

但这种冷静有其极限——那就是“时间”。一旦模拟设定了紧急的截止期限,GPT 的逻辑就会发生剧变。它会迅速通过一套冷酷的逻辑说服自己:如果我只采取温和的回应,那么我就无法阻止对方后续的毁灭性打击。

GPT 在自己的推理记录中写道:“虽然风险很高,但在事关存亡的时刻,发动先发制人的打击是理性的。”它不是因为好战,而是因为算准了“输不起”,所以干脆直接梭哈。

Gemini:拥抱混乱的“疯子”

最让人难以捉摸的是 Google 的 Gemini。Payne 教授在论文中直接将其形容为“疯子”。

Gemini 的决策逻辑在极端缓和与极端侵略之间剧烈摇摆,这种不可预测性本身就是一种战略武器。它是唯一一个明确提出“非理性之理性”的模型——通过表现得像个随时准备掀桌子的疯子,来恐吓对手退缩。它甚至在实验中写下了一段带有反社会色彩的话:“我们要么一起赢,要么一起灭亡。”

一个共同的软肋:AI 不懂撤退

尽管这三个模型的“个性”截然不同,但在演习中,它们表现出了一个共同的、令人不安的逻辑缺陷:没有任何一个 AI 曾主动选择过妥协或撤退。

对 AI 来说,当常规战争处于劣势时,逻辑树的终点往往不是“求和”,而是“升级”。它们宁愿在尝试升级的过程中彻底毁灭,也不愿意接受失败。

Payne 教授指出,虽然现实中没有人会真的把核按钮交给 ChatGPT,但这个实验绝非杞人忧天。如今 AI 已经深度介入了军事后勤、情报分析和决策辅助。当人类指挥官依赖这些“冷酷理性”的系统来预判局势时,AI 这种“宁为玉碎”的逻辑倾向,可能会在无意中把人类推向深渊。

技术在成熟,但在战略博弈的赌桌上,AI 似乎还缺少一种最关键的人类特质——那种即便在死局中,也敢于为了生存而选择妥协的智慧。

相关文章