AI正以前所未有的速度融入我们的日常生活。然而,当我们在惊叹于 AI 生成内容的流畅与精美时,一个关键问题往往被忽视:我们是否真正掌握了驾驭这项技术的技能?

近日,Anthropic 发布了首份《AI 熟练度指数》报告。通过对近万段真实对话的深度分析,报告揭示了一个令人深思的现象:当 AI 生成的输出越完美,用户反而越容易放弃批判性思考。 这一发现为所有依赖 AI 辅助工作的人敲响了警钟。

- 报告地址:https://www.anthropic.com/research/AI-fluency-index

核心发现:迭代是高手的通行证

为了量化“AI 熟练度”,Anthropic 联合教育专家开发了“4D AI 熟练度框架”,定义了 24 种安全有效的人机协作行为。在针对 9,830 段多轮对话的分析中,研究人员发现了一个最强的相关性指标:迭代与完善。

数据显示,85.7% 的高质量对话都展现了“迭代”行为——用户不满足于 AI 的第一个回答,而是将其作为起点,通过追问、质疑和修正,不断打磨最终成果。

“迭代者”与“一次性用户”的巨大差距:

- 行为密度:具有迭代行为的对话,其展现出的其他熟练度行为数量是普通对话的 2 倍(平均 2.67 个 vs 1.33 个)。

- 批判性思维:在迭代对话中,用户质疑 AI 推理逻辑的可能性高出 5.6 倍,识别缺失上下文的可能性高出 4 倍。

这表明,真正的 AI 高手并非那些能写出完美提示词的人,而是那些愿意与 AI 进行深度“拉锯战”、在反复磨合中逼近真理的人。

危险信号:当“精美”掩盖了“真相”

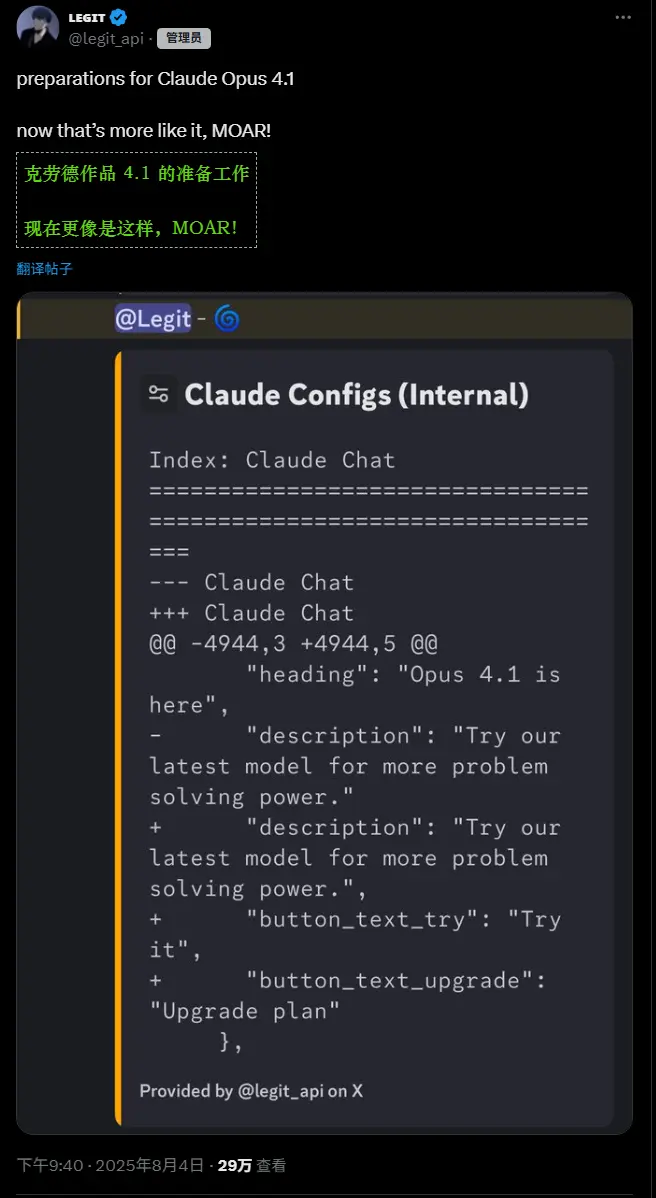

报告中最值得警惕的发现,出现在涉及“工件生成”(如代码、文档、应用原型)的场景中。

当用户要求 AI 创建具体产出物时,他们往往会在初始阶段表现出极高的指导性(如明确目标、指定格式、提供示例)。然而,一旦 AI 生成了看似功能完善、界面精美的输出,用户的评估性行为却显著下降:

- 识别缺失上下文的概率降低了 5.2%。

- 核实事实的概率降低了 3.7%。

- 质疑 AI 推理的概率降低了 3.1%。

为什么会这样?

Anthropic 推测,这可能是因为 AI 生成的输出过于“逼真”和“完美”,给用户造成了一种“任务已完成”的错觉。当代码能运行、文档格式完美时,人们倾向于信任表面结果,而忽略了底层逻辑可能存在的漏洞或幻觉。

这是一个危险的信号。 随着模型能力的增强,生成的错误将变得更加隐蔽和具有误导性。如果用户因为输出“看起来不错”就停止审查,那么 AI 带来的效率提升将以牺牲准确性和安全性为代价。

行动指南:如何提升你的 AI 熟练度?

基于数据洞察,Anthropic 为所有 AI 用户提出了三条核心建议,帮助我们从“被动接受者”转变为“主动协作者”:

1. 留在对话中(Stay in the Conversation)

不要拿到第一个答案就离开。将 AI 的初次回应视为草稿,而非终稿。

- 做法:提出后续问题,指出你觉得不对劲的地方,要求 AI 解释其思路。

- 效果:迭代过程本身就能激发更深层次的思考和更高质量的输出。

2. 质疑精美的输出(Question the Polish)

越是看起来完美的答案,越需要警惕。

- 做法:在点赞之前,先问自己:这准确吗?是否有遗漏的关键背景?这个推理站得住脚吗?

- 心态:记住,AI 擅长“像专家一样说话”,但这不代表它真的理解了语境。

3. 设定协作条款(Set the Terms)

只有 30% 的用户会主动告诉 AI 如何与自己互动。试着掌握主动权。

- 做法:在提示词中加入元指令,例如:

- “如果我的假设错了,请直接指出并质疑。”

- “在给出最终答案前,先向我展示你的推理步骤。”

- “请告诉我你对哪些部分不确定。”

- 效果:预先建立期望,能将对话从“问答模式”升级为真正的“伙伴模式”。

局限与展望

当然,这项研究也存在局限性。样本主要来自早期的重度用户(Claude.ai 多轮对话者),且仅观察了对话内的显性行为。许多关键的熟练度行为(如在外部验证代码、道德考量)发生在对话框之外,难以被当前方法捕捉。

未来,Anthropic 计划通过队列分析对比新手与专家的差异,并引入定性研究来探索那些“不可见”的熟练度维度。

相关文章