在视频生成模型多追求大参数堆料的当下,腾讯混元项目组推出的HunyuanVideo-1.5走出了一条“小而精”的差异化路线。这款仅搭载83亿参数的轻量级视频生成模型,不仅实现了开源领域顶尖的视觉质量与运动连贯性,更将运行门槛压低至消费级显卡水平,让个人开发者、中小创作者乃至中小企业都能低成本用上专业级视频生成技术。目前该模型已开源代码与权重,还接入腾讯元宝最新版,进一步降低了普通用户的使用门槛。

- 项目主页:https://hunyuan.tencent.com/video/zh?tabIndex=0

- GitHub:https://github.com/Tencent-Hunyuan/HunyuanVideo-1.5

- 模型:https://huggingface.co/tencent/HunyuanVideo-1.5

核心技术突破:用“巧劲”实现轻量与高性能平衡

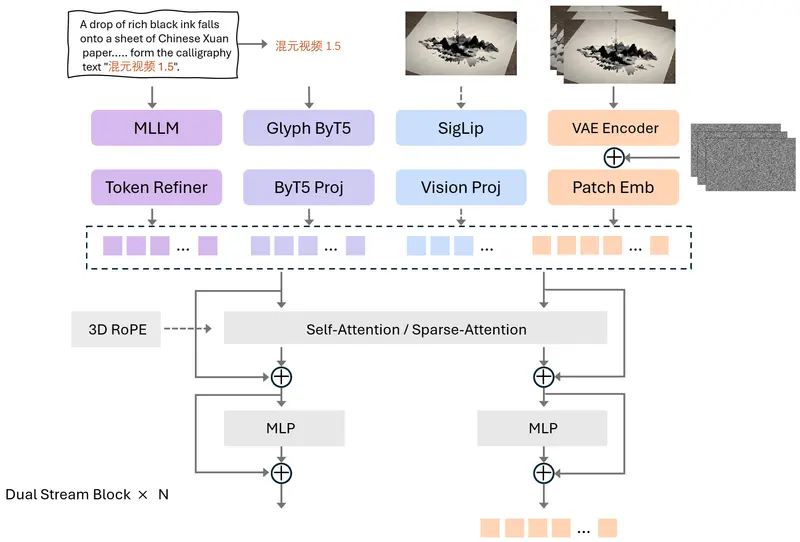

HunyuanVideo-1.5能以小参数达成高水准,核心在于多项针对性的技术创新,每一处设计都围绕“提升效率、优化效果”展开:

- 稀疏架构降本增效:模型采用 Diffusion Transformer(DiT)与3D因果VAE结合的架构,在空间维度实现16倍压缩、时间轴实现4倍压缩,大幅减少基础算力消耗。而创新的稀疏注意力SSTA机制更是点睛之笔,它能精准修剪冗余的时空kv块,在10秒720P视频合成场景中,相比FlashAttention-3实现了1.87倍的端到端推理加速,彻底解决了长视频序列计算量大的痛点。

- 全链路训练优化:采用多阶段渐进式训练策略,覆盖从预训练到后训练的完整流程。搭配Muon优化器后,模型收敛速度显著提升,同时在运动连贯性、画面美学质量上实现同步优化,让生成内容更贴合人类审美偏好,达到专业创作级别。

- 超分网络补全细节:内置高效少步数超分辨率网络,可将生成视频无损上采样至1080P。该网络不仅能提升画面锐度,还能智能校正生成过程中的轻微失真,让视频的细节纹理和整体质感再上一个台阶。

- 强化双语理解能力:通过专用OCR编码技术,模型原生支持中英文输入,能精准解析光影、构图等复杂语义指令,并自动转化为对应的视频生成参数,为跨语言、高精度的创作需求提供了保障。

全能创作能力:覆盖多场景视频生成需求

除了技术层面的优势,HunyuanVideo-1.5在实际创作场景中也展现出极强的实用性,无论是基础生成还是高阶创意,都能高效适配:

| 能力维度 | 具体表现 |

|---|---|

| 双模式生成 | 同时支持文生视频与图生视频,图生视频模式下能严格保持输入图像的色调、细节与风格,人物外形稳定,新增动态元素不会破坏场景协调性 |

| 精细化指令响应 | 可实现连续运镜、动作组合等复杂指令生成,支持推拉、摇移、环绕等多种运镜手法,轻松通过提示词控制视频节奏与视角切换 |

| 高品质视觉呈现 | 生成内容遵循物理规律,人物与物体运动流畅无畸变,既能还原柔性自然现象,也能精准呈现刚性物理效果;同时支持写实、动漫、复古等多种风格,还能响应大师级镜头、光影等电影级提示词 |

| 高保真文字渲染 | 可对中英文指令中指定的文字进行视频渲染,实现多种文字特效与背景的自然融合,减少后期手动调整的工作量 |

低门槛部署与使用:人人皆可玩转视频创作

HunyuanVideo-1.5最具颠覆性的亮点之一,便是大幅降低了专业视频生成技术的使用门槛,兼顾了技术开发者与普通创作者的需求:

- 亲民的硬件要求:仅需支持CUDA的NVIDIA显卡,在启用模型卸载功能时,14GB显存即可流畅运行。若显卡显存更充足,关闭卸载功能还能进一步提升推理速度,这一要求让主流消费级显卡用户都能轻松尝试本地部署。

- 多元的使用路径:普通用户无需复杂配置,通过腾讯元宝最新版就能直接体验——输入文字描述或上传图片添加指令,就能快速生成视频;企业用户和技术开发者则可通过GitHub仓库下载代码与权重,进行本地化部署和二次开发,适配商业化创作、技术研究等更多定制化场景。

- 轻量化推理优化:模型集成了模型蒸馏、Cache优化等技术,在降低硬件门槛的同时,进一步减少推理阶段的资源消耗,让本地运行时的卡顿、延迟问题得到有效缓解。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...