在动画制作、AR/VR开发、机器人运动规划等领域,“从单视角视觉信息生成多视图内容+结构化运动部件”是长期存在的技术难点——传统方法要么依赖多设备采集,要么难以保证运动部件在时间与空间上的一致性。

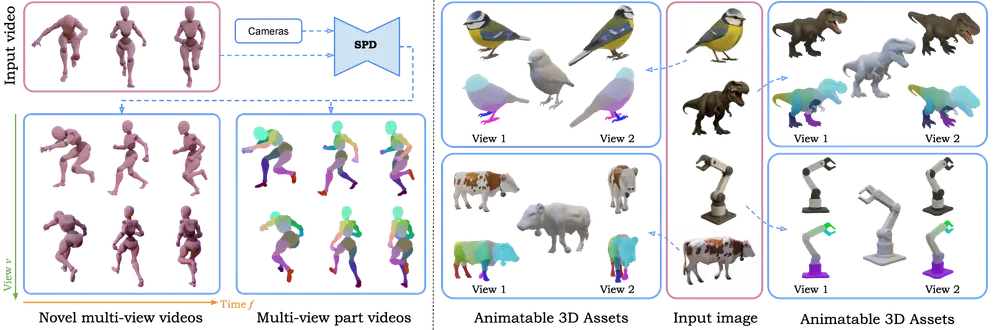

近期,Stability AI与伊利诺伊大学香槟分校的研究团队提出了Stable Part Diffusion 4D(简称SP4D) 框架,成功实现从单目输入(如一段单视角视频)出发,同步生成配对的多视图RGB视频与运动部件分割视频。与传统基于外观语义的部件分割技术不同,SP4D聚焦“运动部件”——即与物体关节运动对齐、且在多视图和时间维度上保持一致的结构组件,为下游动画、3D建模任务提供了更贴合实际需求的技术支撑。

SP4D核心技术:双分支协同,破解一致性难题

SP4D的核心创新在于通过“架构设计+损失函数”双重优化,解决了“RGB生成”与“运动部件分割”的协同问题,同时兼顾技术灵活性与泛化能力。

1. 双分支扩散模型:同步生成RGB与部件分割

SP4D基于SV4D 2.0框架扩展,采用双分支架构:

- RGB分支:负责生成多视图下的RGB视频帧,保证视觉效果的真实性与视角连贯性;

- 部件分割分支:负责生成对应的运动部件分割图,确保分割结果与物体关节运动精准对齐。

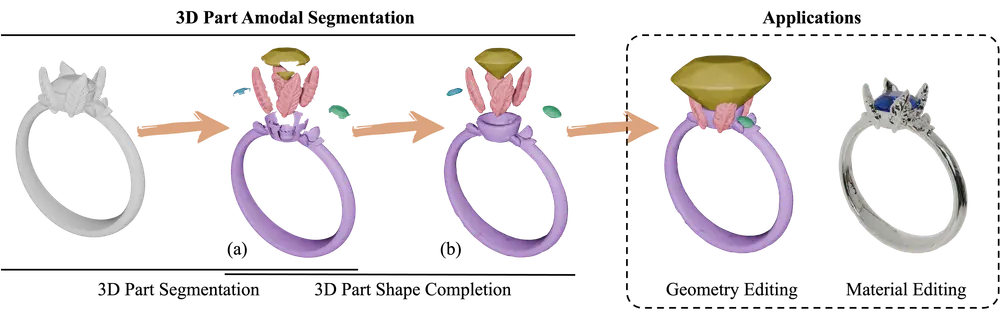

为简化架构并支持不同数量的部件分割需求,团队引入空间颜色编码方案——将离散的部件掩码(如“机械臂关节1”“机械臂关节2”)映射为连续的类RGB图像。这一设计让分割分支可直接共享RGB分支的“潜在变分自编码器(VAE)”,无需额外构建独立编码器,同时仅通过简单后处理即可恢复原始部件分割结果,兼顾效率与实用性。

2. 双向融合与损失函数:强化跨维度一致性

为避免两个分支“各自为战”,SP4D加入两大关键模块:

- 双向扩散融合(BiDiFuse):在双分支的每个UNet块之间插入该模块,实现RGB特征与部件分割特征的双向交换,确保外观(RGB)与结构(部件)的一致性;

- 对比部件一致性损失:通过对比同一部件在不同视图、不同时间步的特征,强制让“同一物理部件”在多维度下的分割结果保持稳定,解决传统方法中“视角变化/时间推移导致部件分割漂移”的问题。

测试结果:泛化能力覆盖多场景,性能优于传统方法

为验证SP4D的有效性,团队首先构建了KinematicParts20K数据集——从Objaverse XL中筛选并处理2万余个“可绑定对象”(如机械臂、人体模型、家具部件等),每个对象均包含多视图RGB视频与对应的部件分割序列,为训练与评估提供了高质量数据支撑。

1. 对比传统方法:突破多维度局限

传统技术在运动部件生成上存在明显短板,而SP4D实现了关键突破:

| 对比维度 | 传统方法(如SAM2、3D绑定方法) | SP4D框架 |

|---|---|---|

| 运动推理能力 | 基于外观分割,无法捕捉运动一致的部件 | 聚焦运动对齐,分割结果与关节运动精准匹配 |

| 新颖形状泛化 | 依赖特定类别先验(如仅能处理人体),泛化性差 | 无类别依赖,支持罕见关节姿势与新颖对象 |

| 动画实用性 | 分割关注语义区域(如“头部”),非物理关节,无法直接动画 | 分割聚焦物理关节,可直接用于下游动画任务 |

2. 定性与定量表现:多场景稳定输出

- 定性结果:在合成视频(如虚拟机械臂运动)与现实世界视频(如真实人体动作)中,SP4D生成的部件分割图在多视图、多时间步下均保持稳定,即使物体发生大幅形变(如机械臂弯曲、人体下蹲),分割边界也无明显漂移;

- 定量指标:在mIoU(平均交并比)、ARI(调整兰德指数)、F1分数等分割任务核心指标上,SP4D显著优于现有2D与3D部件分割方法;

- 用户研究:在“部件清晰度”“跨视角一致性”“动画适用性”三个维度的用户评分中,SP4D平均得分分别达4.42、4.09、4.26(满分5分),显著高于基线方法。

核心功能与应用:从2D生成到3D动画,打通全流程

SP4D不仅能生成多视图RGB与部件视频,更能打通“2D生成→3D建模→动画制作”的全流程,为多领域提供实用解决方案。

1. 四大核心功能

- 多视角RGB生成:从单目视频输入,扩展出多个视角的RGB视频,满足AR/VR多视角展示需求;

- 运动部件分割:分割结果与关节运动绑定,可直接用于分析物体运动结构(如机器人关节轨迹);

- 2D到3D提升:将2D部件分割图结合Hunyuan 3D 2.0技术重建3D几何,再通过HDBSCAN顶点聚类为每个网格顶点分配部件ID,生成带骨骼结构与蒙皮权重的3D资产;

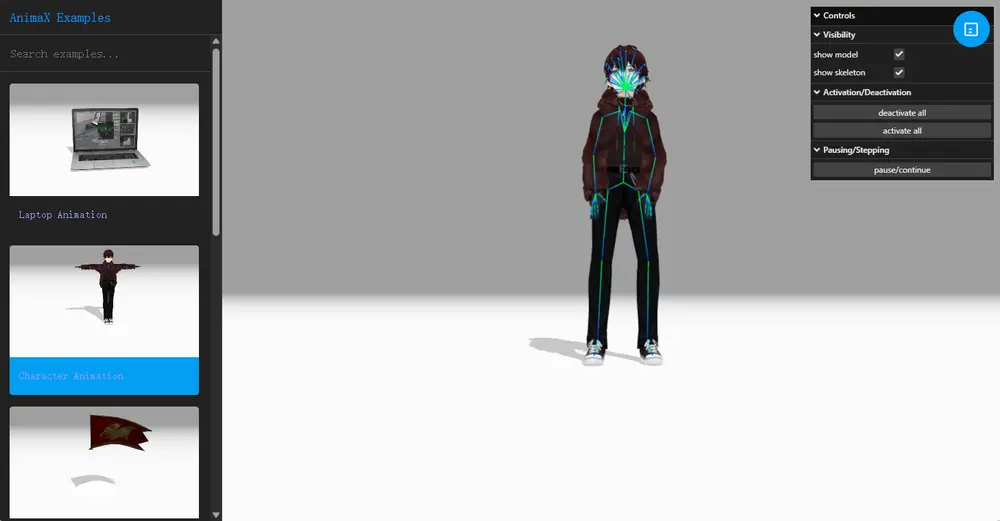

- 自动绑定动画:无需手动标注骨骼,3D资产可直接用于动画制作,支持复杂运动与形变(如让生成的虚拟机械臂完成抓取动作)。

2. 典型应用场景

- 动画制作:减少“手动骨骼绑定”的工作量,创作者仅需输入单段视频,即可快速获得动画就绪的3D模型,缩短制作周期;

- AR/VR开发:为AR/VR设备提供多视角一致的RGB与部件数据,支持交互式操作(如在VR中拆解虚拟机械部件);

- 机器人技术:生成机器人运动部件分割视频,辅助运动规划(如分析机械臂关节运动范围);

- 教育内容创作:快速将实物视频(如生物关节运动)转化为可动画3D模型,提升教学直观性。

局限与未来方向:持续拓展技术边界

尽管SP4D表现出色,当前仍存在两点局限:

- 相机参数限制:现有相机参数化设计难以处理“强透视畸变”(如广角镜头拍摄)或“复杂相机轨迹”(如快速移动拍摄)的场景;

- 多对象处理能力:当前模型假设场景中仅含一个对象,若存在多个运动对象(如两个机械臂协同工作),难以同时精准分割各对象的部件。

针对这些问题,团队规划了未来方向:进一步优化相机参数模型,支持6自由度相机运动;扩展多对象处理能力,让SP4D可应对复杂场景下的部件生成需求。

相关文章