来自Picsart AI研究部门、得克萨斯大学奥斯汀分校、佐治亚理工学院和伊利诺伊大学厄巴纳-香槟分校的研究团队推出先进的自回归技术StreamingT2V,能够创建具有丰富运动动力学的长视频,不会出现停滞现象。它确保视频中的时间一致性,与描述性文本紧密对应,并保持高帧级图像质量。

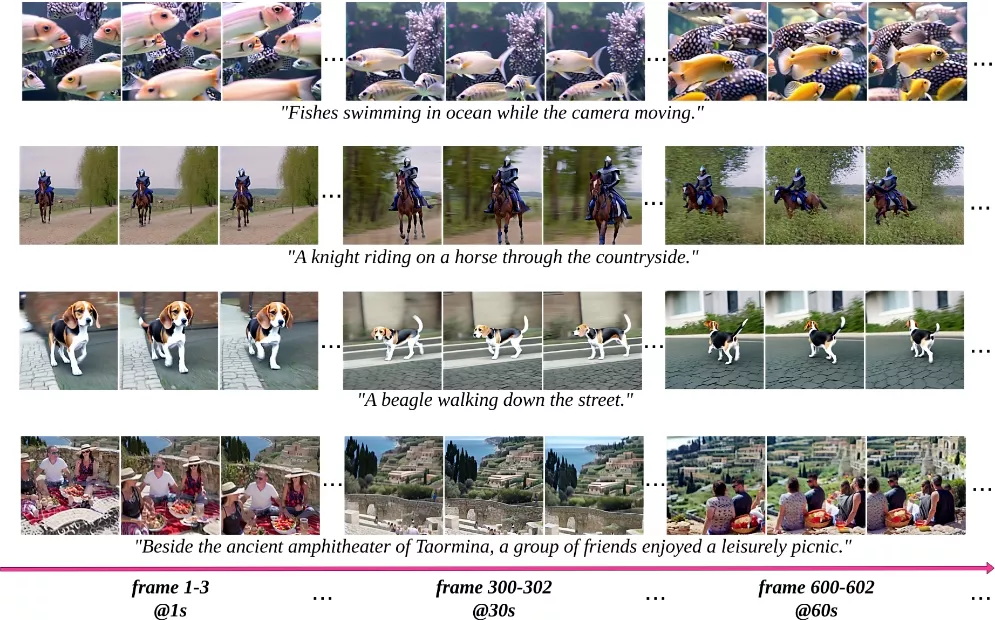

团队的演示包括成功创建的时长为 2 分钟、包含多达 1200 帧的视频示例,还可以扩展到更长的时长。重要的是,StreamingT2V 的有效性并不受所使用的特定 Text2Video 模型的限制,这表明基础模型的改进可以产生更高质量的视频。

例如,你只需要输入一段描述性的文本,比如“一只骆驼在雪地上休息”,StreamingT2V就能生成一个长达两分钟的视频,展示骆驼在雪地中的各种动作,而且视频画面流畅,没有突兀的剪辑或停滞。

主要功能和特点:

- 长视频生成: StreamingT2V能够生成包含丰富动态变化的长视频,而不是仅限于短片段。

- 连贯性: 视频在帧之间保持时间上的连贯性,避免了生硬的剪辑或场景切换。

- 高质量图像: 即使在视频的帧数非常多时,StreamingT2V也能保持高帧级图像质量。

- 记忆模块: 它使用了短期和长期记忆模块来保持视频内容的一致性,即使在很长的视频生成过程中也不会丢失初始场景的细节。

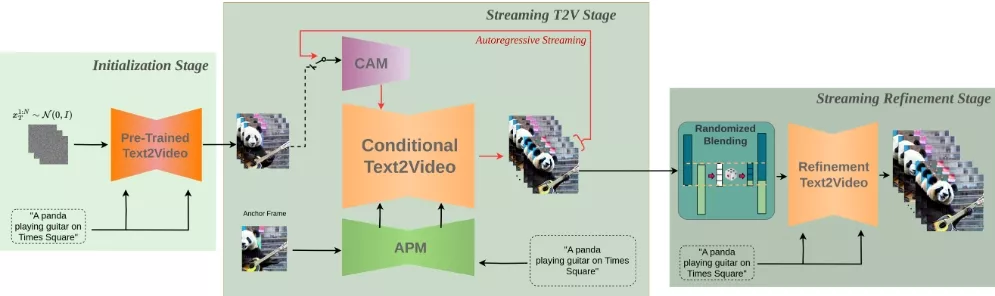

工作原理:

StreamingT2V的工作原理包括几个关键部分:

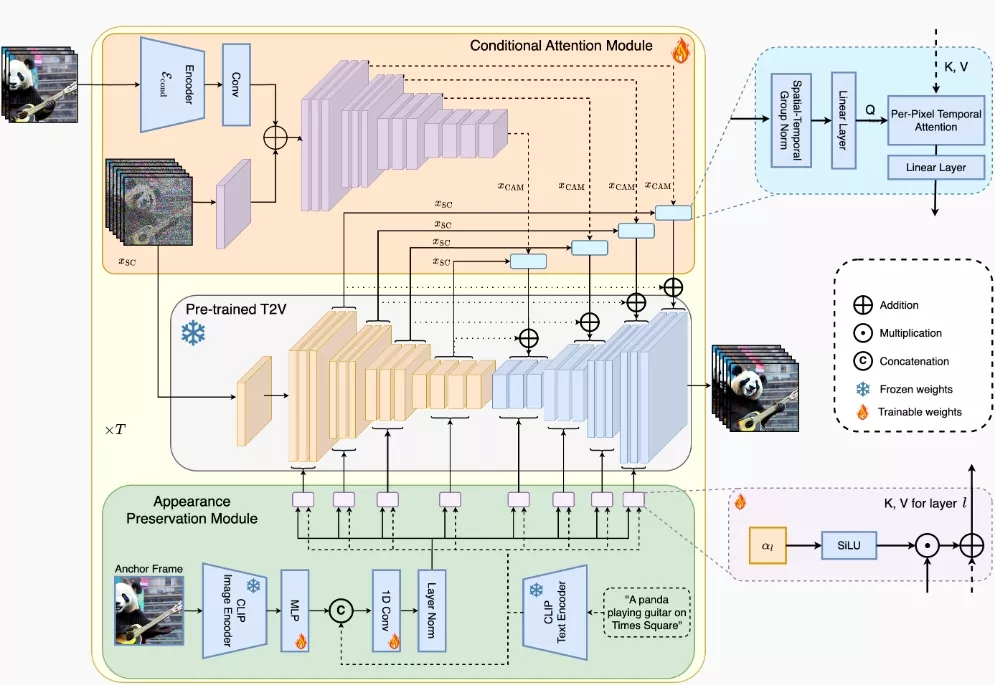

- 条件注意模块(CAM): 它通过注意力机制利用前一个视频块的特征来生成新的视频帧,确保视频块之间的平滑过渡。

- 外观保持模块(APM): 它从第一个视频块中提取高层次的场景和对象特征,确保在整个视频生成过程中保持对象和场景特征的一致性。

- 随机混合方法: 它允许在不产生块间不一致性的情况下,自回归地增强长视频的质量。

实验结果显示,StreamingT2V能够生成大量动态内容。相比之下,所有竞争的图像到视频方法在应用自回归方式时都容易遇到视频停滞的问题。因此,我们提出StreamingT2V,这是一种高质量、无缝衔接的文本到长视频生成器,它在一致性和动态性方面均优于竞争对手。

具体应用场景:

- 广告制作: 广告通常需要讲述一个故事,StreamingT2V可以生成具有丰富动态和情感的长视频广告。

- 社交媒体内容创作: 社交媒体上的故事功能需要吸引人的视频内容,StreamingT2V可以帮助内容创作者快速生成有趣的长视频。

- 电影和视频游戏预告片: 制作预告片需要大量的创意和视觉效果,StreamingT2V可以生成具有专业质量的动态视频片段。

StreamingT2V是一个强大的工具,它通过结合先进的自回归技术和记忆模块,能够从文本中生成长时间、高质量且连贯的视频内容。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...