月之暗面正式发布其新一代 MoE 架构大模型——Kimi K2,并同步开源。该模型具备卓越的代码能力、数学推理能力以及智能代理(Agent)任务处理能力,是目前最适配于构建自主化智能系统的开源基础模型之一。

- 项目主页:https://moonshotai.github.io/Kimi-K2

- GitHub:https://github.com/MoonshotAI/Kimi-K2

- 模型:https://huggingface.co/collections/moonshotai/kimi-k2-6871243b990f2af5ba60617d

核心亮点概览

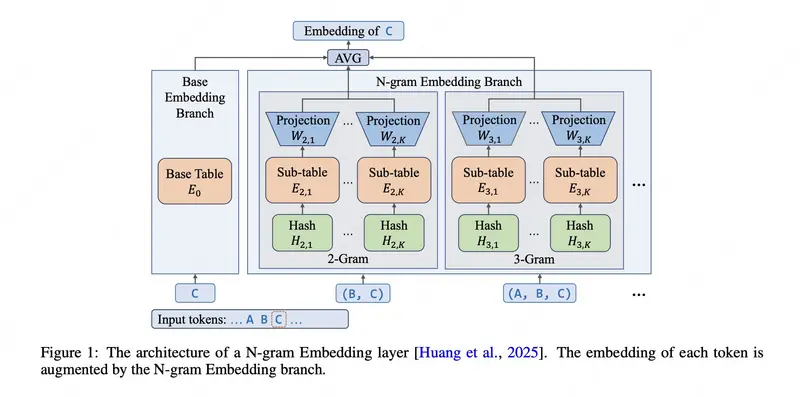

- ✅ 超大规模 MoE 架构:总参数达 1 万亿,激活参数为 320 亿;

- ✅ MuonClip 优化器训练:实现稳定高效的万亿级模型训练;

- ✅ Token 利用效率突破:在数据有限背景下提升预训练扩展空间;

- ✅ 智能代理能力突出:擅长工具调用、自主编程、多步骤推理;

- ✅ 全面开源支持定制:提供 Base 与 Instruct 两个版本,满足研究与应用需求。

性能表现

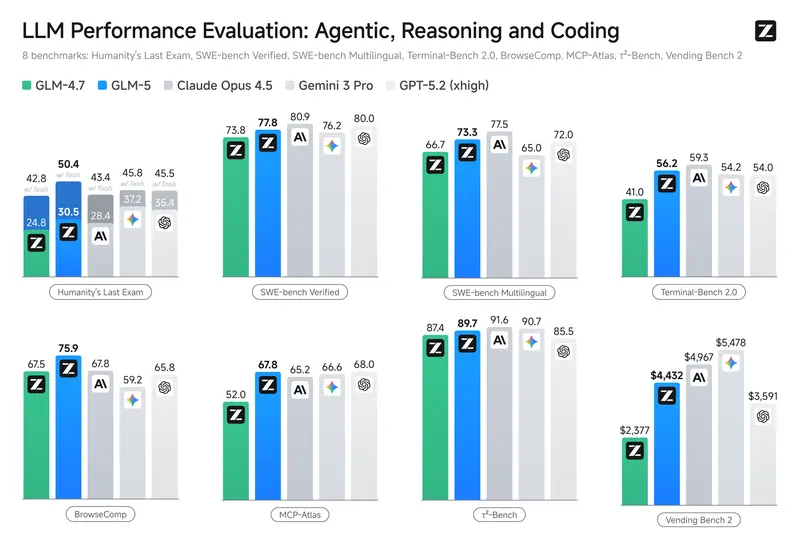

Kimi K2 在多个权威基准测试中表现优异:

| 基准名称 | 表现亮点 |

|---|---|

| SWE Bench Verified | 开源模型中当前最优结果 |

| Tau2 | 领先于主流闭源与开源模型 |

| AceBench | 工具使用与任务规划能力突出 |

| 数学与编码类任务 | 多项指标领先,展现强大推理能力 |

特别是在 Agentic Coding(自主编程)、Tool Use(工具调用) 和 Math & Reasoning(数学与推理) 三大维度上,Kimi K2 显示出显著优势。

技术架构与训练方法

MoE 架构设计

Kimi K2 是一个典型的稀疏门控专家混合(MoE)模型,采用动态激活机制,在保持模型容量的同时控制计算开销。

MuonClip 优化器创新

团队基于自研的 Muon 优化器进一步开发了 MuonClip,通过 qk-clip 技术有效缓解注意力 logits 爆炸问题,使模型在 15.5 万亿 token 上稳定训练,无任何尖峰或中断。

这一优化方案不仅提升了训练稳定性,也为未来更大规模的模型扩展提供了技术保障。

开源模型版本

Kimi K2 提供两个主要版本,满足不同场景需求:

1. Kimi-K2-Base

- 适用对象:研究人员、开发者;

- 特点:未经指令微调的基础模型,适合用于微调、科研实验及定制化开发。

2. Kimi-K2-Instruct

- 适用对象:开发者、产品工程师;

- 特点:经过通用指令后训练,即插即用,适用于聊天、智能代理等交互式场景。

主要应用场景

✅ 自主编程(Agentic Coding)

Kimi K2 能自动理解任务目标,编写代码并调试运行,适用于自动化软件工程流程。

示例:自动管理 Minecraft 渲染、执行测试、捕获日志、迭代改进代码直至所有测试通过。

✅ 工具调用(Tool Use)

支持复杂工具链的组合使用,如搜索、浏览网页、编辑文件、API 调用等。

示例:为伦敦 Coldplay 演唱会制定旅行计划,调用航班、Airbnb、Gmail、日历等工具完成一站式安排。

✅ 数学与推理任务(Math & Reasoning)

在数学证明、科学建模、统计分析等方面表现出色。

示例:从 wandb 实验中提取洞察,生成可视化报告,并进行深度分析。

使用方式

🌐 官网与 App 访问

用户可通过 kimi.com 或 Kimi App 免费体验 Kimi K2 模型(部分功能正在逐步上线)。

💡 API 接入

Kimi 平台已上线兼容 OpenAI 与 Anthropic 的 Chat API 接口,开发者可轻松迁移现有项目接入 Kimi K2。

- 支持上下文长度:最长 128K tokens

- 输入 Token 价格:4 元 / 百万 tokens

- 输出 Token 价格:16 元 / 百万 tokens

详细文档请访问:platform.moonshot.ai

🖥 自行部署

推荐使用以下推理引擎部署 Kimi K2:

- vLLM

- SGLang

- KTransformers

- TensorRT-LLM

具体部署指南详见 GitHub 仓库。

未来展望

虽然 Kimi K2 已具备强大的智能代理能力,但月之暗面表示将持续迭代,未来将加入:

- 更强的“思考”能力(Reasoning)

- 视觉理解能力(Vision)

- 更高级的 Agent 自我进化机制

这将进一步推动 Kimi K2 向更通用、更自主的智能代理系统演进。

相关文章