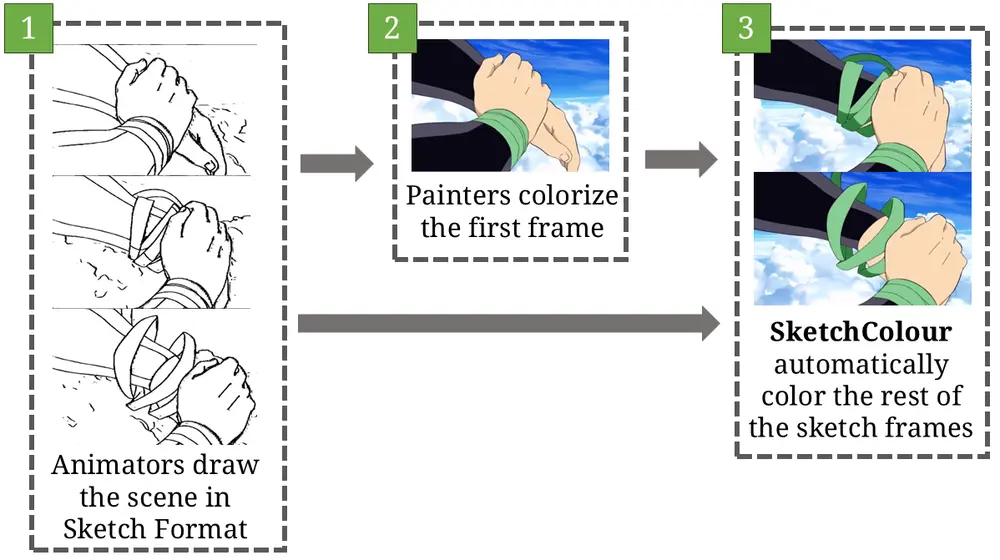

清华大学的研究人员提出了一种全新的 2D 动画着色方法——SketchColour。该方法基于扩散变换器(DiT)架构,能够将黑白草图序列自动转换为连贯的彩色动画,显著提升动画制作效率。

传统 2D 动画制作中,动画师需要逐帧绘制草图并手动上色,工作量巨大。而 SketchColour 只需用户提供第一帧的彩色参考图像,即可自动为后续所有帧完成高质量着色,生成风格一致、色彩稳定的动画序列。

核心功能一览

- 草图到彩色动画的自动转换

仅需提供首帧的彩色图像作为参考,模型即可为后续帧的黑白草图自动生成匹配的色彩。 - 保持色彩一致性

整个动画序列的色彩风格严格遵循首帧设定,有效避免颜色闪烁和“颜色渗漏”等问题。 - 高效生成机制

在参数规模、训练数据和 GPU 内存使用均较低的前提下,依然能输出高质量结果。

技术亮点解析

1. 基于扩散变换器(DiT)架构

相比传统的 U-Net 架构,DiT 更擅长处理全局上下文信息,从而在动画生成过程中更好地维持画面的一致性与动态流畅性。

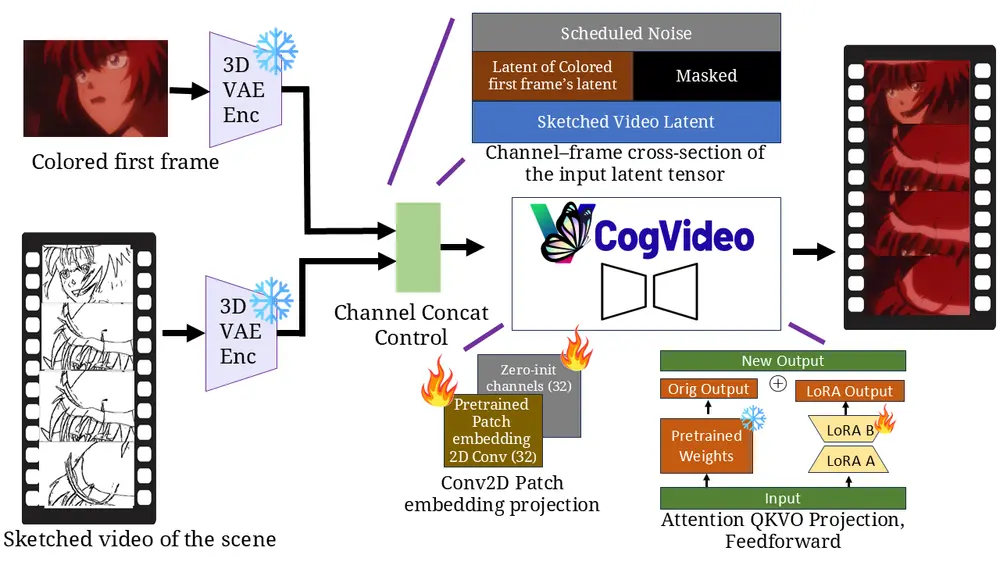

2. 轻量级通道拼接适配器 + LoRA 微调

通过引入轻量级的通道拼接模块,并结合低秩适应(LoRA)对模型进行微调,实现草图信息的有效注入,无需额外依赖 ControlNet 等复杂结构,降低了模型训练成本与参数需求。

3. 解决“潜在差距”问题

模型设计有效缓解了参考帧与后续帧在潜在空间表示上的差异问题,减少因特征偏移导致的颜色溢出,保证最终输出动画的质量稳定性。

工作流程简述

- 输入处理

模型接收两个关键输入:第一帧的彩色图像(参考帧)以及整个动画序列的黑白草图。 - 编码阶段

使用冻结的 3D VAE 编码器将参考帧和草图序列分别编码为潜在表示。 - 融合与微调

将参考帧与草图的潜在表示进行通道拼接,并通过 LoRA 对扩散变换器中的注意力层和前馈层进行微调,确保生成结果符合参考风格。 - 解码输出

利用 3D VAE 解码器将生成的潜在表示还原为最终的彩色动画视频。

实验评估结果

在 SAKUGA 数据集上的测试表明,SketchColour 在多个指标上均优于当前主流的视频着色方法(如 LVCD、ToonCrafter 和 AniDoc),且训练数据仅为其他模型的一半。

定量对比(以 17 帧视频为例)

| 指标 | SketchColour |

|---|---|

| PSNR | 19.51 |

| SSIM | 0.78 |

| LPIPS | 0.25 |

| FVD | 918.70 |

定性分析

与现有方法相比,SketchColour 在以下方面表现突出:

- 色彩一致性更强,无明显闪烁或跳跃

- 物体变形更自然,运动过渡更流畅

- 颜色溢出控制良好,画面干净整洁

训练与推理配置

- 实现框架:PyTorch

- 硬件环境:2 块 NVIDIA A40 GPU(使用 DDP 分布式训练)

- 精度设置:Transformer 层使用 float32,其余组件使用 bfloat16

- 优化策略:

- 使用混合精度加速训练

- 引入潜变量预计算

- CPU 卸载 + VAE 切片 + VAE 平铺

- 使用 Torch 编译加速模型训练

训练时每 GPU 显存占用约 28GB,推理时约为 37GB。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...