香港中文大学、上海交通大学、南洋理工大学和上海人工智能实验室的研究人员推出Imagine360框架,它能够将标准透视视频转换为360°全景视频,从而为用户提供全方位的沉浸式视频体验。Imagine360是第一个从透视视频生成360°视频的框架,它通过学习有限的360°视频数据中的精细球面视觉和运动模式,创建出具有丰富多样运动模式的高质量360°视频。

例如,你手中有一个用手机拍摄的普通视角视频,记录了一次城市街头的繁忙景象。通过Imagine360,这个视频可以被转换成一个360°全景视频,让你能够在虚拟现实头盔中从任何角度重新体验这个场景,就像你真的置身于视频中一样。

主要功能

Imagine360的主要功能包括:

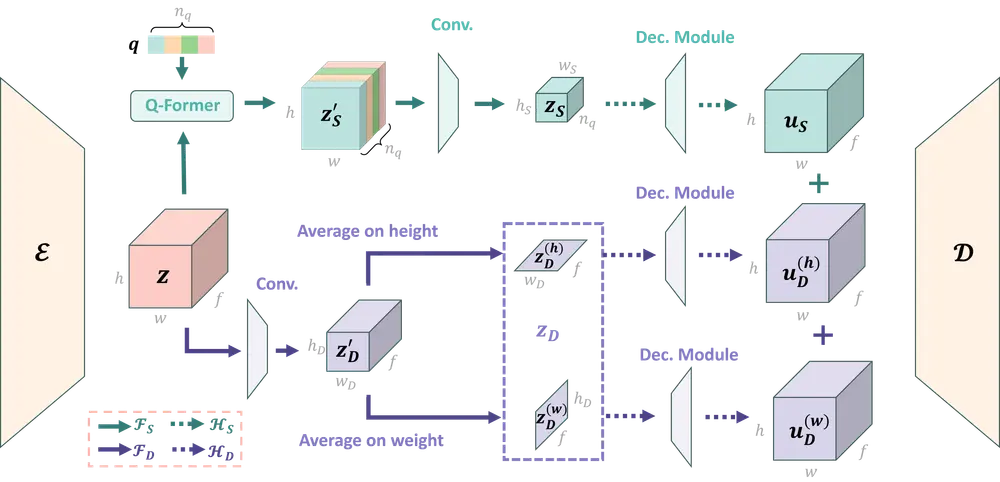

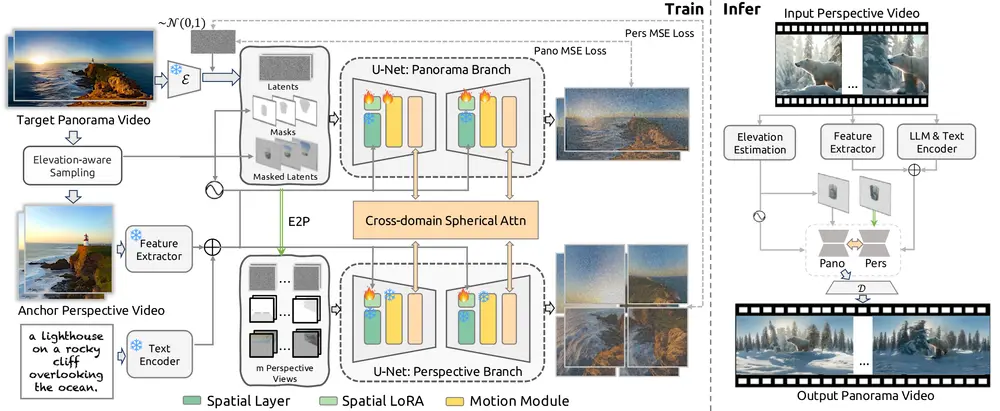

- 双分支视频去噪:使用全景分支和透视分支联合去噪360°空间-时间潜在表示。

- 跨域球面注意力:通过抗足点掩码(antipodal mask)捕获全景视频中的长距离运动依赖性。

- 抗足点掩码:模拟全景视频中的反向运动,增强反向相机运动。

- 高度感知设计:适应不同仰角变化的视频输入,确保从不同视频锚点生成稳健的全景视频。

主要特点

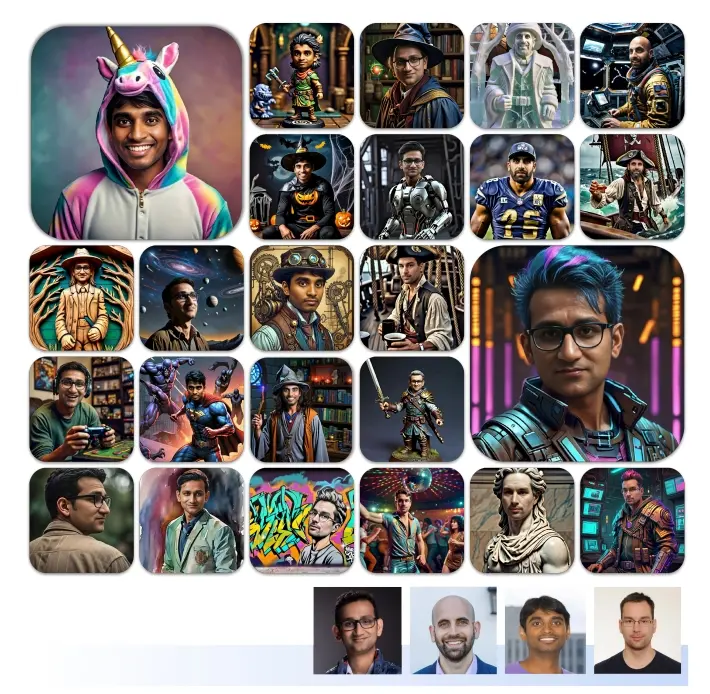

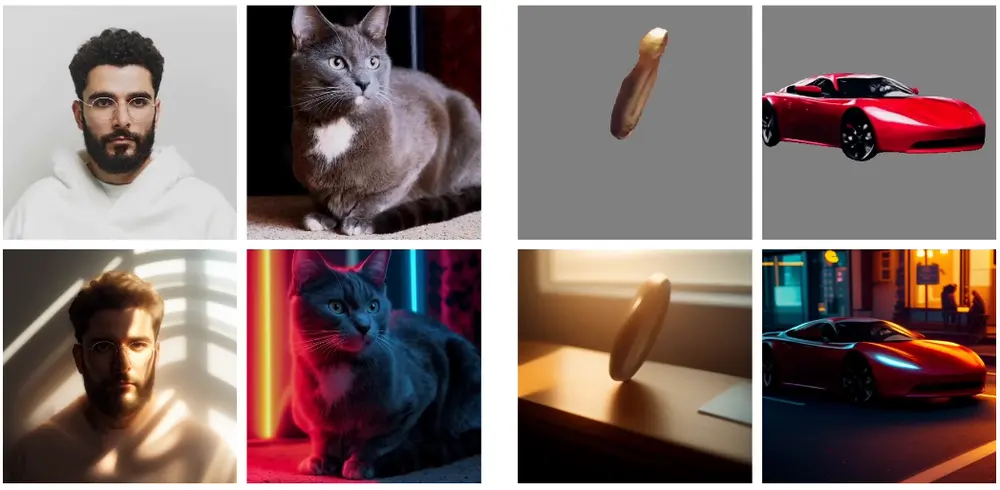

- 高质量视频生成:从有限的360°视频数据中学习,生成具有丰富细节和复杂运动的高质量360°视频。

- 球面视觉和运动模式:通过双分支设计和跨域注意力机制,学习球面视觉和运动模式。

- 高度适应性:通过高度感知的数据采样和估计模块,适应不同仰角的视频输入。

- 端到端生成:从透视视频输入直接生成360°视频,无需额外的图像或文本引导。

工作原理

Imagine360的工作原理涉及以下几个步骤:

- 双分支设计:全景分支和透视分支并行处理,分别提供全局和局部的视觉和运动信息。

- 跨域球面注意力:通过直接映射和抗足点映射,增强全景和透视域之间的信息交换。

- 抗足点掩码:在跨域球面掩码中强调抗足点激活,以模拟全景视频中的反向运动。

- 高度感知设计:在训练和推理中引入高度感知的数据采样和估计,以适应不同仰角的视频输入。

具体应用场景

Imagine360的应用场景包括:

- 虚拟现实和增强现实:为用户提供全方位的沉浸式视频体验,适用于虚拟现实头盔和增强现实应用。

- 娱乐和游戏:在游戏和电影制作中创建全景视频,提供更丰富的视觉内容。

- 教育和培训:通过全景视频提供360°的学习环境,增强学习体验。

- 旅游和房地产:通过全景视频展示旅游景点或房产,让用户远程体验现场环境。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...