韩国科学技术研究院推出新型框架VideoGuide,它能够改善视频生成模型在时间连续性方面的性能,同时保持甚至提高生成视频的图像质量。这就意味着,使用VideoGuide,可以让现有的视频生成模型在不经过额外训练或微调的情况下,生成更加流畅且连贯的视频。

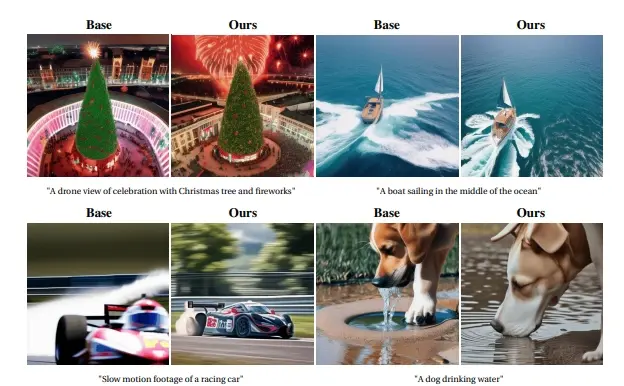

例如,你想要生成一段描述“一只狗在喝水”的视频,使用VideoGuide可以在不牺牲图像质量的前提下,确保视频中的狗的动作看起来自然流畅,没有突兀的变化。这在生成描述性或叙事性视频内容时尤其有用,比如为社交媒体制作视频或者为教育内容制作动画。

主要功能

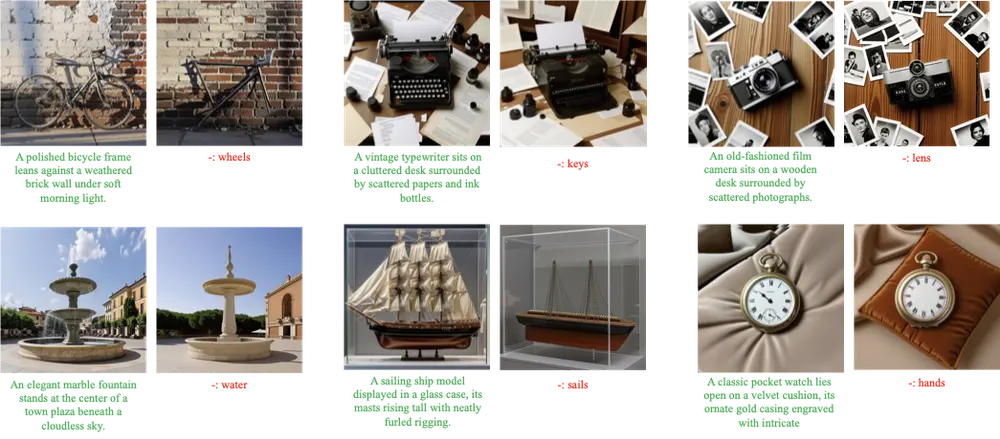

VideoGuide的主要功能是增强预训练的视频扩散模型(VDM)在时间上的连贯性。具体来说,它通过以下几个方面来提升视频生成的质量:

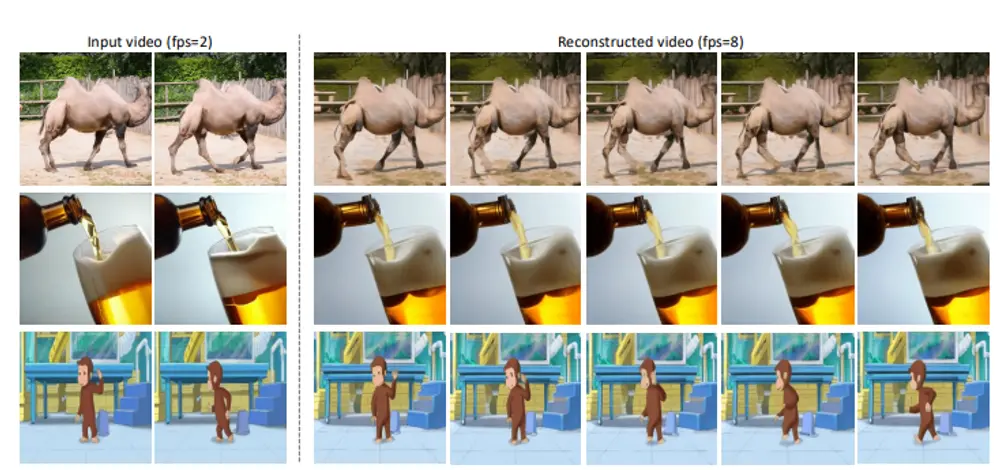

- 改善时间连续性:让视频中的物体动作看起来更自然,连续帧之间的变化更平滑。

- 保持成像质量:在提升视频流畅性的同时,不牺牲每帧图像的清晰度和细节。

- 无需额外训练:直接利用已有的预训练模型,通过引导的方式在推理阶段提升性能。

主要特点

- 通用性:能够与任何预训练的视频扩散模型配合使用。

- 灵活性:可以选择使用与生成模型相同的模型作为引导,也可以选择其他任何现有的视频扩散模型。

- 高效性:仅在推理的早期阶段引入少量的引导步骤,对计算资源的需求小。

工作原理

VideoGuide的工作原理可以简化为以下几个步骤:

- 选择引导模型:可以选择任何已经预训练好的视频扩散模型作为引导模型。

- 早期步骤引导:在视频生成过程的早期步骤中,使用引导模型生成的视频轨迹来引导当前模型的样本,通过插值的方式将引导模型的去噪样本整合到采样模型的去噪过程中。

- 插值和去噪:通过在引导模型和采样模型之间进行插值,生成在时间上更加连贯的视频样本。

- 低通滤波:为了保持图像质量,特别是高频区域的细节,使用低通滤波器来处理去噪后的样本。

具体应用场景

VideoGuide的应用场景包括但不限于:

- 个性化视频生成:根据用户的文本描述生成个性化的视频内容。

- 视频内容增强:提升现有视频内容的质量和观看体验。

- 多媒体创作:辅助视频制作人员快速生成或编辑视频素材。

- 虚拟现实和游戏:生成更加真实和连贯的动态背景或动画。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...