现在的 AI 画图工具,大多有个“通病”:你让它“把车往左挪一点”,它可能给你换了一辆车;你让它“旋转 30 度”,它可能直接把车轮画歪了。

它们懂语义,但不懂空间。

最近,由香港大学、京东探索研究院、清华大学等团队联合推出的 SpatialEdit,试图解决这个问题。它不再只是“大概改一改”,而是真正实现了“指哪改哪”的精准空间操控。

- GitHub:https://github.com/EasonXiao-888/SpatialEdit

- 模型:https://huggingface.co/EasonXiao-888/SpatialEdit-16B

什么是 SpatialEdit?

简单来说,它是一个懂几何、懂空间的图像编辑模型。

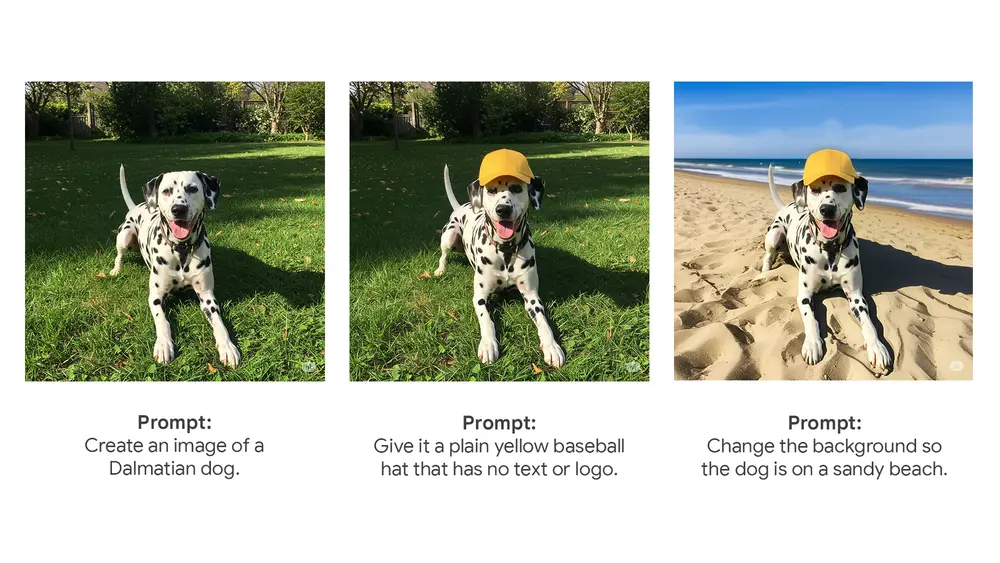

不同于传统 AI 只能换个风格或增减物体,SpatialEdit 能精准执行包含空间几何信息的指令。比如:

- “把这只猫移到红色框内。”

- “将汽车旋转到右后方视角。”

- “相机向左旋转 90 度。”

它不仅听得懂,还能做得准——物体位置、大小、角度严丝合缝,背景不穿帮,画面不扭曲。

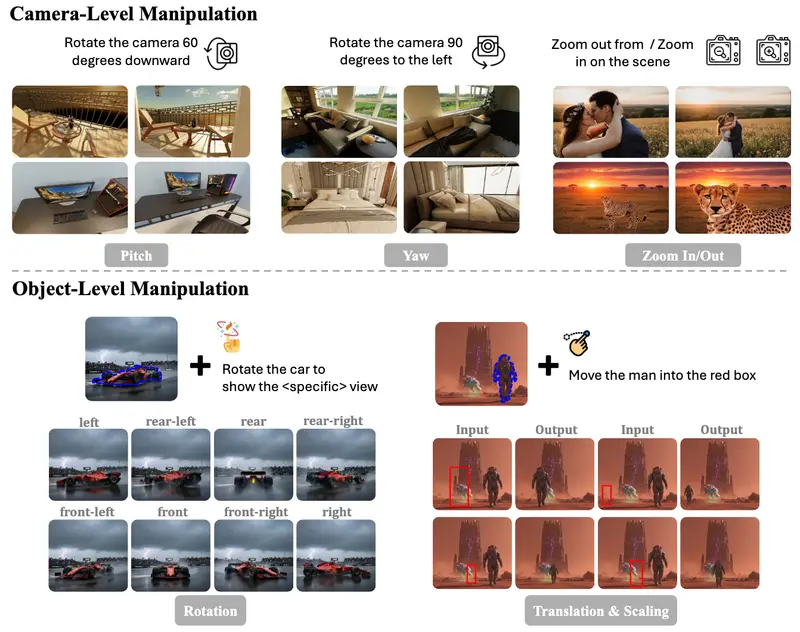

核心能力:物体与相机的双重掌控

SpatialEdit 主要解决两大类难题:

- 物体级操控:

- 移动:精准定位,想放哪就放哪。

- 旋转:支持前、后、左、右等 8 个方向的视角转换。

- 缩放:调整大小而不破坏背景结构。

- 相机级操控:

- 视角变换:左右偏航、上下俯仰,模拟真实摄影机的运动。

- 变焦:放大或缩小画面,保持场景透视自然。

最重要的是保真。它在修改空间关系的同时,牢牢锁住物体的外观特征和背景的完整性,避免了传统方法中常见的“液化感”或“鬼影”。

它是怎么做到的?

SpatialEdit 的核心逻辑可以概括为三步:

- 建立 3D 认知:通过海量合成的 3D 数据训练,让模型理解物体在三维空间中的位置、角度和透视关系。

- 精准指令解析:将自然语言中的空间指令(如“左转 30 度”)转化为具体的几何约束。

- 级联生成:在严格的空间约束下生成新图像,确保每一步变化都符合物理规律。

为了验证效果,团队还发布了包含 50 万训练数据的专用数据集和评测基准,并开源了 16B 参数的大模型。测试显示,其在空间编辑的准确性上全面超越现有主流模型,误差降至最低。

谁能从中受益?

- 电商卖家:无需重新拍摄,一键生成商品的多角度展示图,大幅降低拍摄成本。

- 平面设计师:精准调整元素位置和视角,告别手动拖拽对齐的繁琐。

- 影视后期:静态素材快速转换视角,辅助分镜设计和构图调整。

- 3D 创作者:从单张图片生成多视角视图,加速 3D 建模流程。

- 普通用户:修图时想把人物移得更居中、把风景照调出更广的视角,现在只需一句话。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...