在虚拟现实(VR)、游戏开发和数字孪生领域,高质量 3D 场景的构建一直是最大的瓶颈。传统建模需要专业技能和数周时间,而现有的“文本生成 3D”技术往往只能生成单一视角的物体,或者生成的全景场景存在严重的视角不一致(如正面是门,转过去墙就消失了)和几何扭曲问题。

- 项目主页:https://dreamscene360.github.io

- GitHub:https://github.com/ShijieZhou-UCLA/DreamScene360

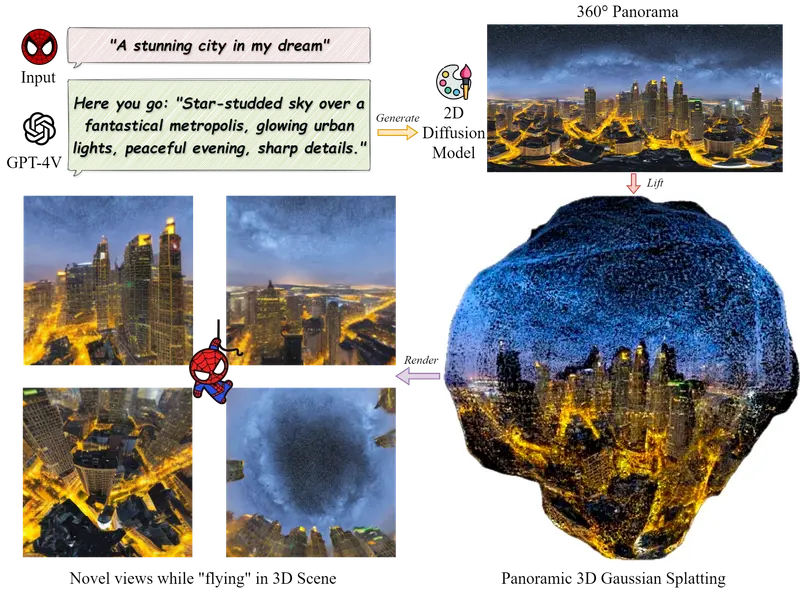

由 加州大学洛杉矶分校 (UCLA)、德克萨斯大学奥斯汀分校 和 DEVCOM ARL 联合推出的 DreamScene360 正式亮相。这是一个革命性的文本到 3D 生成框架,它利用 GPT-4V、2D 扩散模型 和 全景高斯泼溅 (Panoramic Gaussian Splatting) 技术,实现了从任意文本描述到全局一致、细节丰富、可实时漫游的 360°3D 场景的“一键式”生成。

核心突破:全、快、准、灵

DreamScene360 解决了现有技术的四大痛点,重新定义了文本生成 3D 的标准:

1. 真正的 360° 全景覆盖

- 无死角漫游:生成的场景覆盖前后左右、上下全方位,没有任何视角盲区或黑色空洞。

- 自由飞行:用户不仅可以在场景中旋转视角(Yaw/Pitch),还可以进行平移(Translation),真正像在真实世界中一样行走、飞行,体验沉浸式探索。

2. 风格与内容的无限可能

- 多样化风格:从写实的“阳光明媚的后院”、“赛博朋克城市”,到虚构的“零重力太空市场”、“奇幻森林”,甚至精准还原“马丘比丘”等地标,都能完美呈现。

- 灵活指令:无需复杂的提示词工程。无论是简短的“一间舒适客厅”,还是详尽的长段落描述,系统都能精准理解并执行。

3. 分钟级极速生成

- 高效流程:整个生成过程仅需 约 7 分钟(含优化迭代),即可产出高质量的 3D 场景。

- 实时渲染:基于 3D 高斯泼溅 (3DGS) 技术,生成的场景支持 实时帧率渲染,无需漫长的预计算,即可在 VR 头显或网页中流畅交互。

4. GPT-4V 驱动的自我进化

- 智能优化:集成 GPT-4V 作为“质量评估员”。它会自动审视生成的全景图,从物体数量、属性、布局等维度打分,并提出修改建议(如“增加一盏落地灯”、“让光线更柔和”),然后自动调整提示词重新生成,直至达到最佳效果。

- 零门槛:用户无需手动调试,系统自动完成多轮迭代,确保输出结果最符合预期。

工作原理:四步构建虚拟世界

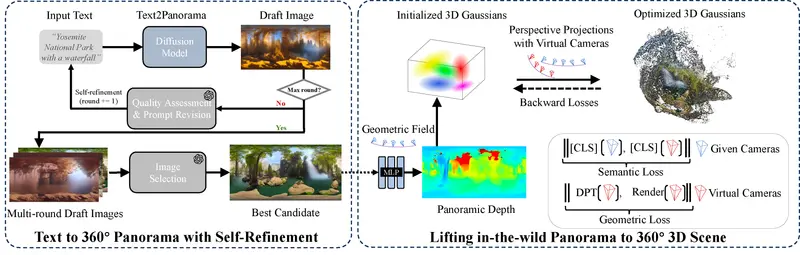

DreamScene360 的创新在于其巧妙的“全景图搭桥 + 高斯升级”流程:

第一步:文本 → 优化后的全景图

- 利用 2D 扩散模型 根据文本生成初始的 360° 全景图像(Equirectangular Projection)。

- GPT-4V 闭环:GPT-4V 分析图像与文本的匹配度,提出优化建议,系统自动重写提示词并重新生成,经过数轮迭代后锁定最佳全景图。这确保了场景在语义和风格上的全局一致性。

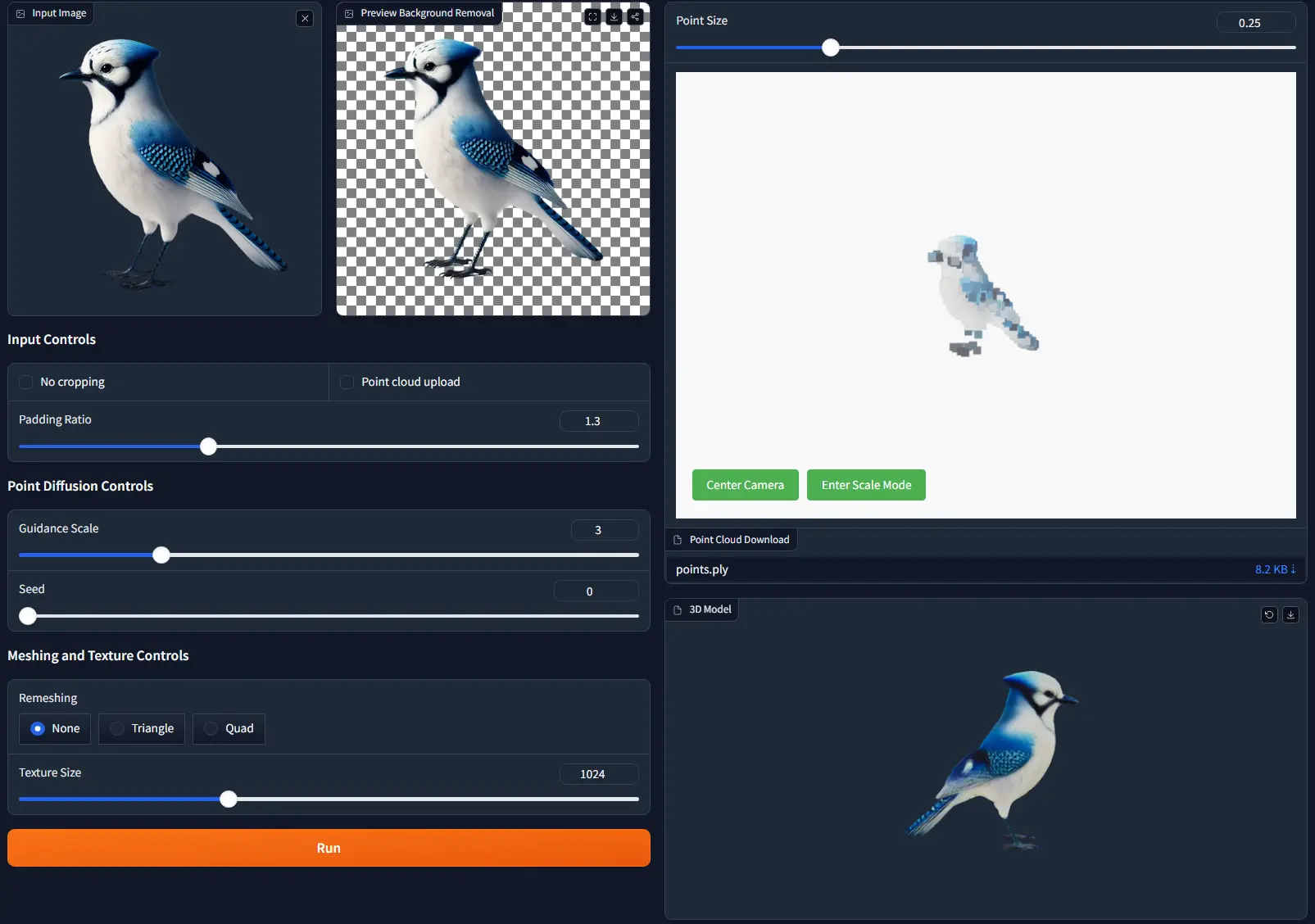

第二步:全景图 → 3D 点云骨架

- 使用预训练的 单目深度估计模型,为全景图的每个像素计算深度值。

- 通过 球面投影 将“RGB-D 全景图”转换为密集的 3D 点云。

- 引入 可学习几何场 对点云进行全局优化,修正深度偏差,形成稳固的场景“骨架”。

第三步:虚拟视角 → 填补盲区

- 针对全景图固有的“单视角遮挡”问题(如物体背面看不见),系统模拟生成多个 虚拟相机,在原始视角附近进行微小平移和旋转。

- 利用这些虚拟视角渲染出的图像,提取 语义约束 和 几何约束,指导后续优化,确保被遮挡区域的内容合理、自然,不会出现逻辑矛盾。

第四步:3D 高斯泼溅 → 最终场景

- 以优化后的点云为初始化中心,构建 3D 高斯泼溅 (3DGS) 模型。

- 在 原始全景图 和 虚拟视角图像 的双重监督下(结合语义和几何损失),不断调整高斯粒子的位置、大小、颜色和透明度。

- 最终输出一个 全局一致、细节丰富、支持实时渲染 的 3D 场景。

实测表现:全面超越 SOTA

在与当前领先技术 LucidDreamer 的对比测试中,DreamScene360 展现了压倒性优势:

| 维度 | LucidDreamer | DreamScene360 |

|---|---|---|

| 视角一致性 | ❌ 常出现纹理重复、几何扭曲、视角穿帮 | ✅ 全局语义统一,几何结构精准,无盲区 |

| 漫游体验 | ⚠️ 仅支持旋转,平移会导致画面崩坏 | ✅ 支持 6-DoF 自由漫游(旋转 + 平移) |

| 细节质量 | ⚠️ 细节模糊,物体边缘 artifacts 多 | ✅ 纹理清晰,家具/植物/建筑细节丰富 |

| 生成效率 | ⚡ 6 分 15 秒 | ⚡ 7 分 20 秒 (质量提升显著,时间可接受) |

| 指令理解 | ⚠️ 需精细提示词 | ✅ GPT-4V 自动优化,简单指令即可 |

此外,相比基于 NeRF 的技术(如 PERF),DreamScene360 的 训练速度快 4.6 倍,且渲染质量更高,无边缘扭曲。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...