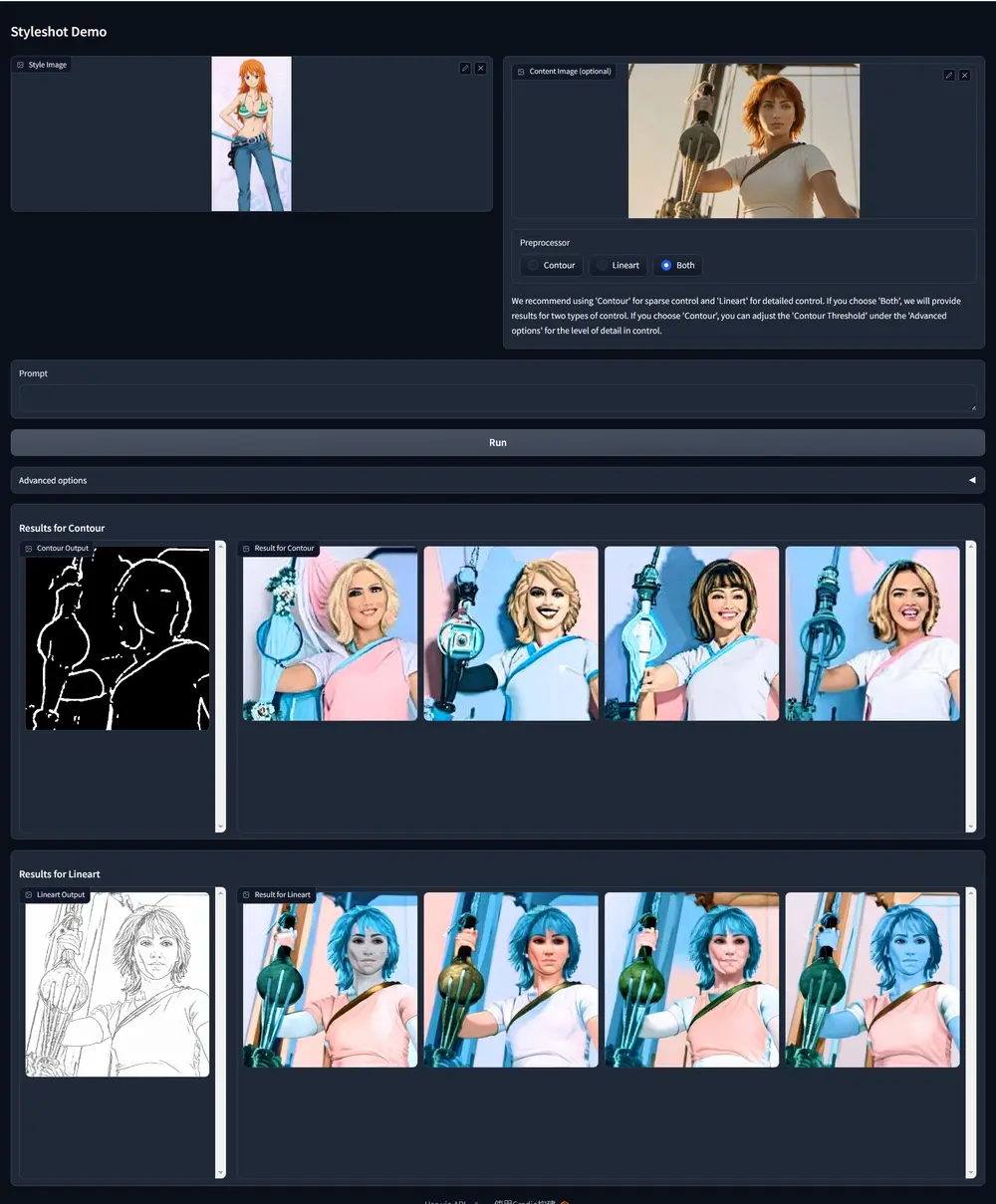

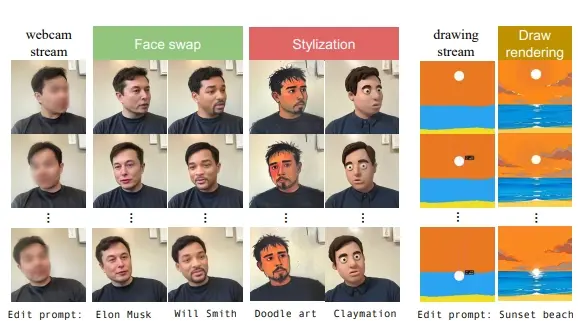

德克萨斯大学奥斯汀分校和加州大学伯克利分校的研究人员推出新型视频扩散模型StreamV2V,它能够实现实时的视频到视频(Video-to-Video,简称V2V)翻译。这项技术允许用户通过提示(prompts)实时地将输入的视频流转换成不同风格或内容的视频。例如,可以将网络摄像头实时捕获的人物图像变换成名画风格,或者将视频中的人物换成另一个人的面孔。

- 项目主页:https://jeff-liangf.github.io/projects/streamv2v

- GitHub:https://github.com/Jeff-LiangF/streamv2v

例如,你是一名视频博主,想要在直播中将自己的形象变成某个名人的样子。你可以使用StreamV2V,通过简单的文本提示,实时地将你的面孔替换成名人的面孔,而观众看到的就是经过转换后的视频流。这样的技术不仅能够增加直播的趣味性,还能够在各种视频创作中提供更多可能性。

主要功能和特点:

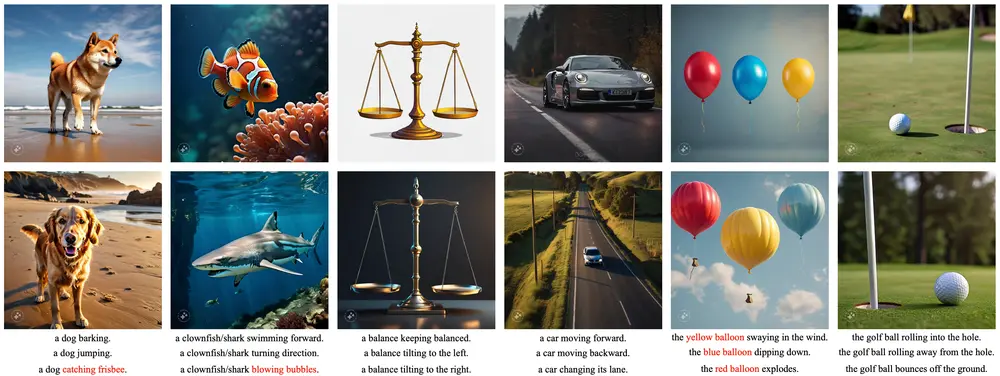

- 实时处理:StreamV2V能够实时处理视频流,与之前需要批量处理帧的方法相比,它能够处理无限长度的视频。

- 用户提示:用户可以通过文本提示来指导视频的转换,如指定视频的风格或内容。

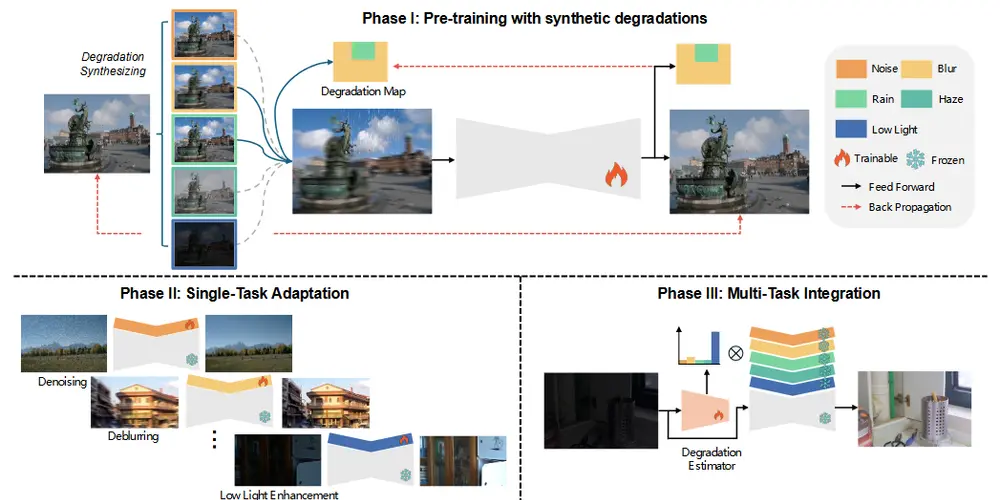

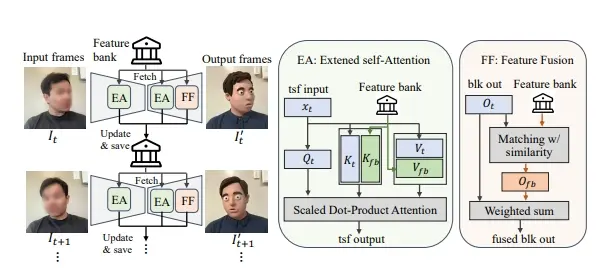

- 向后看原则:模型通过维护一个特征库(feature bank),存储过往帧的信息,并将这些信息用于当前帧的生成,以确保视频的连贯性。

- 高效性:StreamV2V在单个A100 GPU上能够以20帧每秒的速度运行高分辨率视频(512×512),比其他方法快15倍至158倍。

- 无需微调:与现有需要训练或微调的模型不同,StreamV2V可以直接与任何图像扩散模型集成,无需额外的训练。

工作原理:

StreamV2V的核心是一个特征库,它存储了之前帧的中间特征。对于新到来的帧,模型通过扩展自注意力机制(Extended self-Attention)来包含库中的键(keys)和值(values),直接将相似的过去特征融合到输出中。此外,模型还通过特征融合(Feature Fusion)技术,显式地根据对应关系增强细节的一致性。特征库会通过动态合并(Dynamic Merging)技术不断更新,以保持其紧凑且信息丰富。

具体应用场景:

- 网络摄像头流转换:可以用于视频会议或直播中,实时改变人物的外貌或背景。

- AI辅助绘画:艺术家可以利用这项技术实时地将他们的绘画作品转换成不同的风格。

- 视频编辑和后期制作:在电影制作或视频内容创作中,可以快速预览视频编辑的效果,加速创作流程。

- 虚拟现实和增强现实:在VR或AR应用中,实时地改变场景或对象的视觉风格。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...