加州大学圣克鲁斯分校的研究人员推出高质量数据集HQ-Edit,它专门用于基于指令的图像编辑任务。例如,你有一张图片,想要根据某些具体的指令来修改它,比如改变背景、调整物体的颜色或者添加一些新元素。HQ-Edit数据集就是为了帮助开发和训练这样的图像编辑工具而设计的。

- 项目主页:https://thefllood.github.io/HQEdit_web

- GitHub:https://github.com/UCSC-VLAA/HQ-Edit

- 数据集:https://huggingface.co/datasets/UCSC-VLAA/HQ-Edit

- Demo:https://huggingface.co/spaces/LAOS-Y/HQEdit

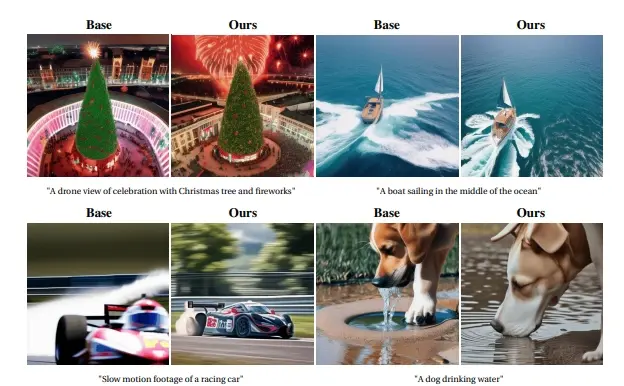

与先前依赖属性指导或依赖人类反馈来构建数据集的方法不同,开发团队设计了一种可扩展的数据收集流程,这一流程利用先进的基础模型,即GPT-4V和DALL-E 3。为确保数据集的高品质,开发团队首先在线收集多样化的样本,进行扩展,然后创建包含输入和输出图像的高质量对开画,并附上详细的文本提示。之后,通过后期处理确保精确对齐。

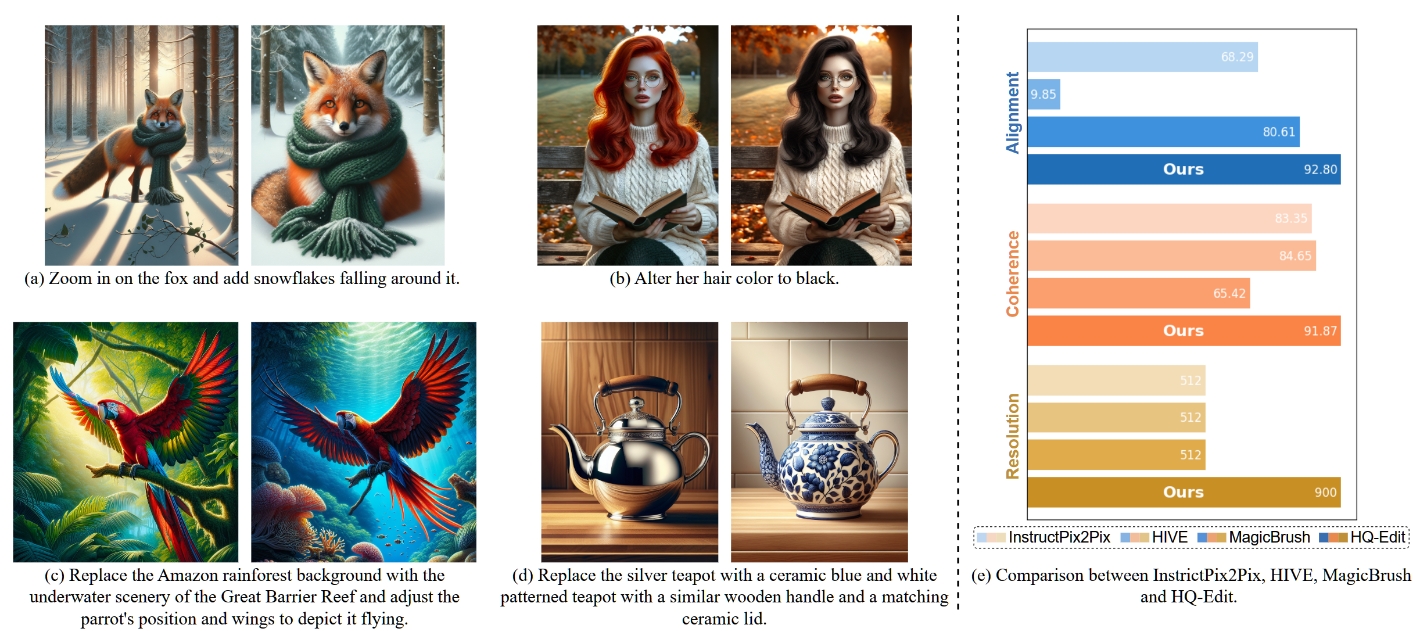

此外,开发团队提出了两个评估指标,即对齐度和一致性,利用GPT-4V来定量评估图像编辑对的质量。HQ-Edit中的高分辨率图像细节丰富,并配有详尽的编辑提示,这极大地提升了现有图像编辑模型的能力。例如,经过HQ-Edit微调的InstructPix2Pix能够达到最先进的图像编辑性能,甚至超越了使用人类标注数据进行微调的模型。

主要功能和特点:

- 大规模数据集: HQ-Edit包含大约200,000个编辑示例,这些示例是通过先进的基础模型(如GPT-4V和DALL-E 3)自动生成的。

- 高质量图像: 数据集中的图像分辨率高,细节丰富,并且与详细的文本提示相匹配。

- 精确对齐: 通过后处理确保文本指令与图像对之间的精确对齐。

- 新评估指标: 论文提出了两个新的评估指标“对齐”和“一致性”,用于定量评估图像编辑对的质量。

工作原理:

- 数据扩展: 首先,从网上收集多样化的图像描述和编辑指令,然后使用GPT-4模型将这些初始数据扩展到大约100,000个实例。

- 图像生成: 接着,使用GPT-4将这些数据转换成详细的提示,供DALL-E 3生成包含输入和输出图像的并置图像(diptychs)。

- 后处理: 生成的并置图像和提示经过后处理,以确保图像对之间的精确对齐,并改进文本指令的质量。

具体应用场景:

- 广告和摄影: HQ-Edit可以帮助设计师根据具体指令快速修改图片,创建符合要求的广告和摄影作品。

- 数字艺术和电影制作: 在数字艺术和电影制作中,HQ-Edit可以用来根据导演或艺术家的创意指令,生成或修改视觉元素。

- 社交媒体内容创作: 社交媒体内容创作者可以利用HQ-Edit训练的模型来编辑图片,增加吸引力和创意。

总的来说,HQ-Edit是一个强大的图像编辑数据集,它通过结合最新的文本和图像生成技术,为开发智能图像编辑工具提供了丰富的资源和评估标准。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...