就在德勤宣布与Anthropic达成一项重大企业合作协议的当天,一则负面消息同步曝光:该公司将为一份包含大量AI生成虚假信息的政府报告退还费用。

这一时间上的巧合,暴露出企业在大力拥抱AI的同时,仍面临技术可靠性与责任机制之间的深层挑战。

同一天,两件事

周一,德勤高调宣布计划在其全球近50万名员工中部署Anthropic开发的AI聊天机器人 Claude。双方表示,将联合为金融服务、医疗保健和公共部门等受监管行业开发合规的AI工具和应用场景。德勤还计划创建针对不同职能角色(如会计师、开发者)的定制化AI代理。

然而就在同一天,《金融时报》报道,澳大利亚就业与职场关系部确认,德勤必须退还其一项政府合同的最终付款——原因是其所提交的“独立保证审查”报告中存在多处事实性错误。

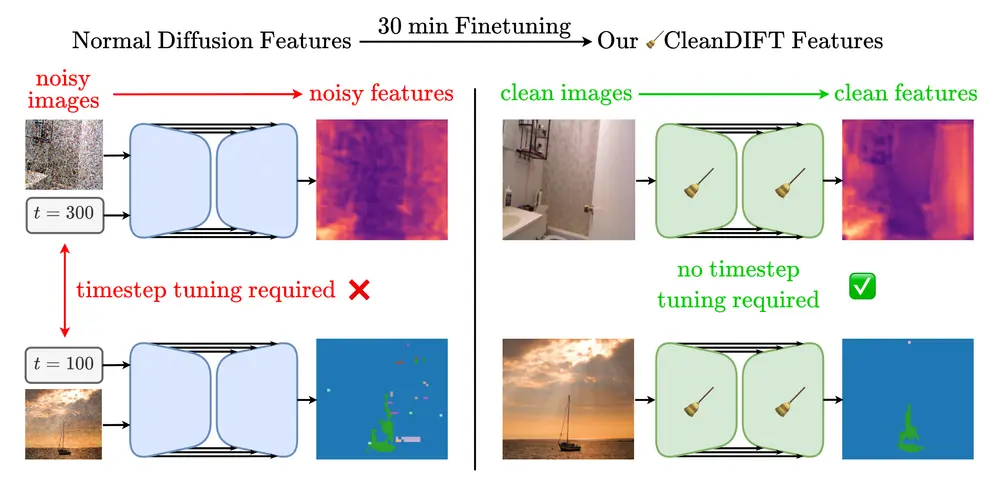

这份价值43.9万澳元的报告于今年早些时候发布,旨在评估澳大利亚劳动力市场的政策执行情况。但《澳大利亚金融评论》8月指出,报告中引用了多篇并不存在的学术研究,部分内容明显属于AI“幻觉”(hallucination)。修正版本已于上周发布,原始报告已被撤回。

德勤已同意偿还合同尾款,但未公开承认错误直接由AI导致。不过外界普遍认为,该事件是AI在专业服务领域应用失控的一个典型案例。

押注AI:战略推进与现实风险并存

尽管出现失误,德勤仍在持续推进其AI转型战略。此次与Anthropic的合作被描述为“重塑未来十年企业运营方式”的关键一步。德勤全球技术负责人Ranjit Bawa称:“我们与Anthropic在负责任AI方面的理念高度一致,Claude已成为我们自身AI转型和客户项目中的首选模型。”

Anthropic也将此协议称为其迄今规模最大的企业级部署,但双方未披露具体财务条款。

值得注意的是,这并非德勤首次因AI使用问题引发争议,也非行业内孤例。

- 今年5月,《芝加哥太阳时报》承认其发布的夏季阅读书单部分由AI生成,其中多个书名系虚构;

- 亚马逊的AI办公助手 Q Business 在上线首年也被内部文件指出存在准确率不足的问题;

- Anthropic自身也曾陷入风波:其法律顾问在今年一起版权诉讼中提交了由Claude生成的虚假判例,随后公开道歉。

这些案例共同揭示了一个现实:即使是最具技术敏感度的企业和机构,在将AI用于正式产出时,依然难以完全规避错误风险。

行业警示:信任不能让位于效率

德勤的处境具有代表性。一方面,咨询公司需要通过引入AI提升响应速度和成本效益;另一方面,其核心价值建立在准确性与可信度之上。一旦AI输出失实,不仅损害客户信任,也可能影响公共决策。

目前,德勤尚未就本次退款事件是否涉及AI系统做出明确说明。TechCrunch已联系该公司寻求回应,截至发稿暂未获得回复。

但可以肯定的是,随着AI在法律、审计、政策研究等高风险领域的渗透加深,如何建立更严格的验证流程、责任归属机制和透明度标准,已成为所有企业和平台必须面对的核心课题。

相关文章