在构建交互式世界模型、神经游戏引擎和沉浸式 XR 应用的道路上,一个核心挑战始终存在:如何实时生成高质量、时间连贯的长视频流?

当前主流的自回归视频生成方法虽能产出单段短片,但在生成多分钟连续视频时,普遍存在严重的误差累积问题——每一帧的微小偏差都会被传递到下一帧,最终导致画面抖动、结构崩塌或语义漂移。

- 项目主页:https://kunhao-liu.github.io/Rolling_Forcing_Webpage

- GitHub:https://github.com/TencentARC/RollingForcing

为解决这一难题,南洋理工大学与腾讯 PCG ARK 实验室联合提出 Rolling Forcing,一种全新的自回归视频扩散框架。该方法通过引入滚动去噪窗口、注意力锚点机制与高效蒸馏训练策略,首次实现了在单 GPU 上以接近 16fps 的速度稳定生成长达数分钟的高保真视频流,且显著抑制了长期生成中的质量衰减。

问题本质:为什么长视频生成这么难?

传统的自回归视频生成模型遵循“逐帧预测”模式:

[帧0] → [帧1] → [帧2] → ... → [帧N]

每一步都依赖前一帧作为条件输入。这种链式结构带来了两个根本性缺陷:

- 误差累积(Error Accumulation)

前序帧中的噪声、失真或语义偏差会持续影响后续帧,形成“滚雪球效应”。 - 暴露偏差(Exposure Bias)

训练时使用真实历史帧,而推理时使用模型自产的历史帧,导致分布不一致。

现有方案如因果 Transformer 或滑动窗口架构,在缓解这些问题上收效有限,尤其难以支撑需要低延迟响应的实时交互场景。

Rolling Forcing 的三大核心技术

Rolling Forcing 并非简单改进去噪流程,而是重构了自回归生成的底层机制。其设计围绕三个关键创新展开:

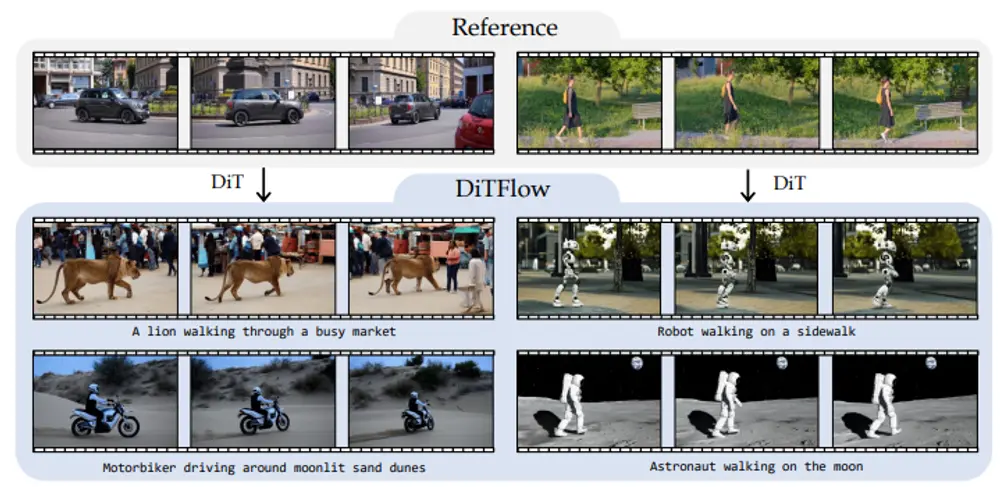

1. 联合去噪:打破严格因果性,实现帧间相互修正

传统方法要求每一帧只能看到过去的帧(严格因果),但这也限制了模型纠错能力。

Rolling Forcing 引入滚动去噪窗口(Rolling Denoising Window):

- 每次同时处理多个连续帧(例如 8 帧);

- 给这些帧分配渐进式噪声水平(从高到低);

- 在窗口内部允许双向注意力连接,使各帧可在去噪过程中相互参考、协同优化。

这相当于让一组帧“集体讨论”如何还原自己,而非孤立地依次恢复。

通过这种方式,系统能在早期阶段就纠正潜在错误,有效遏制误差传播。

2. 注意力锚点:用初始帧锁定全局一致性

长时间生成中最常见的问题是“主体漂移”或“背景变形”——角色逐渐走样,场景慢慢扭曲。

为此,Rolling Forcing 提出注意力锚点机制(Attention Anchors):

- 保留第一帧(或关键帧)的 Key 和 Value 状态;

- 在后续所有去噪步骤中,将这些状态作为全局上下文注入注意力层;

- 结合动态调整的旋转位置编码(RoPE),确保当前帧与锚点之间的相对时空关系始终保持正确。

这就像为整个视频序列设置了一个“记忆锚点”,无论生成多远,模型都能回溯到最初的语义与结构。

3. 高效训练:非重叠窗口蒸馏,减少暴露偏差

直接在自回归生成轨迹上训练,容易因暴露偏差而导致性能下降。

Rolling Forcing 采用少步蒸馏 + 非重叠窗口训练策略:

- 使用预训练的强模型(教师模型)对完整视频进行一次性去噪;

- 将结果切分为非重叠的时间窗口;

- 让学生模型在每个窗口内基于自生成历史完成去噪任务;

- 仅需少量去噪步即可收敛。

这种方法既模拟了推理时的自回归条件,又大幅降低了训练成本与显存占用。

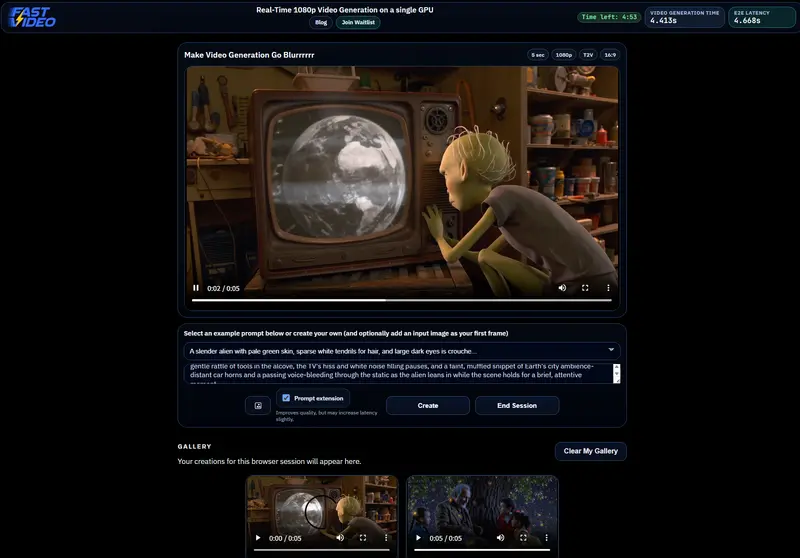

性能表现:快、稳、高质量

在标准测试集上的评估显示,Rolling Forcing 在多个维度超越现有方法:

| 指标 | Rolling Forcing | 其他自回归模型 |

|---|---|---|

| 推理速度(FPS) | 15.79 | <8 |

| 端到端延迟 | 0.76 秒 | >2 秒 |

| 视频长度支持 | 多分钟级 | 通常 ≤30 秒 |

| ∆Quality Drift(质量漂移) | 最低 | 显著上升 |

在权威视频生成评测基准 VBench 上,Rolling Forcing 在以下维度均取得最高分:

- 时间连贯性

- 主体一致性

- 背景稳定性

- 运动平滑度

- 成像质量与美学表现

这意味着它不仅能“撑得住”,还能“看得舒服”。

应用场景:迈向真正的交互式视觉生成

Rolling Forcing 的意义不仅在于延长生成时长,更在于推动生成模型从“离线创作工具”向“在线交互引擎”的转变。

典型适用场景包括:

✅ 神经游戏引擎

实时生成动态环境与角色行为,支持玩家自由探索未预设的世界。

✅ XR/VR 内容生成

根据用户视角与动作,即时渲染个性化虚拟场景,提升沉浸感。

✅ AI 导演与虚拟制片

辅助影视创作,快速生成分镜动画或背景扩展,降低制作门槛。

✅ 具身智能与机器人仿真

为 AI Agent 提供可交互的视觉环境,用于策略训练与决策验证。

相关文章