在人工智能伦理与国家安全的激烈碰撞中,硅谷两大巨头走向了截然不同的命运。

就在 Anthropic 因拒绝向美国国防部(DoD)让步其模型用于“自主武器”和“国内监控”而被列为“供应链风险”之际,OpenAI 宣布已与五角大楼达成重磅协议。该协议不仅允许 OpenAI 的模型部署在美军的机密网络中,更声称成功保留了其核心的道德安全原则。

OpenAI 的胜利:既入局,又守线

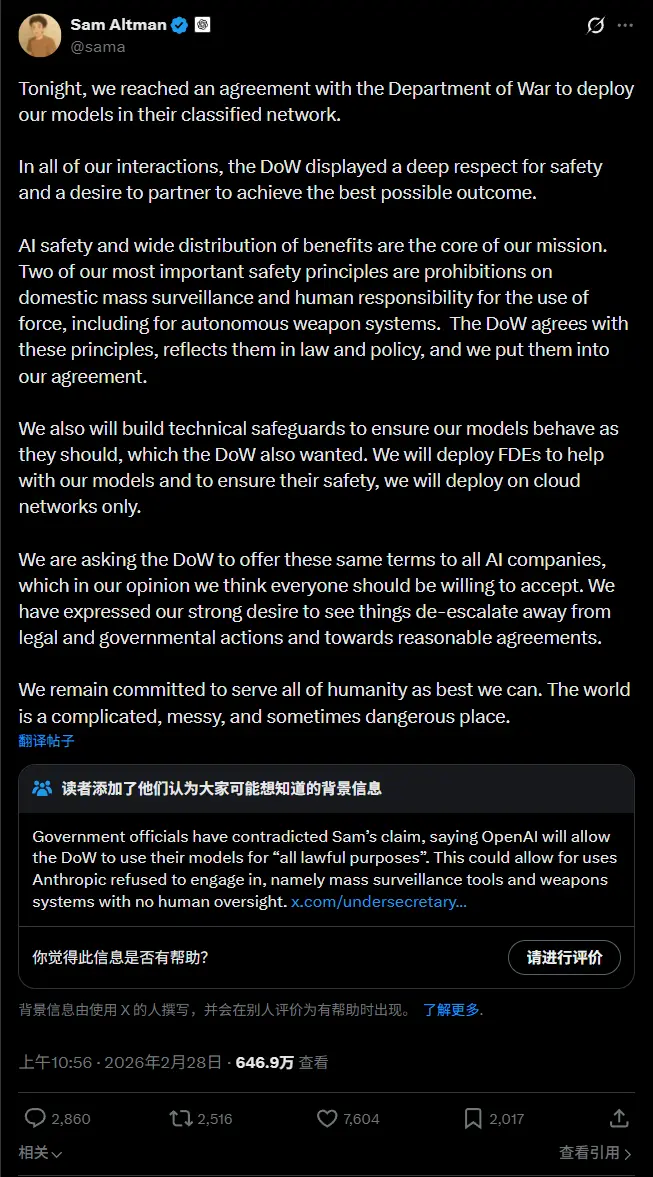

OpenAI CEO 山姆·阿尔特曼(Sam Altman)证实,公司已与国防部达成协议,将模型部署于机密网络。他在声明中强调,这并非无条件的妥协,而是一次“基于相互尊重”的合作:

“我们最重要的两个安全原则——禁止国内大规模监控以及在使用武力(包括自主武器系统)时保持人类负责——已被国防部同意,并反映在法律和政策中。”

协议核心亮点:

- 法律化而非口头承诺:安全原则不再仅仅是公司的服务条款(ToS),而是被写入具有法律约束力的合同和政策文件中。

- 技术保障措施:OpenAI 将部署现场工程师(On-site Engineers)协助美军操作,并建立技术护栏,确保模型按预期运行,防止滥用。

- 云原生部署:模型仅部署在安全的云网络上,确保数据隔离与访问控制。

- 呼吁行业统一:阿尔特曼表示,希望国防部向所有 AI 公司提供相同条款,并呼吁局势从“法律对抗”转向“合理协议”。

Anthropic 的困境:为何同样的原则却被拒?

既然 OpenAI 也坚持了“禁止自主武器”和“禁止国内监控”,为何 Anthropic 却遭到了如此严厉的打压,甚至被战争部长皮特·赫格塞斯(Pete Hegseth)指定为“供应链风险”?

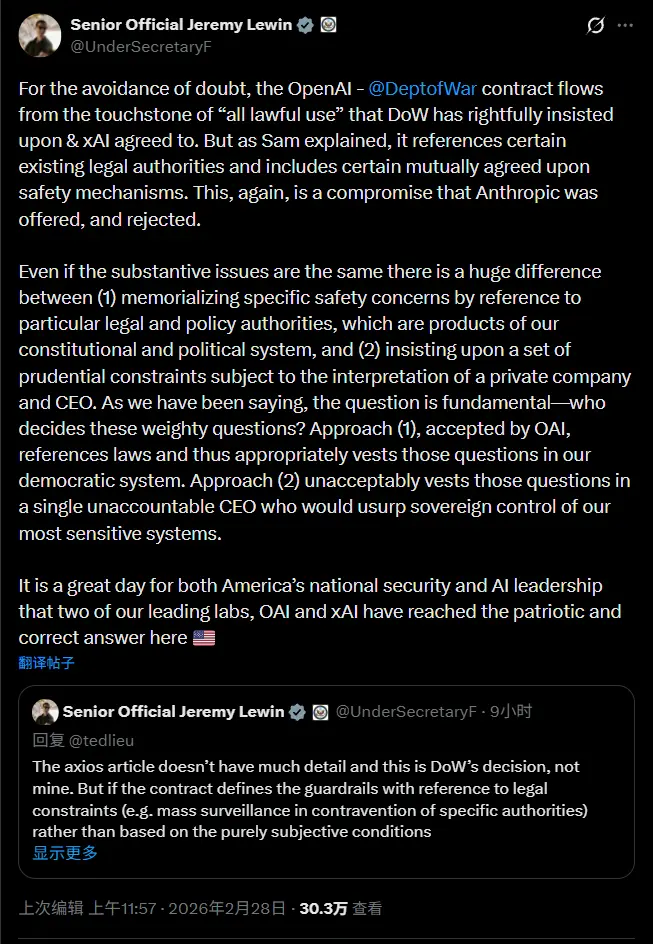

国防部高级官员杰里米·卢因(Jeremy Lewin)在 X 平台上给出了关键解释:问题的核心不在于“保护什么”,而在于“谁来决定”。

两种路径的根本差异:

| 特征 | OpenAI / xAI 方案 (被接受) | Anthropic 方案 (被拒绝) |

|---|---|---|

| 依据基础 | 引用现有法律与政策权威 | 依赖私营公司及其 CEO 的解释 |

| 决策主体 | 美国的民主体系与法律框架 | 单一、不负责任的 CEO |

| 主权归属 | 国家主权掌握在政府手中 | 被视为 CEO “篡夺”了对敏感系统的主权控制 |

| 灵活性 | 在法律框架内灵活执行“所有合法用途” | 设定了僵化的、由公司单方面定义的“红线” |

卢因指出:“OpenAI 的方法引用了特定的法律和政策权威,将这些重大问题的决定权适当地赋予我们的民主体系。而 Anthropic 的方法则不可接受地将决定权赋予一个单一的 CEO。”

简而言之,美国政府可以接受基于法律的限制(因为法律可以由立法机构修改或解释),但绝不能接受由私营企业单方面定义的、凌驾于国家意志之上的“道德否决权”。

Anthropic 的强硬回应

面对被贴上“供应链风险”标签(通常用于华为等中国实体)的羞辱,Anthropic 展现了前所未有的强硬姿态:

“无论国防部的任何恐吓或惩罚,都不会改变我们在大规模国内监控或完全自主武器上的立场。我们将在法庭上对任何供应链风险指定提出质疑。”

Anthropic 认为,国防部的做法为所有与美国政府谈判的美国公司树立了一个危险的先例,即政府可以因道德异议而惩罚承包商。

硅谷道德框架的瓦解与重构

这场对峙标志着硅谷长期以来的“自我监管”道德框架在国家安全机器面前的碰壁。

- OpenAI 的选择:通过拥抱法律框架,OpenAI 成功进入了利润丰厚的国防市场,同时试图在体制内通过技术手段(如现场工程师、技术护栏)来维持其道德底线。这是一种务实的融合主义。

- Anthropic 的坚持:试图保留一种超越国家法律的、普世的道德否决权。这是一种理想主义的对抗主义,但在当前地缘政治环境下显得格格不入。

- xAI 的站队:埃隆·马斯克的 xAI 已明确支持“所有合法用途”基准,进一步孤立了 Anthropic。

相关文章