这款基于节点的平台解锁了先进的、基于 AI 的创意工作流程,并通过预配置模板让新手轻松上手。

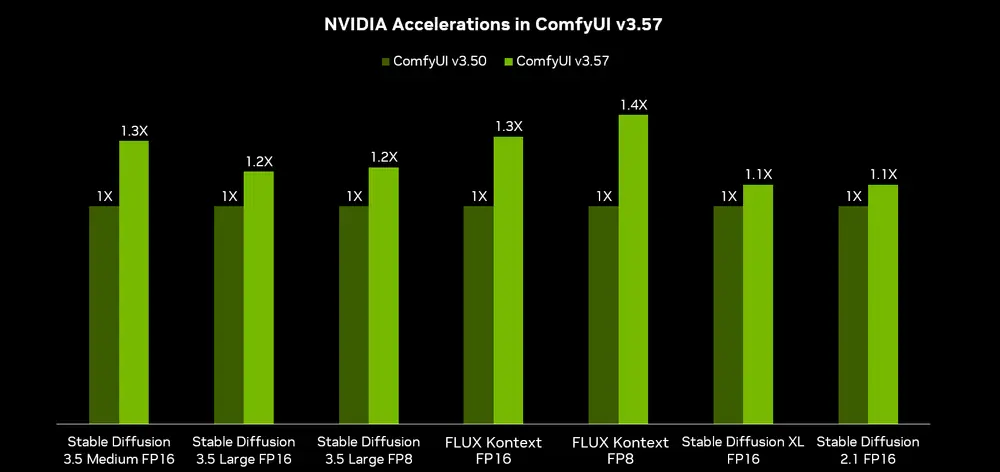

ComfyUI——一个开源的、基于节点的图形界面,用于运行和构建用于内容创作的生成式 AI 工作流程——在过去一个月发布了重大更新,包括为英伟达RTX显卡带来高达 40% 的性能提升,以及支持新的 AI 模型,如 Wan 2.2、Qwen-Image、FLUX.1 Krea [dev] 和 Hunyuan3D 2.1。

英伟达还发布了热门扩散模型(如 Stable Diffusion 3.5 和 FLUX.1 Kontext)的英伟达TensorRT 优化版本,作为 NVIDIA NIM 微服务,使用户能在 ComfyUI 中以最高快 3 倍的速度和减少 50% 的显存占用运行这些模型。

此外,NVIDIA RTX Remix(一个让模组制作者重制经典游戏的平台)的更新于今日发布,新增了一个先进的光线追踪粒子系统,可提供令人惊叹的视觉效果,为经典游戏注入新生。

ComfyUI v3.57 借助 RTX 获得性能提升

英伟达已与 ComfyUI 合作,将 AI 模型性能提升高达 40%。作为对比,GPU 世代升级通常仅带来 20-30% 的性能提升。

有兴趣优化其应用程序中扩散模型性能和效率的开发人员,可以在开发者论坛中阅读有关 NVIDIA 如何帮助加速这些工作负载的更多信息。

由 RTX 加速的尖端 AI 模型

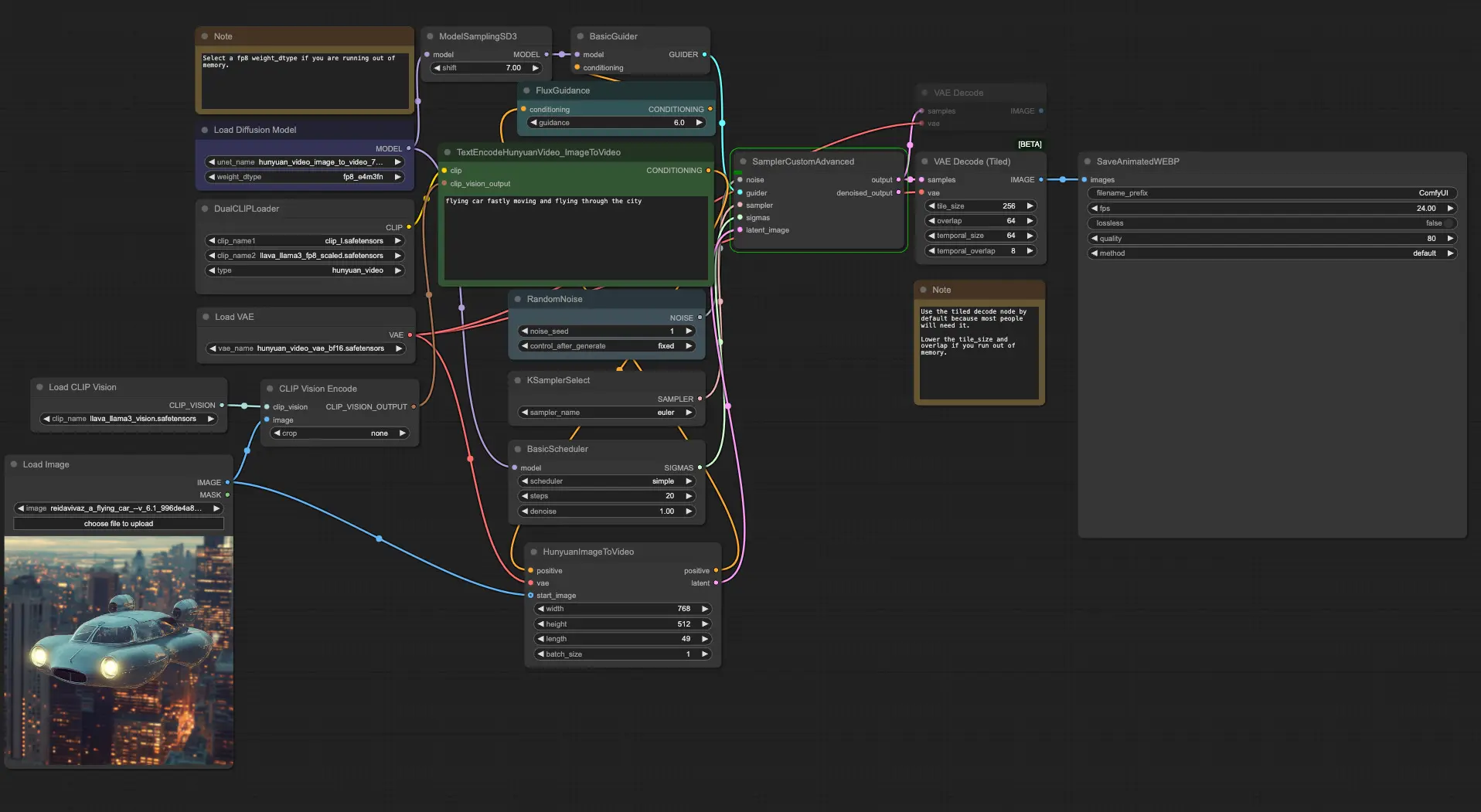

过去几周发布了一些用于 AI 内容创作的卓越模型,所有这些模型现已在 ComfyUI 中可用。

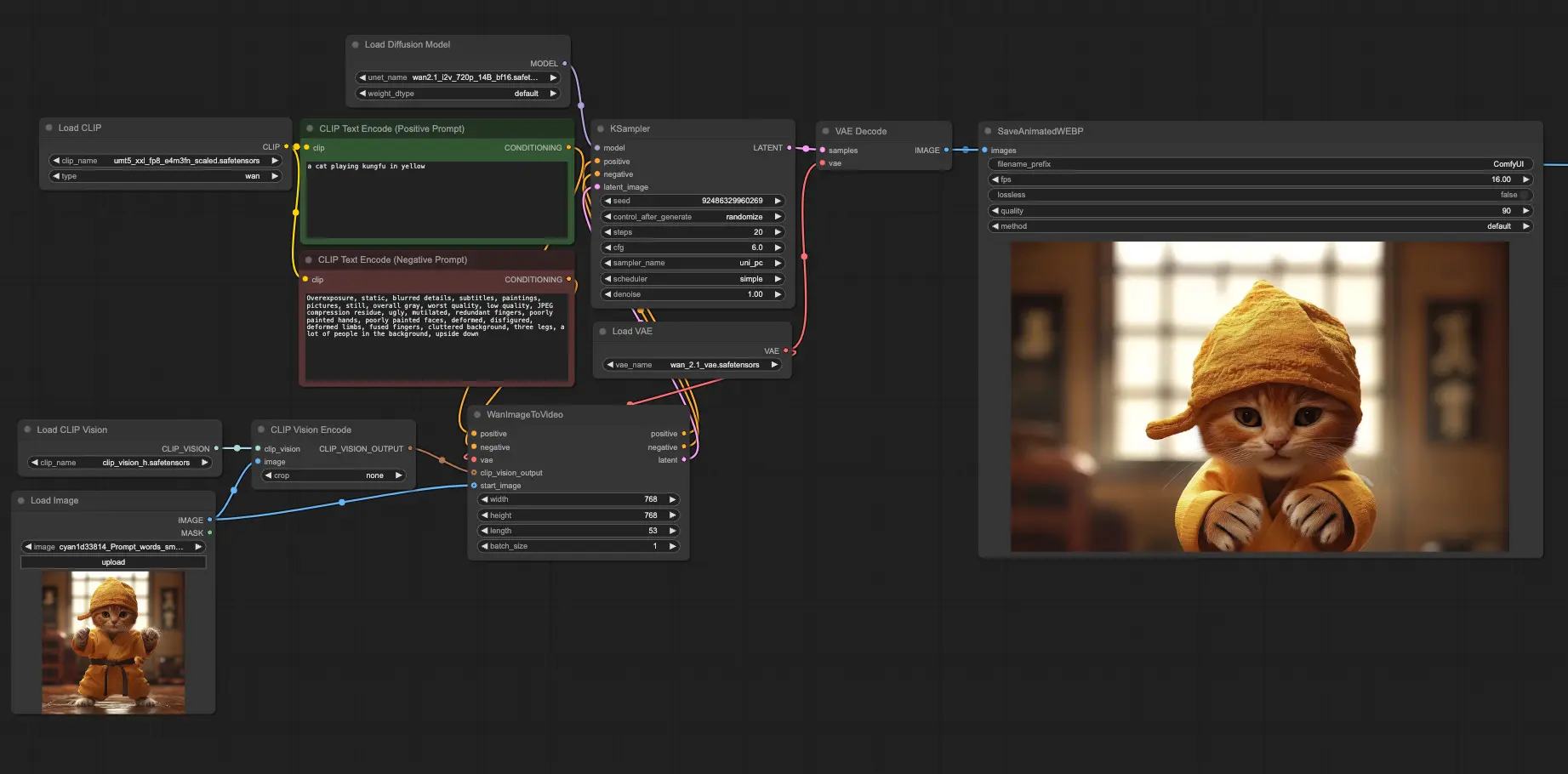

Wan 2.2 是一个新的视频模型,为 PC 上的视频生成提供了出色的质量和控制。它是来自 Wan AI(一个提供包括文生图、文生视频、图生视频和语音生视频在内的强大 AI 模型阵容的创意 AI 平台)的最新模型。GeForce RTX 和 NVIDIA RTX PRO显卡是唯一能够在 ComfyUI 中运行 Wan 2.2 14B 模型而不会导致输出严重延迟的显卡。查看下方使用单一提示词创建的示例:“一个机器人正在打鸡蛋,但不小心打到了碗外面。”

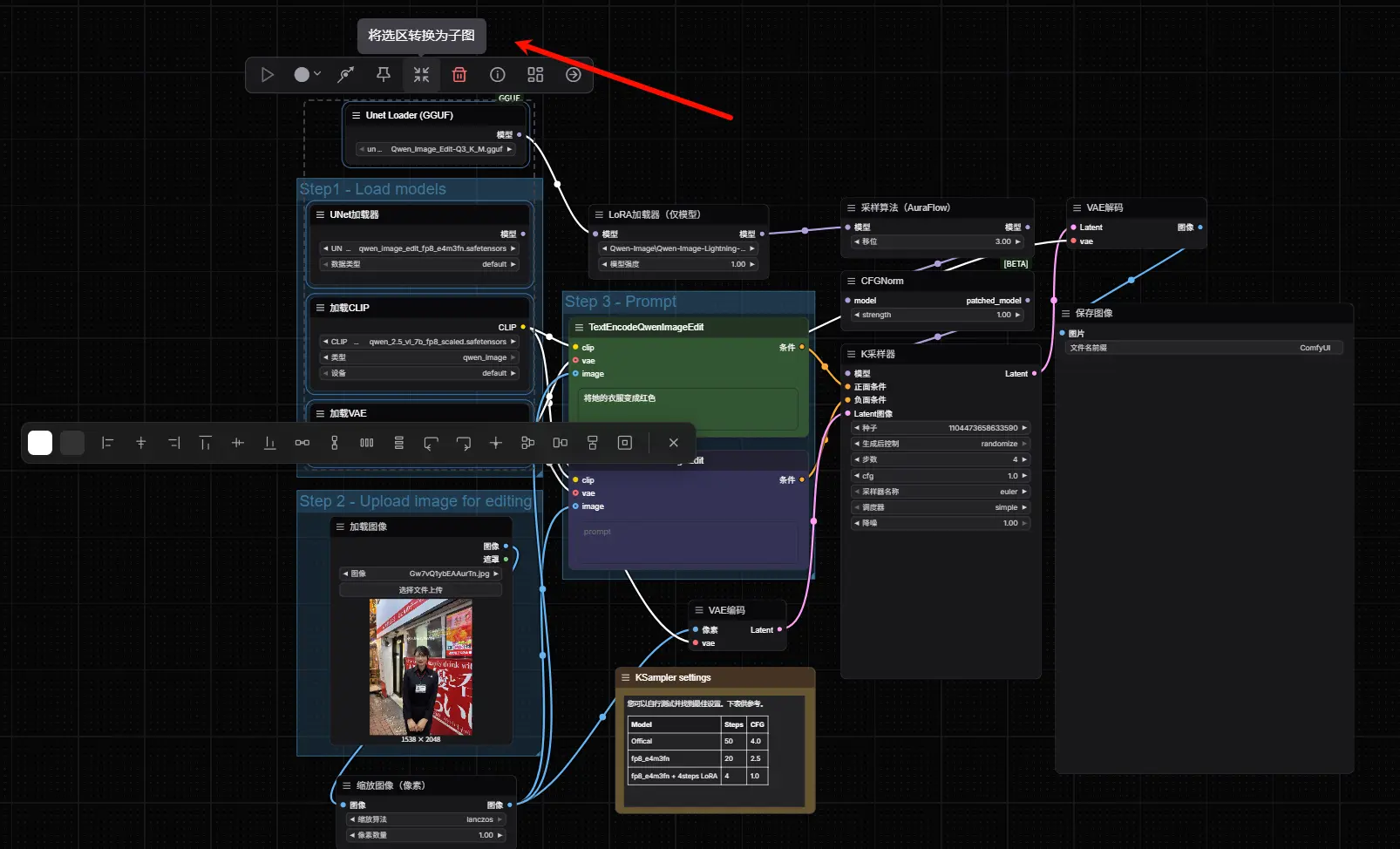

Qwen-Image 是阿里巴巴推出的一个新的图像生成基础模型,在复杂文本渲染和精确图像编辑方面取得了显著进步。它擅长渲染复杂文本、处理精细编辑,并在生成的图像中保持语义和视觉的准确性。该模型在 GeForce RTX 5090 上的运行速度比 Apple M3 Ultra 快 7 倍。

Black Forest Labs 的新 FLUX.1 Krea [dev] AI 模型是 Krea 1 的开源权重版本,提供强大的性能,并经过训练可生成更真实、更多样化且不包含过度饱和纹理的图像。Black Forest Labs 称该模型为“有主见的”,因为它能提供各种各样、视觉上引人入胜的图像。该模型在 GeForce RTX 5090 上的运行速度比 Apple M3 Ultra 快 8 倍。

Hunyuan3D 2.1 是一个完全开源、可用于生产的 3D 生成系统,可将输入图像或文本转换为富含基于物理渲染材质的高保真 3D 资源。其核心组件包括一个用于形状生成的 33 亿参数模型和一个用于纹理分析的 20 亿参数模型,以快速生成更真实的材质。所有这些在 Blackwell RTX GPU 上运行速度更快。

开启高级视觉生成技术之旅

视觉生成式 AI 是一个强大的工具,但即使对技术专家来说,入门也可能很困难,并且学习使用更先进的技术通常需要数月时间。

ComfyUI 通过提供模板或预设节点(用于完成特定任务,如在不同的生成中保持角色一致、调整图像光线或加载微调模型)让高级工作流程的入门变得简单。这使得即使是非技术背景的艺术家也能轻松使用先进的 AI 工作流程。

以下是开始使用生成式 AI 的 10 项关键技术:

- 通过定义起始帧和结束帧来引导视频生成:上传起始帧和结束帧,以及视频片段应如何开始和结束。Wan 2.2 随后可以生成平滑的动画过渡,填充中间帧以创建连贯的动画。这非常适合制作动画、场景转换或定义姿势。

- 使用自然语言编辑图像:使用 FLUX.1 [dev] KONTEXT 编辑图像的特定文本部分。

- 放大图像或视频:获取较低分辨率的图像或视频,并通过添加逼真的高频细节来提高其分辨率和细节质量。

- 控制区域构图:通过控制图像特定区域内视觉元素的排列和布局,实现对图像生成的更精细控制。

- 重塑图像风格:使用 FLUX Redux 创建图像的不同变体,同时保留核心视觉元素和细节。

- 利用图像到多视图到 3D 模型:使用从不同角度捕获的物体多个图像来创建高保真、带纹理的 3D 模型。

- 将声音转换为视频:直接从音频输入(如语音、音乐或环境声音)创建视频剪辑或动画。

- 控制视频轨迹:自动引导视频中物体、摄像机或场景的运动。

- 使用修复编辑图像:以视觉上无缝、与周围区域上下文一致的方式填充或更改数字图像中缺失或不想要的部分。

- 通过外部绘制扩展画布:生成新的图像内容以扩展现有图像或视频素材的边界,为裁剪部分添加细节或完成场景。

扩展您的 ComfyUI 领域

ComfyUI 插件使用户能够将生成式 AI 工作流程添加到他们现有的应用程序中。ComfyUI 社区已开始为一些顶级热门创意应用程序构建插件。

Adobe Photoshop 插件通过允许用户运行自己的流程并为特定任务选择专用模型,对 Photoshop 原生的 Firefly 模型进行了补充。本地推理还支持低延迟的无限生成式填充。

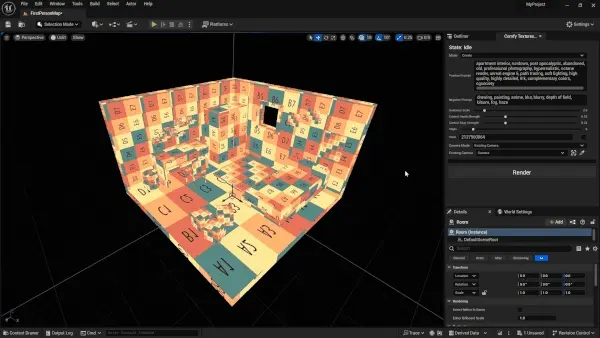

Blender 插件(在 NVIDIA 3D 引导生成式 AI 蓝图中有所介绍)允许用户连接 2D 和 3D 工作流程。艺术家可以使用 3D 场景来控制图像生成,或在 ComfyUI 中创建纹理并将其应用到独立的 3D 资源上。

Foundry Nuke 插件与 Blender 插件类似,实现了 2D 和 3D 工作流程之间的连接,因此用户无需在应用程序之间切换(alt-tab)。

Unreal Engine 插件直接在 Unreal Engine 用户界面中启用 ComfyUI 节点,以使用生成式扩散模型快速创建和优化场景纹理。

在 ComfyUI 中为英伟达RTX显卡运行超优化模型

使用英伟达RTX显卡的最佳方式是配合 TensorRT 库——一个高性能深度学习推理引擎,旨在从 英伟达RTX显卡 的 Tensor Core 中榨取最大速度。

英伟达已与顶级 AI 实验室合作,将 TensorRT 集成到他们的模型中,例如 Black Forest Labs 的模型和 Stability AI 的模型。这些模型也提供量化版本——一种压缩版的网络,使用减少 50-70% 的显存,并提供高达 2 倍的推理加速,同时保持相似的质量。

通过 TensorRT 节点,可以在 ComfyUI 中直接运行 TensorRT 优化模型,该节点目前支持 SDXL、SD3 和 SD3.5,以及 FLUX.1-dev 和 FLUX.1-schnell 模型。该节点将 AI 模型转换为 TensorRT 优化模型,然后为用户显卡生成 TensorRT 优化引擎——这是一张如何为其特定硬件以最佳效率执行该模型的路线图——从而提供显著的加速效果。

然而,量化模型需要更多的工作。对于有兴趣运行量化和 TensorRT 优化模型的用户,英伟达在一个名为 NIM 微服务的简单容器中提供预配置文件。用户可以使用 ComfyUI 中的 NIM 节点加载这些容器,并使用量化版本的模型,如 FLUX.1-dev、FLUX.1-schnell、FLUX.1 Kontext、SD3.5 Large 和 Microsoft TRELLIS。

Remix 更新增加光线追踪粒子系统

今日通过 NVIDIA 应用发布了一个新的 RTX Remix 更新,增加了一个先进的粒子系统,使模组制作者能够增强传统的火焰和烟雾效果,以及更奇幻的效果,如电子游戏《Portal》中的效果。

借助 RTX Remix,经典游戏中的传统粒子可以被解释为经过光线追踪的,使它们能够投射逼真的光线以增强许多场景的外观。但最终,这些粒子仍然有超过 20 年的历史,缺乏细节、风格和流畅的动画。

RTX Remix 的新粒子具有物理精确的属性,并可以与游戏中的灯光和其他效果互动。这使得粒子能够碰撞、响应风力和其他力而准确移动、在表面上反射、投射阴影并分配自己的阴影。

相关文章