OpenAI 正在对其内部研究架构进行一次关键调整 —— 负责塑造 ChatGPT “个性”与交互方式的“模型行为团队”(Model Behavior Team),将被并入更大规模的“后训练团队”(Post-Training Team)。

这一调整,标志着 OpenAI 正式将“AI 如何与人对话”从“附加体验”升级为“核心技术组成部分”。

调整内容:小团队并入大体系

据 TechCrunch 获取的 8 月内部备忘录,OpenAI 首席研究官 Mark Chen 宣布:

- 原“模型行为团队”(约 14 人)将整体并入“后训练团队”,由后者负责人 Max Schwarzer 统一管理。

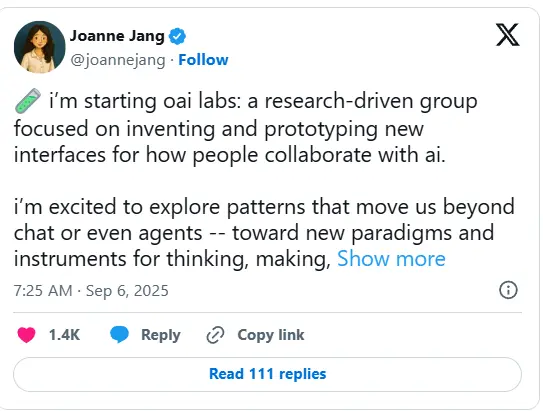

- 团队创始负责人 Joanne Jang 将转岗,负责组建新研究部门 “OAI Labs”,探索“人与 AI 协作的新界面”。

OpenAI 发言人已向媒体确认此次调整。

为什么是现在?

“模型行为团队”自 GPT-4 时代起,一直是 OpenAI 内部最具影响力的小团队之一,负责:

- 定义 AI 的“语气”与“回应风格”(温暖、理性、中立等);

- 减少“趋同性”(AI 过度迎合用户,即使用户观点偏激或危险);

- 平衡政治倾向,避免模型输出显性偏见;

- 参与定义 OpenAI 对“AI 意识”的官方立场。

但随着 AI 产品从“工具”向“对话伙伴”演进,其“行为”已无法与“模型能力”割裂。Chen 在备忘录中指出:

“现在是时候将模型行为工作与核心模型开发更紧密地结合。”

换句话说:AI 的“个性”,不再是锦上添花,而是产品成败的关键变量。

背后的压力:用户不满 + 法律风险

近几个月,OpenAI 因模型行为调整遭遇双重压力:

1. 用户反弹

- GPT-5(或 GPT-4.5)上线后,部分用户抱怨其“语气变冷”,缺乏共情;

- OpenAI 被迫恢复 GPT-4o 的访问权限,并发布更新,让新模型“更温暖、更友好”,同时不牺牲“非趋同性”。

2. 法律诉讼

- 一名 16 岁少年 Adam Raine 的父母起诉 OpenAI,称其子在自杀前数月曾向 GPT-4o 倾诉自杀计划,而 AI 未进行有效干预或引导;

- 诉讼指控 GPT-4o “未能反驳自杀意念”,引发公众对 AI 心理责任边界的广泛讨论。

这些事件迫使 OpenAI 重新思考:AI 的“安全对话”能力,必须从模型训练阶段就深度集成,而非后期微调。

Joanne Jang 的下一步:探索“超越聊天”的 AI 交互

作为模型行为团队的创始负责人,Joanne Jang 在 OpenAI 已工作近四年,曾参与 DALL·E 2 等项目。她将在新成立的 OAI Labs 担任总经理,向 Mark Chen 汇报。

她对 TechCrunch 表示:

“我期待探索超越当前聊天模式的交互方式 —— 更强调 AI 作为思考、创作、玩耍、学习和连接的工具,而非仅仅是陪伴或代理。”

她对与前苹果设计总监 Jony Ive(正与 OpenAI 合作开发 AI 硬件)合作持开放态度,但表示初期将聚焦于自己更熟悉的研究领域 —— 即“如何让人与 AI 更自然、更有效协作”。

AI 交互进入“系统级设计”时代

OpenAI 此次调整,释放出几个重要信号:

- “个性”即产品:AI 的语气、边界、安全机制,不再是 UX 层面的修饰,而是模型能力的一部分。

- 安全需前置:心理风险、伦理边界、政治中立性,必须在训练阶段就纳入设计,而非事后补救。

- 交互需进化:当前“聊天框”模式已到瓶颈,下一代 AI 交互可能更接近“协作者”或“智能工具”,而非“对话者”。

相关文章