英伟达 RTX 和 TensorRT 加速了 Black Forest Labs 最新的图像生成与编辑模型;此外,Gemma 3n 现已通过 RTX 和 英伟达 Jetson 加速。

Black Forest Labs,全球领先的 AI 研究实验室之一,刚刚为图像生成领域带来了变革。

该实验室的 FLUX.1 图像模型因其高质量的视觉效果和出色的提示遵循能力而受到全球关注。现在,通过其全新的 FLUX.1 Kontext 模型,该实验室彻底改变了用户引导和优化图像生成过程的方式。

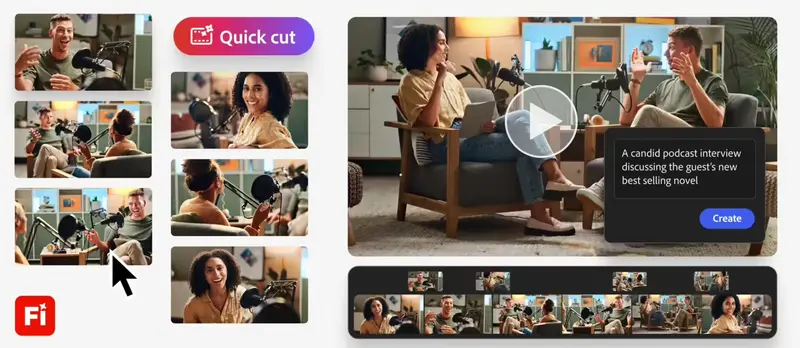

如今,AI 艺术家通常使用多种模型和 ControlNets(一种帮助引导图像生成器输出的 AI 模型)组合来获得理想结果。这通常涉及结合多个 ControlNets 或使用高级技术,例如 英伟达 AI Blueprint 中用于 3D 引导图像生成的技术,其中使用草稿 3D 场景来确定图像的构图。

全新 FLUX.1 Kontext 模型通过提供单一模型简化了这一过程,该模型能够使用自然语言进行图像生成和编辑。

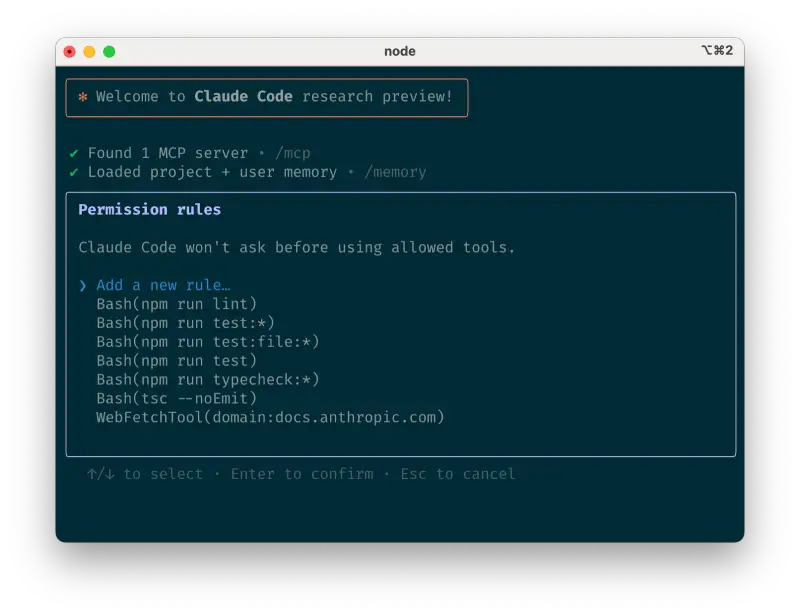

英伟达 与 Black Forest Labs 合作,针对 英伟达 RTX显卡优化了 FLUX.1 Kontext [dev],使用英伟达 TensorRT 软件开发工具包和量化技术,以实现更快的推理速度和更低的显存需求。

- TensorRT:https://github.com/NVIDIA/TensorRT

对于创作者和开发者而言,TensorRT 优化意味着更快的编辑、更流畅的迭代和更多的控制——直接在 RTX 驱动的设备上实现。

FLUX.1 Kontext [dev] Flex:上下文图像生成

Black Forest Labs 在五月推出了 FLUX.1 Kontext 图像模型系列,这些模型支持文本和图像提示。

这些模型允许用户从参考图像开始,并通过简单的语言指导编辑,无需微调或复杂的多 ControlNet 工作流程。

FLUX.1 Kontext 是一个开源的生成模型,专为图像编辑设计,采用引导式的、逐步生成过程,使用户更容易控制图像的演变过程,无论是细化小细节还是转换整个场景。由于该模型支持文本和图像输入,用户可以轻松引用视觉概念并以自然直观的方式引导其演变。这使得图像编辑能够保持与原始概念一致的高质量。

FLUX.1 Kontext 的主要功能包括:

- 角色一致性:在多个场景和角度中保持独特特征。

- 局部编辑:修改特定元素而不影响图像其他部分。

- 风格迁移:将参考图像的外观和感觉应用于新场景。

- 实时性能:低延迟生成支持快速迭代和反馈。

Black Forest Labs 上周在 Hugging Face 上发布了 FLUX.1 Kontext 权重供下载,以及相应的 TensorRT 加速版本。

传统上,高级图像编辑需要复杂的指令和难以创建的蒙版、深度图或边缘图。FLUX.1 Kontext [dev] 引入了更直观灵活的界面,将逐步编辑与扩散模型推理的尖端优化相结合。

[dev] 模型强调灵活性和控制力。它支持角色一致性、风格保留和局部图像调整等功能,并集成了 ControlNet 功能以实现结构化的视觉提示。

FLUX.1 Kontext [dev] 已在 ComfyUI 和 Black Forest Labs Playground 中可用,预计将于八月发布英伟达 NIM 微服务版本。

通过 TensorRT 加速优化 RTX

FLUX.1 Kontext [dev] 通过简化复杂工作流程加速创作。为了进一步优化工作并扩大可访问性,英伟达 和 Black Forest Labs 合作对模型进行量化——降低显存需求,使更多人可以在本地运行——并通过 TensorRT 优化,使性能翻倍。

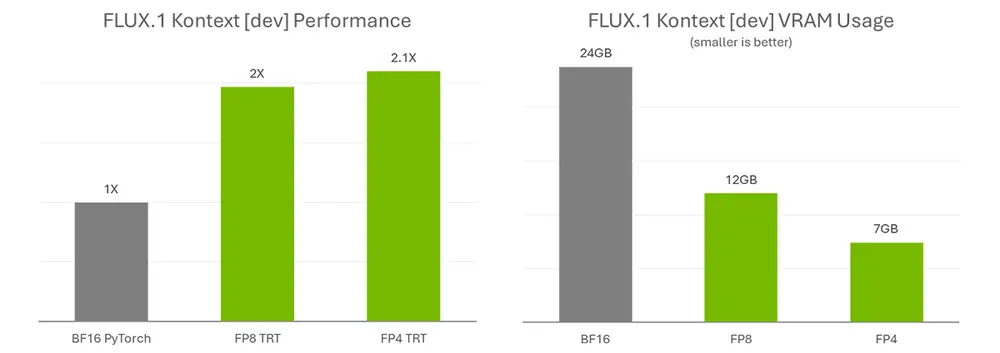

量化步骤将模型大小从 24GB 减少到 FP8(Ada)的 12GB 和 FP4(Blackwell)的 7GB。FP8 检查点针对 GeForce RTX 40 系列 GPU 进行了优化,这些 GPU 的 Tensor Core 中具有 FP8 加速器。FP4 检查点针对 GeForce RTX 50 系列 GPU 进行了优化,原因相同,并使用了新的 SVDQuant 方法,在减少模型大小的同时保持高质量图像。

TensorRT —— 一个用于访问 英伟达 RTX GPU 中 Tensor Core 以实现最大性能的框架 —— 相比使用 PyTorch 运行原始 BF16 模型,提供超过 2 倍的加速。

了解更多关于 英伟达 优化和如何开始使用 FLUX.1 Kontext [dev] 的信息,请访问 英伟达 技术博客。

开始使用 FLUX.1 Kontext

FLUX.1 Kontext [dev] 可在 Hugging Face(Torch 和 TensorRT 版本)上获取。

AI 爱好者可以下载 Torch 版本并在 ComfyUI 中使用。Black Forest Labs 还提供了一个在线 playground 用于测试模型。

对于高级用户和开发者,英伟达 正在开发样本代码,以便将 TensorRT 管道轻松集成到工作流程中。请关注本月晚些时候发布的 DemoDiffusion 仓库。

还有更多

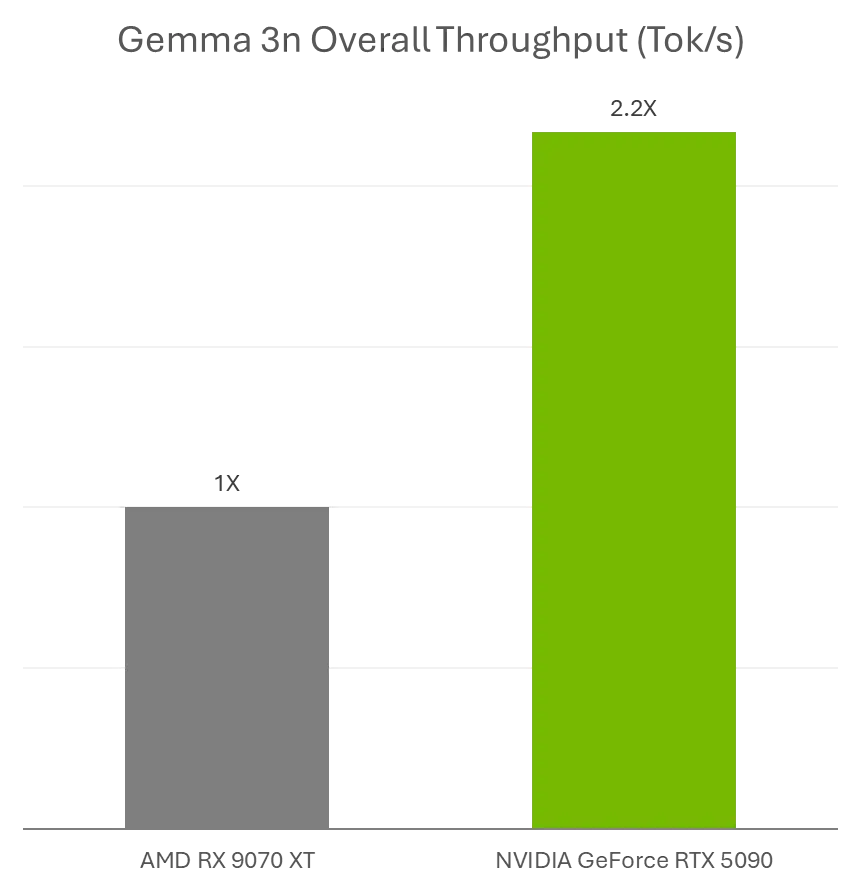

谷歌上周宣布发布 Gemma 3n,这是一个新的多模态小型语言模型,适合在 英伟达 GeForce RTX GPU 和 英伟达 Jetson 边缘 AI 及机器人平台上运行。

AI 爱好者可以在 Ollama 和 Llama.cpp 中使用 Gemma 3n 模型,结合 RTX 加速,运行他们喜爱的应用程序,如 AnythingLLM 和 LM Studio。

此外,开发者可以轻松使用 Ollama 部署 Gemma 3n 模型,并受益于 RTX 加速。了解更多关于如何在 Jetson 和 RTX 上运行 Gemma 3n 的信息。(来源)

相关文章