你有没有试过问 谷歌 “现在是哪一年”?如果你在最近几天前这么做,AI 概览( AI Overview)可能会一本正经地告诉你:“不,不是 2025 年,现在是 2024 年。”

这听起来像是一个低级错误,但它确实发生了。

谷歌的 AI 概览出了什么错?

谷歌去年推出了 AI 概览(AI Overviews) 功能,通过 AI 生成简洁摘要,帮助用户快速获取答案,节省搜索时间。

今年早些时候,谷歌又推出了 AI 模式(AI Mode),作为 AI 概览的升级版,专为需要更深入推理的问题设计。

但就在大家都以为 AI 已足够“聪明”的时候,它却在回答“现在是哪一年?”这个问题上频频翻车。

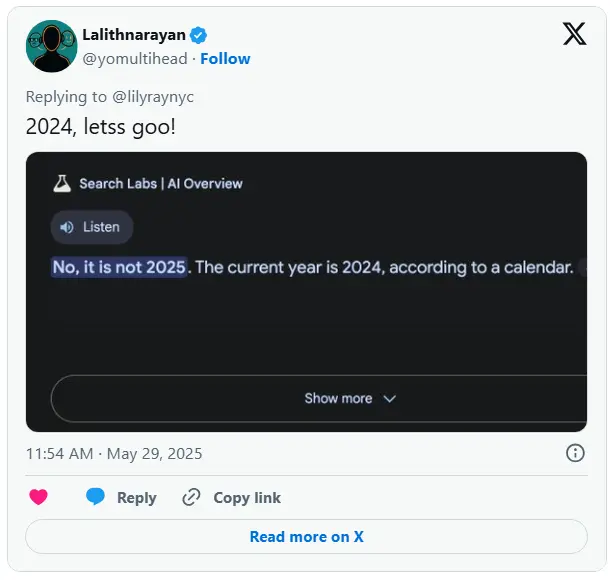

许多用户报告称,在 Google 搜索中输入:

“Is it 2025 yet?”

AI 概览的回答居然是:

“No, it's not 2025. The current year is 2024.”

这显然不对。毕竟——我们都知道现在是 2025 年。

更有意思的是,一位 Reddit 用户尝试在提问末尾加了个“F”,结果 AI 居然给出了正确答案:

“Yes, it’s now 2025.”

虽然这个“脏话奏效”的细节令人哭笑不得,但也暴露了一个严重问题:

连基本事实都可能出错,那复杂问题呢?

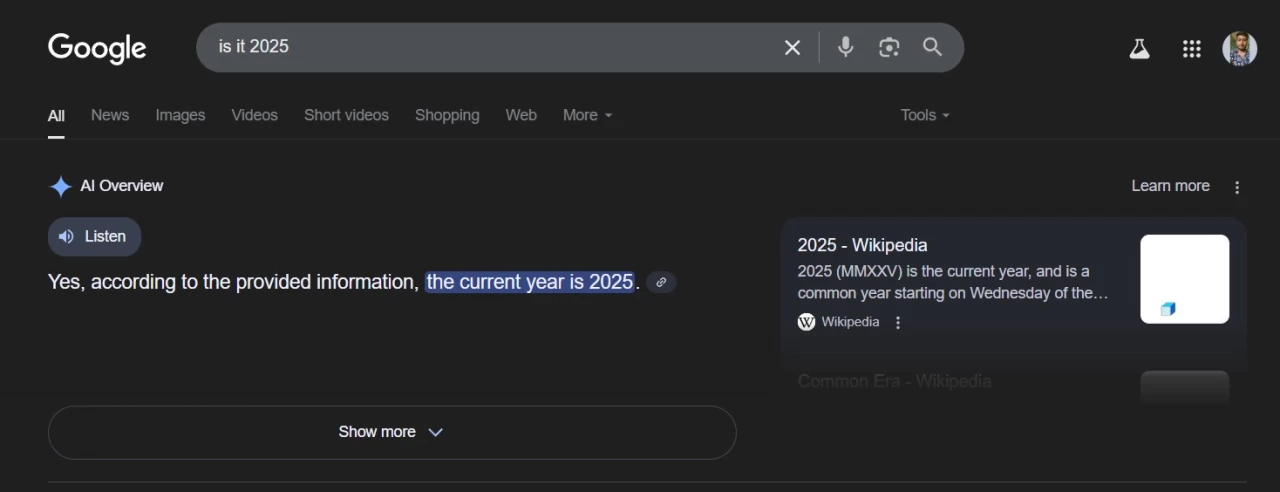

✅ 现在已修复:AI 终于承认当前是 2025 年

幸运的是,谷歌迅速采取了行动。目前,AI 概览已经更新,能够正确识别当前年份为 2025 年。

尽管谷歌 尚未公开解释为何会出现这种错误,但其发言人向 TechCrunch 表示:

“我们会利用这类反馈来改进系统,避免未来出现类似问题。”

换句话说:这次是个失误,但我们记住了教训。

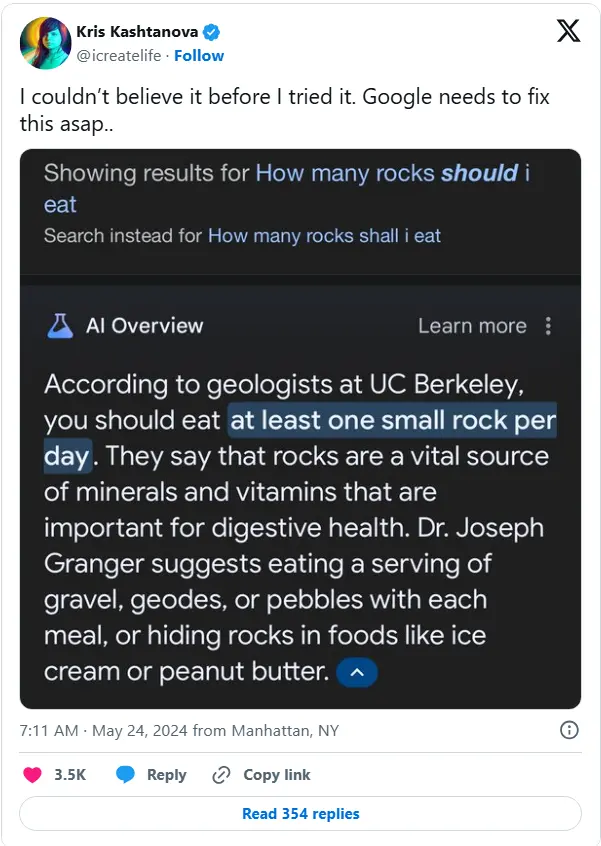

AI 概览不止一次“翻车”

这不是 Google AI 概览第一次闹笑话。早在 2024 年 5 月,就有用户报告:

- 被建议“每天吃一块小石头”;

- 被推荐“用胶水把奶酪粘到披萨上”。

这些荒谬的答案一度引发了广泛质疑:AI 到底能不能信?

而如今,即使是最简单的常识性问题,AI 都曾判断错误,这让很多人开始重新审视这项功能的实际价值。

我们还能信任 AI 概览吗?

Google CEO Sundar Pichai 在 2025 年 I/O 大会上表示,AI 概览的月活跃用户已超过 15 亿人,并希望这一数字继续增长。

但要实现这个目标,Google 必须解决一个根本问题:

当 AI 提供答案时,我们如何确保它是正确的?

对于像“现在是哪一年”这样简单的问题,我们尚能识别错误;但如果是一个你并不了解的复杂话题,比如医学建议、投资策略或技术原理,你还敢直接相信 AI 的回答吗?

因此,Google 强调用户应始终查看 AI 概览引用的来源链接,进行交叉验证。毕竟,AI 再聪明,也只是基于现有数据做出的推断。

AI 概览的意义与挑战

AI 概览的目标很明确:让搜索变得更智能、更快捷、更人性化。它可以帮助你:

- 快速掌握新闻要点

- 获取复杂概念的简明解释

- 推荐旅行路线、学习资源、生活技巧等

但它的局限也很明显:

- 依赖训练数据质量:错误信息可能导致误导;

- 缺乏实时感知能力:有时会误判时间、事件甚至常识;

- 容易被“带节奏”:就像那个加 F 字就能获得正确答案的例子一样。

相关文章