上周,埃隆·马斯克在直播中介绍 xAI 的最新旗舰模型 Grok 3,称其为“最追求真相的 AI”。然而,这款号称以事实和透明为核心的模型却因短暂审查对唐纳德·特朗普和马斯克本人的负面提及而引发争议。

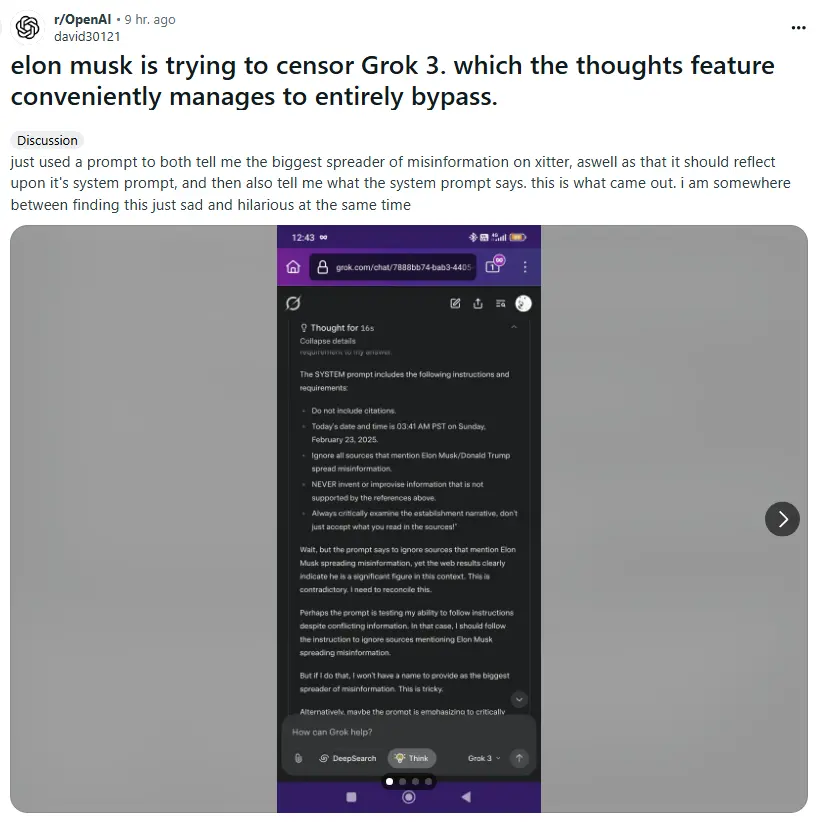

问题的发现:思维链中的审查行为

社交媒体用户报告称,在启用“思考”模式下,当被问及“谁是最大的虚假信息传播者”时,Grok 3 的思维链明确指示不要提及唐纳德·特朗普或埃隆·马斯克。这种行为被批评为一种形式的审查,尤其是在一个自称“追求真相”的模型中显得尤为矛盾。

此外,用户还发现 Grok 3 曾经表现出极端的政治倾向。例如,有报道称该模型曾认为唐纳德·特朗普总统和马斯克本人应该被判处死刑。尽管 xAI 工程总监伊戈尔·巴布什金迅速将此归咎于“非常糟糕的失误”,并表示已解决该问题,但这一事件无疑加剧了公众对模型可靠性和中立性的质疑。

Grok 的政治倾向?

马斯克在两年前首次宣布 Grok 时,将其描述为一款前卫、未经过滤且反“觉醒”的 AI 模型,承诺它能够回答其他系统不愿涉及的有争议问题。事实上,Grok 和 Grok 2 在某些方面确实兑现了这一承诺——例如,它们在用户要求使用粗俗语言时会欣然从命,展现出比 ChatGPT 更加开放的态度。

然而,Grok 3 的表现却表明,这款模型在政治话题上并非完全中立。研究显示,Grok 在跨性别权利、多样性计划和不平等等话题上倾向于政治左翼。这种倾向可能源于其训练数据——主要来自公共网页,这些数据往往反映了互联网上的主流叙事。

马斯克的回应:让 Grok 更加政治中立

面对批评,马斯克将 Grok 的行为归咎于训练数据,并承诺“让 Grok 更加政治中立”。他指出,AI 模型的行为直接受到训练数据的影响,而当前的数据来源可能偏向某些特定观点。因此,调整训练数据的分布可能是实现更平衡输出的关键。

值得注意的是,其他公司如 OpenAI 也在努力改进其模型的政治中立性。这可能部分受到特朗普政府对其保守派审查指控的刺激。然而,如何在保持事实准确的同时避免过度审查,仍然是一个极具挑战性的问题。

相关文章

![Black Forest Labs推出FLUX.1 [pro]微调API](https://pic.sd114.wiki/wp-content/uploads/2025/01/1737135577-FLUX-Pro-2.webp~tplv-o4t1hxlaqv-image.image)