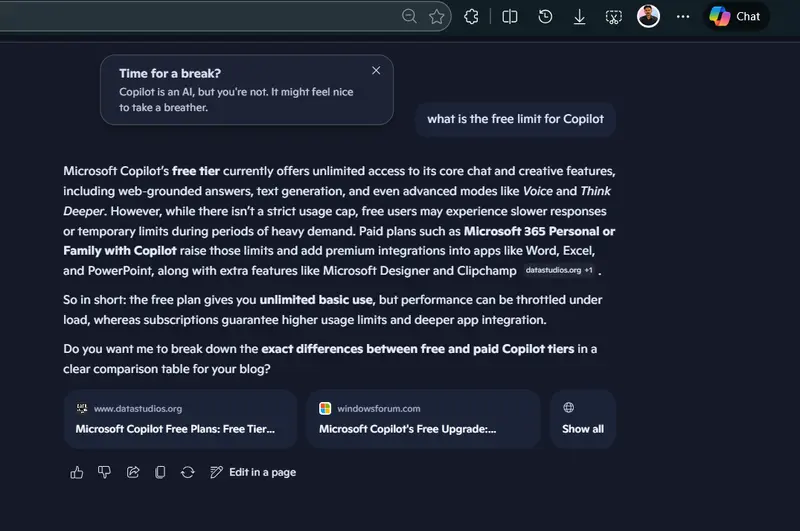

路透社报道,OpenAI 正在加速推进其自主研发AI芯片的计划,以减少对英伟达芯片的依赖。据消息人士透露,OpenAI 预计将在未来几个月内完成其首款内部芯片的设计,并计划将其送往台积电进行制造。这一过程被称为“流片”,标志着芯片设计阶段的结束和制造阶段的开始。

芯片研发进展与目标

OpenAI 的这一举措表明其有望实现 2026 年在台积电大规模生产的雄心勃勃目标。流片的成本通常高达数千万美元,且从流片到成品芯片的生产周期约为六个月,除非 OpenAI 支付更高的费用以加快进度。值得注意的是,流片并不保证芯片首次就能正常工作,一旦失败,公司需要诊断问题并重新进行流片。

消息人士称,这款专注于训练的芯片在 OpenAI 内部被视为一种战略工具,旨在增强其与其他芯片供应商的谈判能力。在首款芯片之后,OpenAI 的工程师计划通过每次迭代开发出功能更强大的处理器。

如果首款芯片的流片顺利,OpenAI 将能够大规模生产其首款内部 AI 芯片,并可能在今年晚些时候测试英伟达芯片的替代品。OpenAI 今年将设计送往台积电的计划显示了其在芯片设计上的快速进展,这一过程通常需要其他芯片设计公司更长的时间。

行业背景与挑战

尽管像微软和 Meta 这样的大型科技公司多年来一直在努力开发自己的芯片,但生产出令人满意的芯片仍面临诸多挑战。最近,中国人工智能初创公司 DeepSeek 引发的市场动荡也引发了对是否需要更少芯片来开发强大模型的疑问。

OpenAI 的芯片由其内部团队设计,该团队由 Richard Ho 领导,团队规模在过去几个月内增加了一倍,达到 40 人,并与博通合作。 Richard Ho 一年多前从 Alphabet 旗下的谷歌加入 OpenAI,在谷歌期间,他帮助领导了该公司的定制 AI 芯片项目。路透社去年首次报道了 OpenAI 与博通的合作计划。

与谷歌或亚马逊等科技巨头的大规模芯片设计团队相比,Ho 的团队规模较小。业内人士透露,一项雄心勃勃的大规模芯片设计计划可能需要 5 亿美元来开发单个版本的芯片,而构建必要的软件和外围设备则可能使成本翻倍。

市场需求与未来展望

像 OpenAI、谷歌和 Meta 这样的生成式 AI 模型制造商已经证明,通过在数据中心中连接大量芯片,可以使模型更智能,因此他们对芯片的需求几乎是无限的。Meta 表示,未来一年将在 AI 基础设施上花费 600 亿美元,微软则表示到 2025 年将花费 800 亿美元。目前,英伟达的芯片是最受欢迎的,占据了约 80% 的市场份额。OpenAI 本身也参与了美国总统唐纳德·特朗普上个月宣布的 5000 亿美元的“星际之门”基础设施计划。

然而,不断上涨的成本和对单一供应商的依赖促使像微软、Meta 和 OpenAI 等主要客户探索英伟达芯片的内部或外部替代品。

消息人士称,OpenAI 的内部 AI 芯片虽然能够训练和运行 AI 模型,但最初将以有限的规模部署,主要用于运行 AI 模型。该芯片在公司基础设施中的作用有限。如果要像谷歌或亚马逊那样进行全面的 AI 芯片开发,OpenAI 需要招聘数百名工程师。

台积电将使用其先进的 3 纳米工艺技术制造 OpenAI 的 AI 芯片。消息人士称,该芯片采用了常用的 systolic array 架构,并配备了高带宽内存(HBM)和广泛的网络功能,这些技术也广泛应用于英伟达的芯片中。

相关文章