近年来,开源社区在视频生成领域取得了显著进展,特别是 LTX-Video 和 HunyuanVideo 这两款开源的视频生成模型。随着 LoRA(Low-Rank Adaptation)技术的支持,这些模型现在能够以更低的成本和更少的数据进行个性化定制,为用户带来了更多的创新空间。

diffusion-pipe

今天,我们来了解一个名为 diffusion-pipe 的新工具。这是一个专门为 Flux、LTX-Video 和 HunyuanVideo 设计的 LoRA 模型训练脚本。请注意,此项目仍处于开发阶段,具有高度实验性质,可能不稳定且未经充分测试,因此在使用时需要谨慎。

功能亮点

diffusion-pipe 提供了以下关键功能:

- 流水线并行:通过分布式计算,使那些过于庞大而无法在单一 GPU 上训练的模型也能得到有效的训练。

- 完全微调支持:针对 Flux 模型提供全面的微调能力,确保模型可以适应特定的任务需求。

- LoRA 支持:不仅限于 Flux,还包括 LTX-Video 和 HunyuanVideo,使得这些模型能够利用LoRA的优势。

- 性能监控:将重要的训练指标记录到 TensorBoard 中,便于实时跟踪训练进度。

- 评估与泛化:在保留的评估集上计算各种指标,帮助衡量模型的泛化能力。

- 检查点管理:实现训练状态的自动保存与恢复,即使训练过程被中断也能继续。

- 多进程优化:高效地利用多 GPU 环境,预缓存潜在变量和文本嵌入,加速训练过程。

- 扩展性:只需实现一个简单的子类即可添加对新模型的支持,简化了集成流程。

- 跨平台兼容:尽管存在 Windows 平台上的兼容性问题,但已确认可以在 Windows Subsystem for Linux (WSL 2) 上正常运行。

注意事项

对于希望在 Windows 系统上使用 diffusion-pipe 的用户,需要注意的是,由于 Deepspeed 对 Windows 的部分支持,可能会遇到一些挑战。不过,有用户反馈在 WSL 2 环境下成功进行了训练。因此,如果你计划在 Windows 上部署,推荐尝试 WSL 2 作为解决方案。

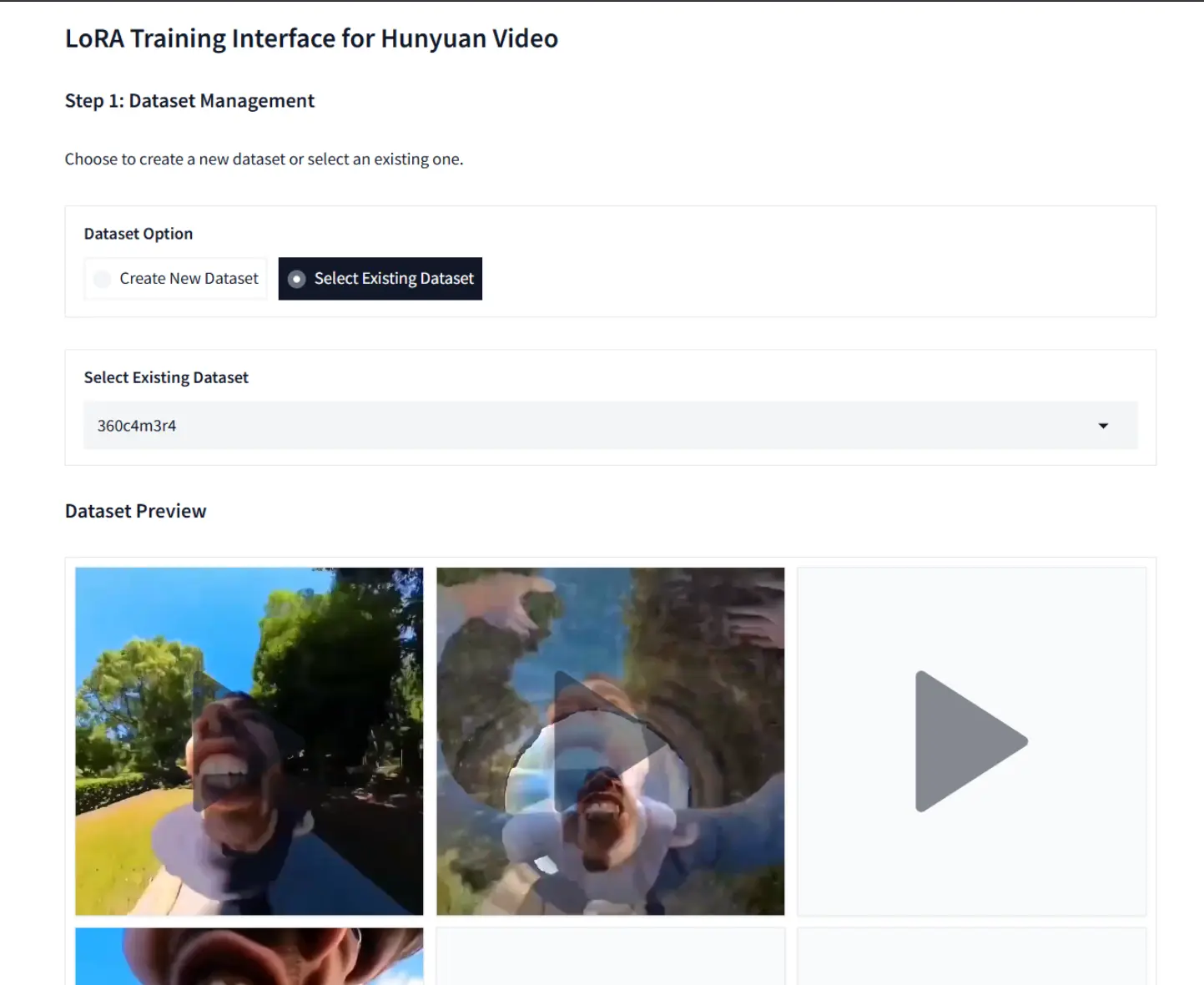

diffusion-pipe-UI

开发者alisson-anjos为diffusion-pipe提供一个Gradio界面以及一个Docker镜像,以便在任何支持Docker的环境(Windows、Linux)中轻松进行训练。你也可以在不使用Docker的情况下使用该界面,但需要按照原始README中的正常安装流程进行操作,然后不直接运行train.py,而是运行gradio_interface.py。

功能

- Docker镜像

- Web界面(Gradio):用于配置和执行LoRA训练

- 可选的NVIDIA GPU支持:用于加速训练

- 能够将主机系统中的模型和输出目录映射到容器中

- 可选的自动下载所需模型:在首次初始化时自动下载

- Tensorboard:用于可视化训练损失/周期

- Jupyter Lab:用于管理文件

LLaVA Video Captioner

在训练 LoRA 模型时,为图片或视频添加准确且详细的描述(即打标)是一项关键任务。为了帮助用户更高效地完成这项工作,最近推出了一款名为 LLaVA 视频描述生成器 (LLaVA Video Captioner) 的工具。该工具基于视觉语言模型 LLaVA,能够自动生成视频内容的详细描述,并支持批量处理多个视频文件,极大地简化了数据准备流程。

功能概述

LLaVA 视频描述生成器提供了以下主要功能:

- 批量处理视频:从指定文件夹中自动加载并处理多个视频文件,无需手动逐个操作。

- 可配置帧率的帧采样:允许用户根据需要调整帧采样的频率,确保生成的描述既详尽又不过于冗长。

- 内存优化批处理:采用高效的内存管理策略,即使处理大量视频也能保持系统的稳定性。

- 自定义提示模板:提供灵活的提示模板设置,可以根据具体应用场景定制生成描述的格式和内容。

- CSV 格式输出:将生成的描述以 CSV 文件的形式保存,方便后续的数据分析和模型训练。

- 4 位或 8 位模型量化:支持低精度模型量化,有助于减少计算资源消耗,提升推理速度。

系统要求

要使用 LLaVA 视频描述生成器,您的环境需满足以下条件:

- Python 版本:3.10 或更高版本,确保兼容最新的库和框架。

- 硬件要求:

- NVIDIA GPU:支持 CUDA 的 NVIDIA 显卡,用于加速视频处理和模型推理。

- GPU 内存:建议至少 8GB,以保证在处理高分辨率视频时的性能和稳定性。

相关文章