在英伟达 Blackwell GPU 上,针对小批量(Small Batch)自回归解码场景,一种名为 Warp Decode 的新内核设计彻底改变了混合专家(MoE)模型的推理方式。通过翻转并行性轴——从“以专家为中心”转变为“以输出神经元为中心”,Warp Decode 不仅将吞吐量提升了 1.84 倍,还因减少量化误差使精度提升了 1.4 倍。

- 官方详细说明:https://cursor.com/cn/blog/warp-decode

这项技术由Cursor的Composer 团队提出,解决传统 MoE 推理在解码阶段因数据布局管理开销过大而导致的效率瓶颈。

核心突破:为什么传统方法在解码时失效?

传统路径的困境:以专家为中心

现代 MoE 模型(如 Qwen-3, Mixtral)通常将 Token 路由到少量专家(例如 128 选 8)。传统实现遵循以下流程:

- 路由与分发:根据 Token 的归属,将其分发到对应的专家。

- 专家计算:每个专家独立处理分配给它的 Token 批次。

- 收集与合并:将各专家的输出重新组装并加权求和。

问题所在:

在 Prefill(预填充) 或 大批量推理 时,每个专家处理的 Token 数量足够多,分摊了数据整理的开销。但在 自回归解码(Decoding) 阶段,通常一次只生成一个 Token(Batch Size = 1)。此时,传统路径中 80% 的时间(5/8 个阶段) 都花在了填充、散射(Scatter)、收集(Gather)和合并(Combine)等“簿记”工作上,而非实际计算。

Warp Decode 的革命:以输出为中心

Warp Decode 的核心思想是:不再让 Warp(线程束)服务于专家,而是让每个 Warp 服务于一个输出神经元。

- 并行轴翻转:每个 Warp 负责计算最终输出向量中的一个标量值。

- 流式累加:Warp 直接从全局内存流式读取所有被路由专家的权重,并在寄存器中直接累加结果。

- 零中间缓冲区:无需暂存中间激活值,无需跨 Warp 同步,无需共享内存交换。

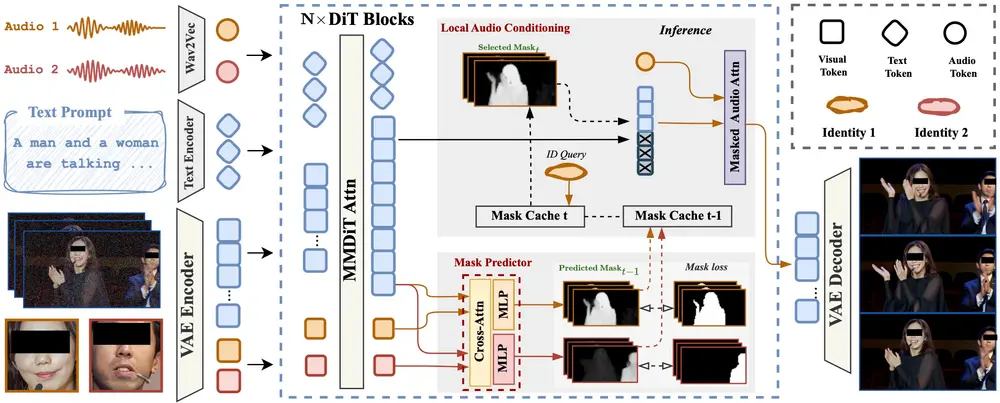

技术原理:两个 Kernel 搞定一切

Warp Decode 将整个 MoE 层压缩为两个高度融合的内核:moe_gate_up_3d_batched 和 moe_down_3d_batched。

1. Gate/Up Kernel:即时转换,无暂存

- 任务:计算 $Gate(x)$ 和 $Up(x)$。

- 执行:每个 CTA(协作线程数组)包含 8 个 Warp,每个 Warp 负责一个 Token-专家对的中间神经元。

- 优化:

- MXFP8 即时转 FP32:权重在读取时即时转换,避免额外内核。

- 激活复用:输入激活向量只需读取一次,同时用于 Gate 和 Up 投影,无需写入共享内存暂存。

- 私有累加:结果直接保存在寄存器中,应用 SiLU 激活函数后写出中间值。

2. Down Kernel:Warp 级蝶形归约

- 任务:计算 $Down(Intermediate) \times RouterWeight$ 并求和。

- 执行:每个 Warp 负责一个输出维度。它遍历所有 Top-K 专家,加载对应的 Down 权重行。

- 关键优化:

- 寄存器累加:所有专家的计算结果直接在 FP32 累加器中加权求和。

__shfl_xor_sync:使用硬件原语在 Warp 内的 32 个 Lane 间进行蝶形归约(Butterfly Reduction),完全绕过共享内存和 L1 缓存。- 无 Epilogue:加权组合直接成为投影的一部分,无需后续单独步骤。

性能与精度双重提升

1. 吞吐量提升 1.84 倍

通过消除传统路径中的五个非计算阶段,Warp Decode 显著减少了内存往返和同步开销:

- 消除填充(Padding):不再需要将 Token 列表填充到 2 的幂或特定边界。

- 消除 Scatter/Combine:中间结果不落地内存,直接在寄存器中完成归约。

- 消除中间缓冲区:每个 Token 节省了约 32 KB 的中间激活缓冲区(8 专家 × 2048 维度 × 2 字节),释放了宝贵的 L2 缓存容量用于存储权重。

2. 精度提升 1.4 倍

- 减少量化误差:传统路径通常需要将 BF16 激活量化为 MXFP8 再转回,引入舍入误差。Warp Decode 在整个过程中保持激活值为 BF16,累加器保持 FP32。

- 更接近真值:实验显示,Warp Decode 的输出与完整 FP32 参考值的接近程度比传统方法高 1.4 倍。

3. 硬件效率逼近极限

- 内存带宽利用率:在 B200 GPU 上,Warp Decode 达到了 3.95 TB/s 的有效带宽,占实测峰值(6.8 TB/s)的 58%。

- 延迟隐藏:由于每个 Warp 完全独立,GPU 调度器可以无缝切换停滞的 Warp,几乎完全掩盖了内存延迟。

适用场景与局限

| 场景 | 推荐方案 | 原因 |

|---|---|---|

| 自回归解码 (Decoding) | Warp Decode | Batch Size 小,专家间共享工作少,数据整理开销占比高。Warp 独立性带来极致延迟优化。 |

| 预填充 (Prefill) | 传统 Expert-Centric | Batch Size 大,大量 Token 共享同一专家,分摊了 Scatter/Gather 开销,GEMM 计算密度高。 |

| 大批量推理 | 传统 Expert-Centric | 同上,传统打包方式更能利用 Tensor Core 的大矩阵乘法优势。 |

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...