阿里巴巴今日正式发布 视频生成模型Wan2.7-Video 。这不仅是一个文生视频工具,更是一套全模态、全链路的智能视频创作系统。Wan2.7 打破了传统 AI 视频“抽卡式”生成的局限,真正实现了让视频像文档一样可编辑、可控制、可续写,被誉为“能导擅演”的 AI 导演。

阿里云百炼:https://bailian.console.aliyun.com/cn-beijing?tab=model#/model-market/all?providers=wan

万相官网:https://tongyi.aliyun.com/wan

- 海外版:https://wan.video

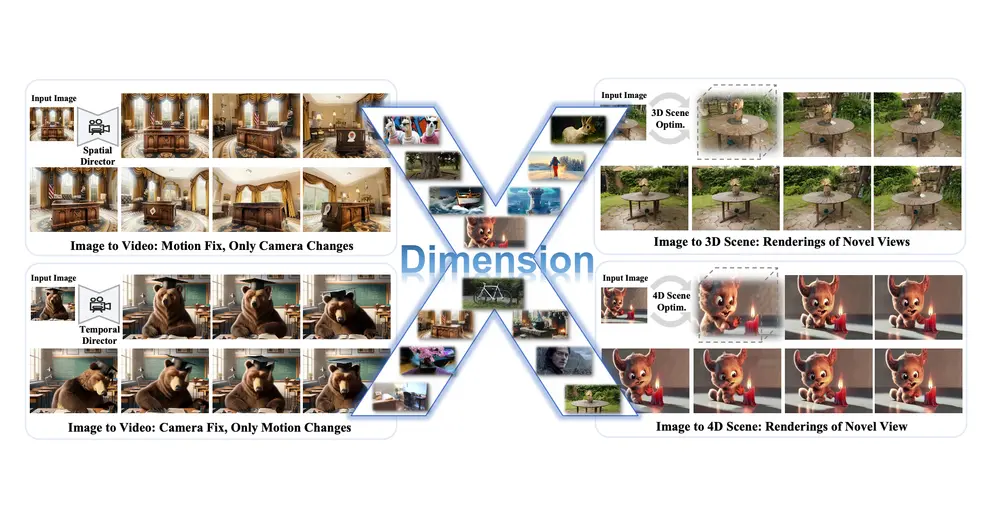

核心定位:从“生成器”到“导演套件”

Wan2.7 的野心不在于生成随机片段,而在于掌控完整的叙事流程。它支持 文本、图像、视频、音频 四种模态的全量输入与交互,覆盖以下七大核心创作环节:

- 生成 (Generate):从零开始创造视频。

- 编辑 (Edit):局部修改、物体增删替换。

- 复刻 (Replicate):角色与声音的精准克隆。

- 重塑 (Reshape):风格转换、环境变换。

- 驱动 (Drive):音频驱动口型与表情。

- 续写 (Continue):剧情延伸与首尾帧控制。

- 参考 (Reference):多主体特征锁定。

六大颠覆性功能亮点

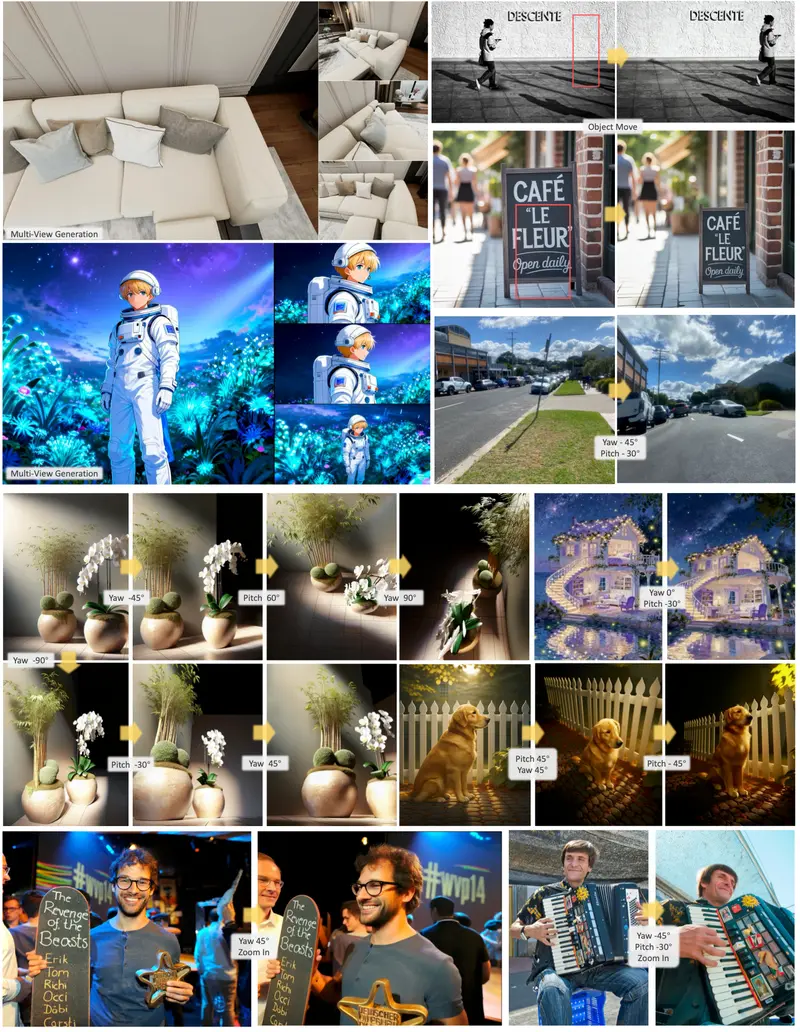

1. 像素级可控编辑:视频即文档

Wan2.7 让视频编辑变得像修图一样简单自然:

- 局部重绘:通过指令框选区域进行修改(如“把胶片换成盘子”),光影与材质自动与原视频完美融合。

- 物体增删改:

- 删除:“删掉视频中的火车”。

- 替换:“把手中的控制器换成冷兵器”。

- 属性修改:“把红色建筑变成蓝色”。

- 智能参考添加:支持参考特定图像内容,精准添加到视频指定位置。

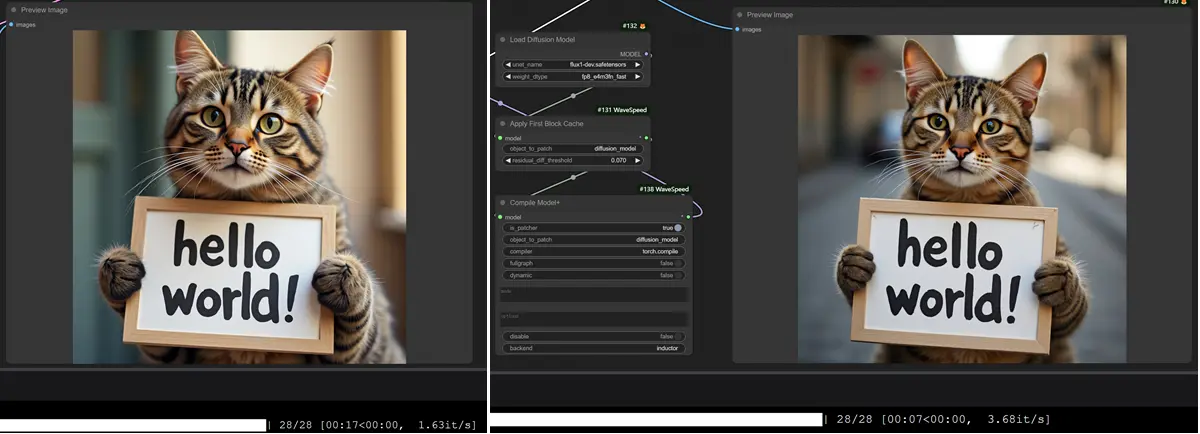

2. 角色与声音的深度定制

- 多主体锁定:支持多达 5 个参考输入,可为视频中每个角色独立锁定外观和音色,确保多镜头切换时人物一致性。

- 声音配置文件:上传声音样本,即可让角色说出任意台词,保持音色、情绪甚至口型的完美匹配。

- 颠覆性演绎:在不改变场景的前提下,彻底替换角色身份(如“将现代玩家变为中世纪骑士”),但保留原有的动作逻辑和握持姿势。

3. 时空与风格的自由穿越

- 环境变换:人物动作不变,背景可从“夏日”无缝切换至“深秋”,或从现实世界转为“羊毛毡风格”。

- 画质增强:支持黑白视频上色、低分辨率超分等质量提升任务。

- 视觉理解:内置主体分割能力,精准识别并处理视频中的独立元素。

4. 摄影机位的完全掌控

Wan2.7 理解专业的电影语言,允许用户通过自然语言修改拍摄参数:

- 运镜控制:“将镜头修改为从地面逐渐向上升起”。

- 参数调整:自由修改机位、视角、景别、镜头类型及焦距。

- 效果:同一素材,通过不同的镜头指令,可呈现出截然不同的观影体验。

5. 台词与行为的二次创作

这是 Wan2.7 最强大的“导演”能力之一:

- 改台词:输入新剧本,角色会自动调整口型和表情来说出新台词,且音色统一、情绪连贯。

- 改行为:仅修改动作逻辑(如“坐沙发上的女生变为站着打游戏”),其他背景、光影保持不变。

- 剧情续写:支持 首尾帧控制、视频续写 及 续写 + 尾帧 模式,精准把控剧情走向、画面构图及光影连续性。

6. 全栈创意工作流

Wan2.7 不再是单点工具,而是集成了:

- 生成 → 编辑 → 克隆 → 风格重绘 → 续写 的完整闭环。

- 用户可以在一个模型内完成从创意构思到最终成片的所有步骤,无需在多个工具间切换。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...