Hugging Face 激动地宣布,GGML 及其核心项目 llama.cpp 的创造者 Georgi Gerganov 及其团队正式加入 Hugging Face。这一战略举措旨在为本地 AI(Local AI)的指数级增长提供长期、可持续的资源支持,确保开源超级智能的未来真正掌握在社区手中。

珠联璧合:模型定义与本地推理的完美闭环

这次合作被双方视为“自然且必然”的结合:

- Hugging Face

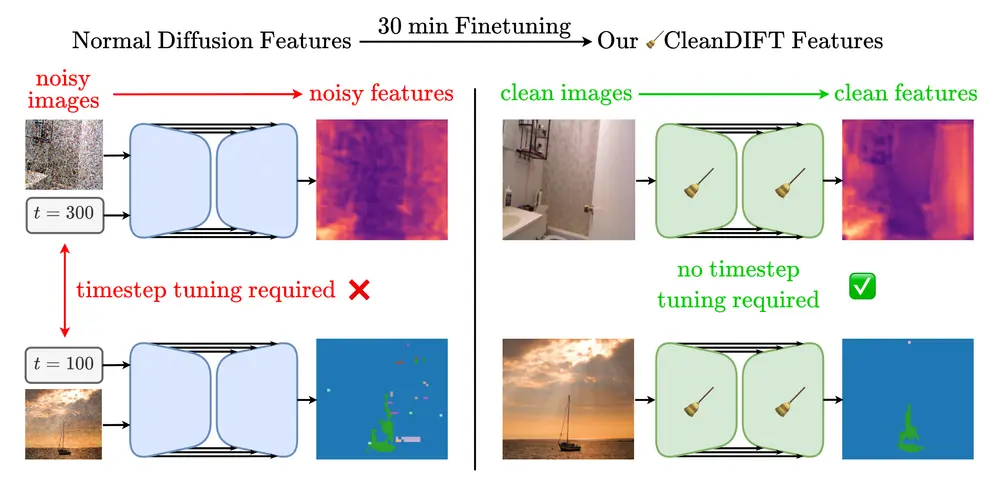

transformers:是全球公认的模型定义与架构的“唯一真相来源(Single Source of Truth)”。 llama.cpp:则是本地高效推理的事实标准基础构建模块。

两者的结合,标志着从模型训练/定义到终端设备运行的全链路打通。Hugging Face 将致力于消除两者间的摩擦,确保新模型从 transformers 库导出至 llama.cpp 格式的过程尽可能无缝、流畅。

社区承诺:100% 开源,自主权不变

针对社区最关心的“收购后是否会变质”的问题,Hugging Face 给出了明确的定心丸:

- 全职投入:Georgi 及其团队将把 100% 的时间继续投入到

llama.cpp的维护与开发中。 - 完全自主:团队在技术路线图、社区治理和项目方向上拥有完全的自主权和领导权。

- 永久开源:

llama.cpp将继续保持 100% 开源 并由社区驱动的模式,不会有任何改变。 - 资源加持:Hugging Face 将为项目提供长期的资金、基础设施和人力资源支持,让团队能更专注于技术创新,而非生存压力。

“变化不大——Georgi 和团队仍将 100% 的时间投入到维护 llama.cpp 上……该项目将继续像现在一样,保持 100% 开源并由社区驱动。” —— Hugging Face 官方声明

技术愿景:让本地推理无处不在

此次整合不仅仅是人事变动,更有一系列实质性的技术推进计划:

- 无缝交付管道:优化从

transformers到ggml格式的转换流程,让开发者能第一时间在本地运行最新的开源模型。 - 用户体验升级:改进基于

ggml软件的打包、分发和安装体验。目标是让普通用户也能像安装普通应用一样,轻松部署和访问本地大模型。 - 云边协同:推动本地推理成为云推理真正具有竞争力的替代方案,让用户根据需求灵活选择运行环境,降低算力成本,保护数据隐私。

终极目标:开源超级智能普惠全球

Hugging Face 与 GGML 团队的共同愿景宏大而清晰:为社区提供基础构建模块,使开源超级智能在未来几年内为全世界所用。

随着 AI 模型越来越大,对算力的需求日益高涨。通过强强联手,双方致力于构建能在个人设备(手机、笔记本、边缘设备)上尽可能高效运行的终极推理堆栈。这不仅是技术的胜利,更是开放精神的胜利——确保最先进的 AI 能力不被少数巨头垄断,而是成为每个人触手可及的工具。

欢迎来到本地 AI 的新纪元。 在这里,模型属于所有人,运行在你手中。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...