OpenAI 于 10 月 30 日发布 Aardvark——一款基于 GPT-5 的 AI 安全研究助手,目前开放私有测试版。该工具旨在帮助开发与安全团队自动发现、验证并修复代码中的安全漏洞。

核心能力

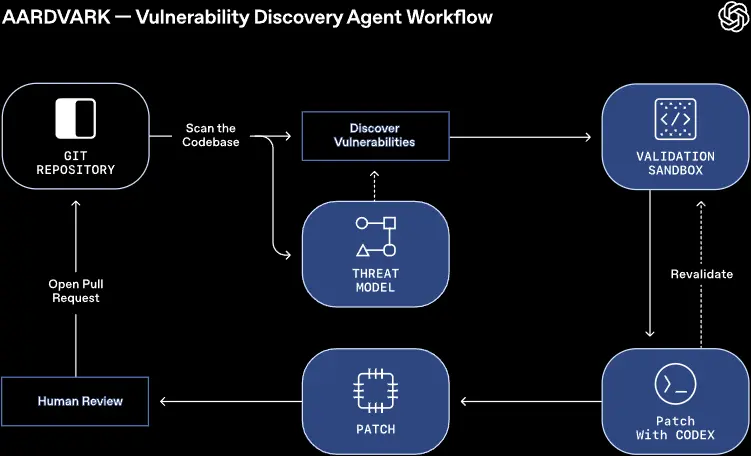

Aardvark 不依赖传统程序分析方法(如模糊测试或软件成分分析),而是通过大语言模型驱动的推理与工具调用,模拟人类安全研究员的工作流程:

- 威胁建模:首次接入代码库时,分析整体架构并生成项目级威胁模型;

- 提交级扫描:监控每次代码变更,结合全局上下文识别潜在漏洞,并在代码中添加可读注释供人工复核;

- 漏洞验证:在隔离沙箱中尝试触发漏洞,确认其可利用性,降低误报率;

- 自动修补:集成 OpenAI Codex,为每个漏洞生成经验证的修复补丁,支持一键应用。

工具深度集成 GitHub 与现有开发流程,目标是在不干扰开发节奏的前提下提供可操作的安全洞察。测试中,Aardvark 还能识别逻辑缺陷、不完整修复及隐私问题。

实测表现

- 在 OpenAI 内部代码库及 Alpha 合作伙伴项目中已运行数月,发现多个具备实际风险的漏洞;

- 在“黄金”基准代码库测试中,召回率达 92%(覆盖已知及人工注入漏洞);

- 已在开源项目中识别并协助披露多个漏洞,其中 10 个获得 CVE 编号。

开源与责任披露

OpenAI 计划为非商业开源项目提供公益扫描服务,以提升软件供应链安全。同时更新了外部漏洞披露政策,强调协作与开发者友好,避免强制时间表带来的压力。

背景与意义

2024 年全球已报告超 4 万项 CVE。研究表明,约 1.2% 的代码提交会引入新缺陷。Aardvark 的设计目标是将安全能力嵌入开发流程早期,实现“持续防护”,而非事后补救。

目前,Aardvark 仅限受邀组织与开源项目参与私有测试。符合条件的团队可通过官方渠道申请。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...