由北京航空航天大学软件学院、清华大学、香港大学与 VAST 联合提出的新框架 AnimaX,为 3D 角色动画生成带来了一种高效且通用的解决方案。

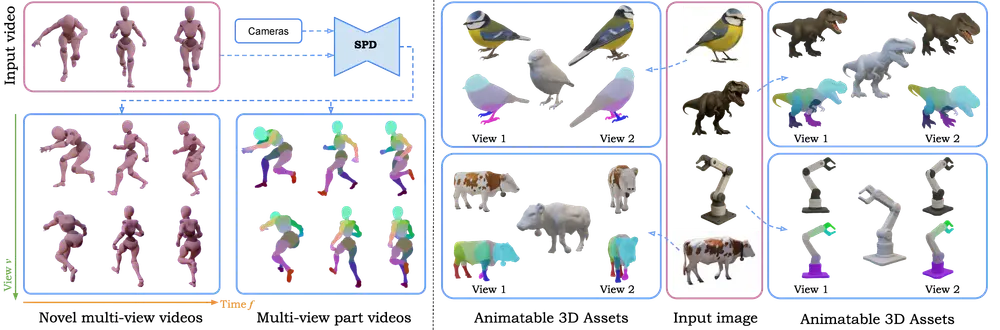

该方法突破了传统动画系统对固定骨骼拓扑或高维优化的依赖,首次将视频扩散模型中的运动先验与基于骨骼的可控动画结构有效结合,支持对任意骨骼结构的 3D 模型(如人形、动物、机器人甚至家具)进行快速动画化。

只需输入一个 3D 模型和一段文本描述(例如“一只猫在跳跃”),AnimaX 即可在几分钟内生成自然、连贯且视角一致的 3D 动画。

传统方法的局限

现有的 3D 运动生成技术主要面临两大瓶颈:

- 基于物理仿真或优化的方法:虽能生成真实动作,但计算成本高,难以扩展到复杂模型;

- 依赖预定义骨骼结构的模型:通常仅适用于人类或少数特定物种,泛化能力差;

- 纯扩散生成模型:虽具备强表达能力,但缺乏结构控制,难以保证动画的物理合理性和骨骼一致性。

AnimaX 的目标,正是打破这些限制,实现高质量、高效率、高可控性的通用 3D 动画生成。

核心功能

AnimaX 支持以下关键能力:

- 文本驱动的 3D 动画生成

输入 3D 网格 + 文本指令(如“奔跑”“转身”),自动合成匹配语义的动作序列。 - 支持任意骨骼结构

无需预设骨骼拓扑,适用于人、动物、机械装置等多样化铰接模型。 - 多视角一致性保障

生成的动画在不同视角下保持几何与运动一致性,适合用于 AR/VR 或影视制作。

技术创新亮点

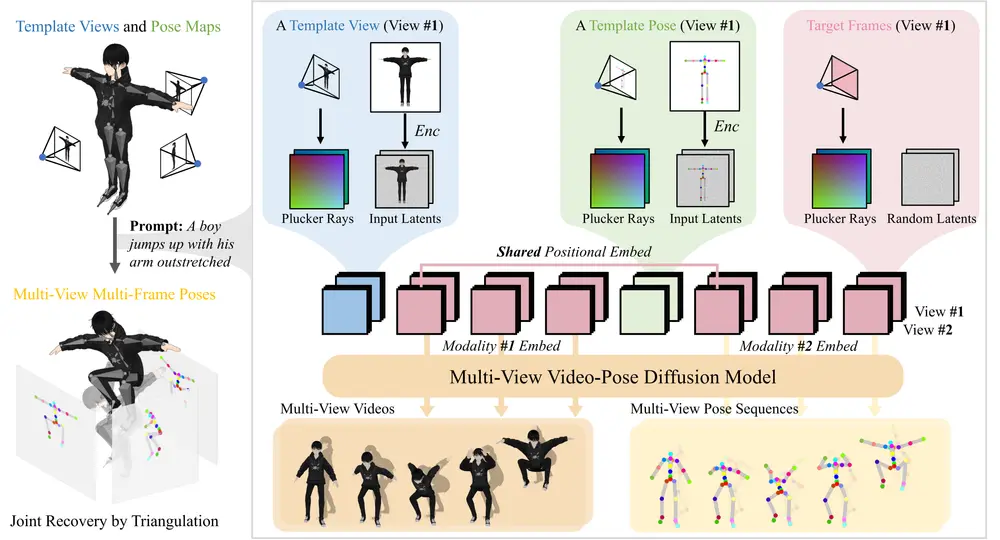

1. 联合视频-姿态扩散:从 2D 学习 3D 运动

AnimaX 并不直接在 3D 空间中生成动作,而是通过一个创新的联合扩散机制,同时生成:

- 多视角下的动态视频

- 对应的 2D 姿态序列(姿态图)

这一设计使得模型能够从海量视频数据中学习真实的运动模式(即“运动先验”),并通过 2D 姿态作为桥梁,将这些知识迁移到 3D 动画任务中。

2. 共享位置编码 + 模态感知嵌入:确保时空对齐

为了保证视频与姿态图之间的同步性,AnimaX 引入:

- 共享位置编码:统一建模空间与时间位置,使视频帧与姿态点在时空上精确对齐;

- 模态感知嵌入:区分视频与姿态两种模态,在共享表征的同时保留各自特征特性。

这种设计显著提升了生成动作的准确性与协调性。

3. 多视角一致性建模

通过引入相机参数嵌入和多视角注意力层,模型在生成过程中显式考虑不同视角之间的几何关系,确保同一动作在多个视角下具有一致的外观与运动轨迹。

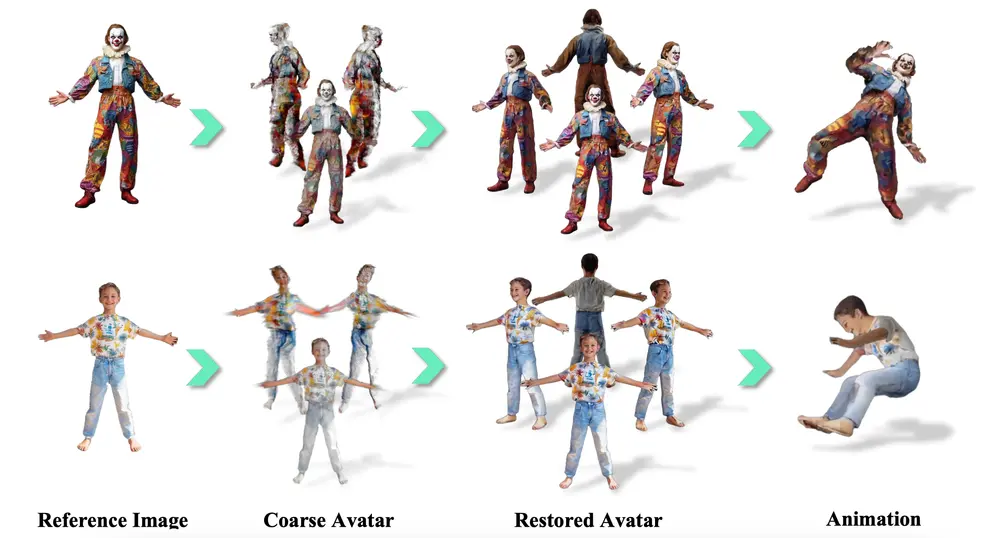

4. 高效两阶段流程:快而不失真

AnimaX 采用两阶段流水线,兼顾效率与精度:

- 第一阶段:联合生成多视角视频与 2D 姿态序列

基于输入 3D 模型的渲染模板视图和文本提示,扩散模型同步生成多视角视频与对应的 2D 关节位置序列。 - 第二阶段:3D 动画重建

- 利用多视图三角测量,将 2D 姿态序列提升为 3D 关节轨迹;

- 通过逆向运动学(IK)求解关节角度,并驱动原始 3D 网格完成动画。

整个流程可在数分钟内完成一次动画生成,远快于传统优化方法。

训练与数据支持

AnimaX 在一个新构建的大规模数据集上训练,包含 161,023 个装配动画序列,覆盖多种类别与运动类型。这一数据基础为其强大的泛化能力提供了保障。

评估主要在 VBench(3D 生成通用评测基准)上进行,涵盖运动保真度、外观一致性、文本对齐等多个维度。

实验表现:全面领先

| 维度 | 表现 |

|---|---|

| 定量指标(VBench) | 在运动平滑性、外观质量、文本-动作对齐等指标上均优于现有方法 |

| 用户研究 | 用户在运动自然度、3D 形态一致性、整体质量方面显著偏好 AnimaX 输出 |

| 效率 | 相比需要小时级优化的传统方法,AnimaX 可在几分钟内完成动画生成 |

定性结果显示,AnimaX 能准确捕捉复杂动作(如跳跃、转身、爬行),并在不同物种间保持良好的迁移能力。

相关文章